AIエージェントの安全性は『モデルの注意力』ではなく『ハーネスの設計』で守る

Zenn / 2026/4/12

💬 オピニオンIdeas & Deep AnalysisTools & Practical Usage

要点

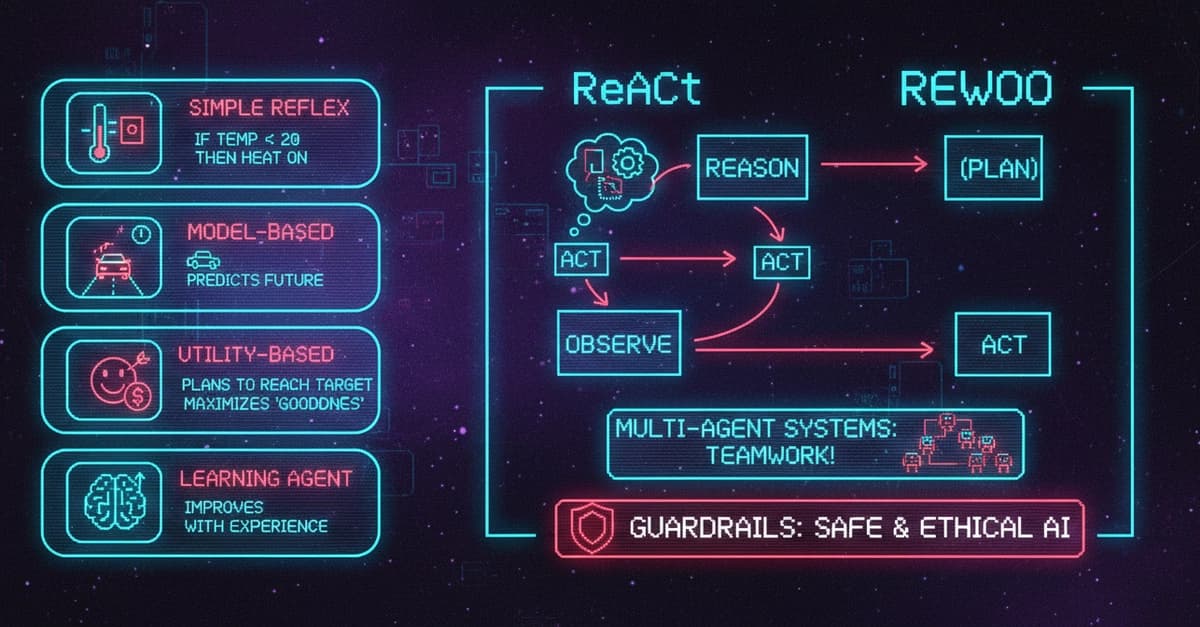

- AIエージェントの安全性は「モデルの注意力」に依存するのではなく、「ハーネス(実行・制御環境)の設計」で担保すべきだと主張しています。

- 具体的な安全対策の中心を、エージェントが使うツールや外部入出力、実行手順を縛る“ガードレール”に置いています。

- モデル単体の性能・挙動のばらつきに対し、運用側で制約・検証・遮断を行うことで事故の確率を下げる考え方を示しています。

- 安全性を設計論として扱い、エージェントの振る舞いを「システム全体の整合性」で管理する重要性を強調しています。

AIエージェントを実務や開発に組み込み始めると、ついモデルそのものの賢さに注目しがちです。

しかし、実際に危険になるのは「モデルが何を考えたか」よりも、「どんな権限で、どんな外部入力を読んで、どんなツールを叩ける状態になっているか」です。

最近見ていて強いなと思ったのが、Anthropic Hackathon Winner として公開されている everything-claude-code です。

このリポジトリでは、エージェント運用を単なるプロンプト集ではなく、agent harness(エージェントを動かすための土台)全体の設計問題として扱っています。

その中で特に重要だと感じたのが...

この記事の続きは原文サイトでお読みいただけます。

原文を読む →