この記事は会員限定です。会員登録すると全てご覧いただけます。

多くの企業が優先課題の一つとしてAI活用に取り組んでいるが、ビジネスの成長につながらないことに頭を悩ませるケースも多い。AIによる成果創出のためには、AIに適応するデータ基盤の整備が欠かせない。

しかし、膨大なデータを転送し、加工できる基盤を構築するには高いハードルが立ちはだかる。特にデータの転送・加工・保存の準備工程(ETL)における運用負荷の重さは、多くのIT部門を悩ませている。こうした障壁を「AIリーダブルな、IoTデータなどを取り扱う高負荷なデータ基盤の構築」によって突破したのが大阪ガスだ。

大阪ガスはどのようにして生成AIを「優秀な部下」(有能な部下)に変貌させ、事業部門の従業員も含めてデータを活用できる環境を実現したのか。

本稿は、アイティメディアが主催したオンラインセミナー「Enterprise IT Summit 2026 冬」(開催日:2026年2月16~19日)で、大阪ガスの國政秀太郎氏(DX企画部 ビジネスアナリシスセンター 副課長)が「大阪ガスが切り拓くデータ民主化2.0:生成AIで解き放つデータ活用の可能性」というテーマで講演した内容を編集部で再構成したものです。

大阪ガスは「高負荷なデータ基盤」からどう脱却した?

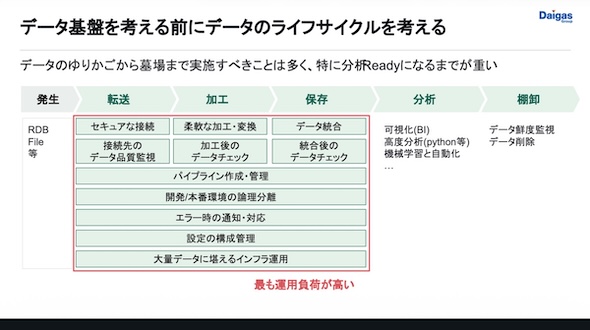

大阪ガスの國政秀太郎氏(DX企画部 ビジネスアナリシスセンター 副課長)は、IoTデータなどを取り扱う高負荷なデータ基盤の構築に当たって最初に考えたのはデータのライフサイクルだと語る。

「ツールやSaaSは基盤構築のための手段にすぎません。まず考えるべきは、どのような部署でどのようなデータが生まれ、どこに移動し、どのように加工されるかといったデータのライフサイクルです。これらの工程を効率化し、AIが分析に活用できるデータをそろえられる環境を構築しなければなりません」

國政氏が調査したところ、「転送」「加工」「保存」の工程に特に大きな負荷がかかっていることが分かった。同氏は現在の統合基盤を構築する以前、オープンソースのデータ転送ツール「Embulk」や、オープンソースのコンテナオーケストレーションツール「Kubernetes」を利用して社内でデータ基盤を内製運用していた経験から、「データ活用にたどり着くまでの業務負担が大きすぎる」ことを痛感していた。

この負荷を解消すべく、大阪ガスはprimeNumberが提供するデータ統合・転送SaaS「TROCCO(トロッコ)」を導入し、インフラ運用の透明化を図ることにした。

TROCCOはGUIベースの操作でデータの転送や加工、統合といったパイプラインを構築・管理できるサービスで、非エンジニアでも使いやすい点が特徴だ。SaaSの選定に当たって同社は機能面やサポート、「AIリーダブル」という3点を重視した。

機能面ではサーバーレスであることやコネクタの豊富さを重視し、サポート面ではコミュニケーションツールの「Slack」専用チャンネルなどホットラインの有無や、具体的なユースケースを基にした並走が可能であることを確認した。

同社が特に重視している「AIリーダブル」の観点では、SaaSにAIが組み込まれており自然言語で操作できるかどうか、パイプラインの諸設定をAIで記述し、連携しやすいかどうかなどを精査した。

生成AIが自律的に稼働するための「舞台装置」

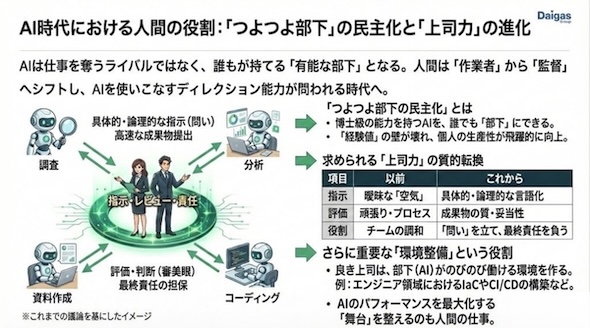

大阪ガスビジネスアナリシスセンターが推進している「さらなるデータ民主化」の核心は、生成AIを単なるツールとしてではなく、自律的に働く「有能な部下」として位置付けている点にある。

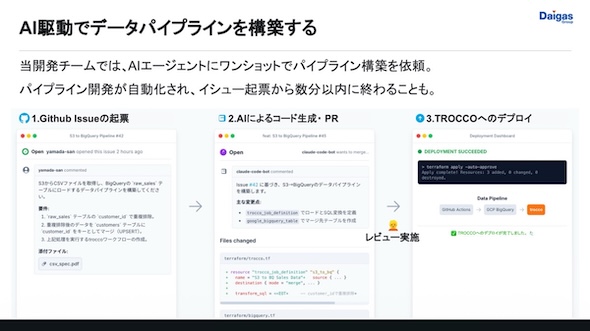

大阪ガスが目指す「AIリーダブル」とは、AIがデータを読み取れるだけでなく、データ基盤の設定や拡張をAI自身が自律的に実行できる環境のことだ。そうした環境を実現するための布石となったのが、TROCCOのIaC対応だ。

TROCCOがInfrastructure as Code(IaC)ツール「Terraform」に対応したことで、同社の戦略は大きく進展した。「TROCCOは最近、データパイプラインの各種設定をTerraformコードで記述・管理できるようになりました。GUIで操作できるのに、なぜソースコードを書く必要があるのかと疑問に思うかもしれませんが、この仕組みによってAIがTROCCOの設定を直接読み書きできるようになるのです」(國政氏)

非定型なGUI操作はAIには困難だが、論理的に構造化されたソースコードであれば、人間以上のスピードと正確さで内容を把握し、記述できる。こうしてAIリーダブルな管理環境を整備した同社は、事業部門の従業員がソフトウェア開発・コード管理プラットフォーム「GitHub」に自然言語で要望を記述すると、AIが自動でTerraformコードを生成し、データエンジニアのレビューを経てTROCCOの設定に自動反映される仕組みを構築した。

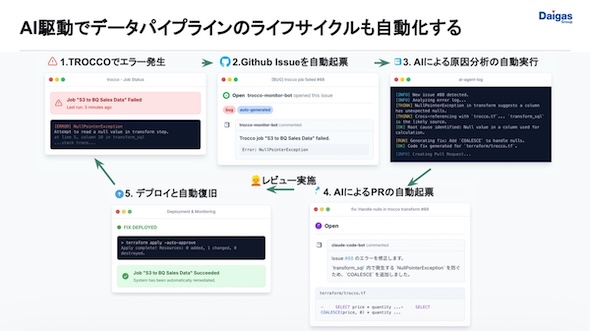

「従来は専門チームに依頼していたパイプライン構築が、今では要望を出してから数分以内に完了するケースもあります」(國政氏)。さらに、運用面でも自動化が進んでいる。パイプラインの定期実行中にエラーが発生すると、GitHubに自動で起票され、自動で原因が分析される。修正が必要な場合はAIがコードを生成し、人間によるレビューを経て復旧が完了する。

自動化の効果は大きく、エラー発生からAIによるソースコードの提案まで10分で完了するケースもある。國政氏は「深夜にエラーが発生しても、翌日に出社したときには修正完了の直前まで工程が進んでいることもあります」と、スピード感を強調した。

「優秀な部下」の民主化と「上司力」の進化

分析準備が整ったデータは、Google Cloudのデータウェアハウス「BigQuery」を通じて活用される。BigQueryには自然言語で問い合わせ可能な会話型分析機能が備わっており、非エンジニアでもデータを探索できる。エネルギー需要予測などの高度な統計分析には、Google Cloudで動作するGeminiベースのデータ分析エージェントを組み合わせている。

こうしてAIが開発・運用を担う環境が整ったことで、人間の役割は劇的に変化した。「かつての私の仕事はコードを正確に速く書くことでした。現在はAIが人間以上のスピードでコードを書いてくれます。そのため人間はAIが書いたコードを確認して修正を指示し、実行を見守り、結果を検証する役割を担っています。まさに『AIの上司』として振る舞う必要があるのです」(國政氏)

AIという優秀な部下のパフォーマンスを最大化させるためには、メタデータの整備が欠かせない。國政氏は「導入したばかりのAIは、社内事情を知らない優秀な新人と同じです」と語る。新人が業務を遂行するためにマニュアルが必要であるように、AIにもメタデータが必要だ。

AIがデータを正確に分析するために必要な情報を作成し、AIがシームレスに読み取れる環境を構築する。具体的には、マニュアルの役割を果たす「テーブル説明書」や、社内用語の定義をまとめた「用語集」に加え、AIがデータ抽出のイメージをつかむための「サンプルクエリ」や「使用上の注意点」も重要なメタデータに含まれる。

「これらのメタデータを新人向けの引継書を作るような感覚で作成し、メンテナンスしています。ドキュメント整備を後回しにせず、AIがのびのび働ける『舞台』を整えることも、これからの人間に求められる重要な『上司力』です」(國政氏)

AI駆動型データ基盤へのロードマップ

大阪ガスは、AI活用のためのデータ基盤を効率的に整備し、データのライフサイクルが自動的に維持される環境を構築した。さらに、AIを活用することで事業部門の従業員がデータを分析できる環境を実現した。これらの取り組みによって人間はAIの上司となり、指示および判断、最終的な責任を負う役割を担っている。

「当社は今後もAIの上司として振る舞える人材を育成します。AI活用の事例を広げ、最終的には企業全体の価値向上を実現したいと考えています」(國政氏)

最後に國政氏は、これからデータ基盤を構築する企業に向けて、3つのステップを紹介した。

ステップ1では、SaaSを導入して安定してデータを集約できる環境を整える。ステップ2では、環境をIaC化してAIリーダブルなものにする。そしてステップ3で、AIエージェントによるさまざまな分析や自動運用が可能な環境に到達する。

「AIという『有能な部下』を誰もが持てる時代が到来します。こうした中で、人間に問われるのは、その能力を最大化するための『舞台』を整え、上司としてAIを正しく導く力なのです」(國政氏)

関連記事

Copyright © ITmedia, Inc. All Rights Reserved.