AppleがSiriを「開放」——iOS 27のExtensionsでClaude・Gemini・ChatGPTが共存する時代

Bloomberg Mark Gurmanの報道(2026年3月26日)をベースに、テクニカルコンサルタントの視点で整理・解説します。

https://www.bloomberg.com/news/articles/2026-03-24/ios-27-features-apple-ai-reboot-with-siri-app-new-interface-ask-siri-button?srnd=undefined

もう一社独占はない

「SiriにChatGPTを呼び出せる」——その機能がiOS 18.2で登場してから約1年半。AppleはついにOpenAIとの"独占関係"を解消し、Siriを本格的なAIプラットフォームとして開放する方向に舵を切りました。

iOS 27(2026年秋リリース予定)で導入される新機能「Extensions」により、App Storeからインストールした任意のAIチャットボットをSiriと連携させることができるようになります。

対象となるサービスは現時点の報道によると:

Anthropic Claude

Google Gemini

OpenAI ChatGPT(引き続き対応、ただし独占解消)

Microsoft Copilot

Perplexity

Amazon Alexa

xAI Grok

Meta AI

など、主要AIサービスがほぼ横並びで対応する見込みです。

Extensionsの仕組みとは?

シンプルに言えば「AIのApp Store化」です。

現在のChatGPT連携と基本的な流れは同じです。Siriが処理しきれないクエリを、ユーザーが指定したAIサービスにルーティングする——ただし今後は1社独占ではなく、ユーザーが自由に選べるようになります。

設定の場所は「設定 → Apple Intelligence & Siri」内にExtensionsセクションが追加される予定。App Storeからインストール済みのAIアプリがここに表示される形になりそうです。

9to5MacはAppleの内部テスト版からのテキスト断片を確認しており:

"Extensions allow agents from installed apps to work with Siri, the…"

という記述が見つかっています。正式発表前ながら、開発がかなり進んでいることが伺えます。

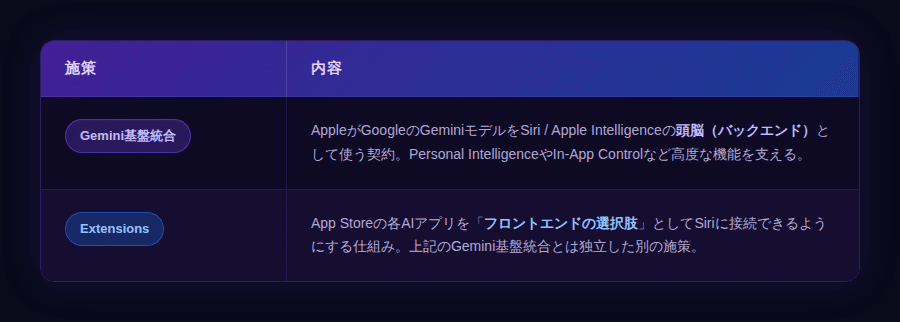

「Gemini統合」とは別の話

ここで混乱しやすいポイントを整理しておきます。

つまり構造としては:

ユーザー

↓(Siriに話しかける)

Siri(入口・オーケストレーター)

├── 基本処理 → Apple Intelligence(Geminiモデルが裏で動く)

└── Extensions → Claude / ChatGPT / Perplexity / ... (ユーザーが選択)Appleは「自分でAIを作る」より「全AIの玄関口になる」戦略を選んだわけです。

なぜこの戦略か?現場コンサルの目線で

① Apple Intelligenceの遅延という現実

WWDC 2024で発表された強化版Siri機能(Personal Intelligence、アプリ操作対応など)は、当初iOS 18での提供予定でしたが、まだ届いていません。iOS 27でようやく実装される見通しで、約2年の遅延。

自社AIが間に合わないなら、外部を使う——非常に現実的な判断です。

② 30%手数料というビジネスモデル

App Storeを経由したAIサブスクリプション課金からAppleが収益を得る仕組みになるとBloombergは報じています。

Claude Pro・Gemini Advanced・ChatGPT Plusなど、各社の有料プランがこのルート経由で課金されれば、Appleにとっては新しい収益の柱になります。

③ 「どのAIが最強か」論争を回避

Claude・Gemini・ChatGPTそれぞれに強みがあります。ユーザーに選ばせることで「Siriは最高のAI」ではなく「最高のAIへのアクセス手段」というポジションを確立できる。これは競争ではなくプラットフォーム化の発想です。

懸念点・未解決の問題

プライバシーはどう担保されるか

Appleは「プライバシー重視」を長年の強みとしてきましたが、音声クエリを第三者(AnthropicやGoogleなど)のサーバーに送信することは、その哲学と一定のトレードオフになります。オプトインか否か、どこまでAppleが管理するか——WWDC 2026での説明が重要なポイントになるでしょう。

全アプリが対象か、審査があるか

Bloomberg自身も「どのAIアプリが対象になるか、承認プロセスがあるか不明」としています。Appleがゲートキーパーとして何らかの審査をかけることは十分考えられます。

Siri自体の性能がボトルネックでは?

「入口(Siri)が賢くなければ、どのAIを繋いでも微妙では?」という懸念は正直あります。音声認識の精度、意図理解の正確さ、ルーティング判断の質——Siriの基本性能は依然として課題です。

スケジュールまとめ

まとめ

Appleが取った「SiriをAIのプラットフォームにする」戦略は、自社開発の遅れを逆手に取った巧みな立ち回りだと思います。ユーザー視点では「好きなAIを選べる」、Apple視点では「手数料収益と囲い込みを両立」、AI各社視点では「iPhoneユーザーへのリーチを確保できる」——三方よしに見える構図です。

ただし、プライバシーの扱いとSiri自体の性能改善が伴わないと、「繋がるけど使いにくい」になりかねない。WWDC 2026のデモがどこまで完成度を示せるか、注目して見ていきたいと思います。