要旨: 大規模言語モデル(LLMs)は高資源言語ペアにおける機械翻訳において顕著な能力を示しているが、低資源翻訳での性能は依然として遅れている。既存のポストトレーニング手法は高品質な並行データに大きく依存しており、それらは低資源言語ではしばしば希少または入手できない。本論文では、モノリンガルテキストのみを用いる強化訓練法であるWALARを提案し、膨大な低資源言語に対するLLMsの翻訳能力を高めつつ、高資源言語での性能を維持する。私たちの核となる洞察は、既存のソースベースの多言語品質評価(QE)モデルにおける失敗モード(あるいは「穴」)の観察に基づく。これらのQEモデルを用いた強化学習(RL)は、そうした穴を拡大させ、結果として多言語対応のLLMの性能を劣化させる。WALARのRL訓練の報酬でこのような穴を緩和するため、語アライメントおよび言語アライメントを含む技術を開発した。WALARを用いて、101言語の翻訳をサポートするLLMを継続的に訓練した。実験の結果、私たちの新しいモデルはFlores-101データセットの1400言語方向で、最も強力なオープンソース多言語LLMの1つであるLLaMAXを大幅に上回ることを示した。返却形式: {"translated": "翻訳されたHTML"}

穴を塞ぐ:多言語翻訳の強化学習における報酬ハッキングの緩和

arXiv cs.CL / 2026/3/16

📰 ニュースModels & Research

要点

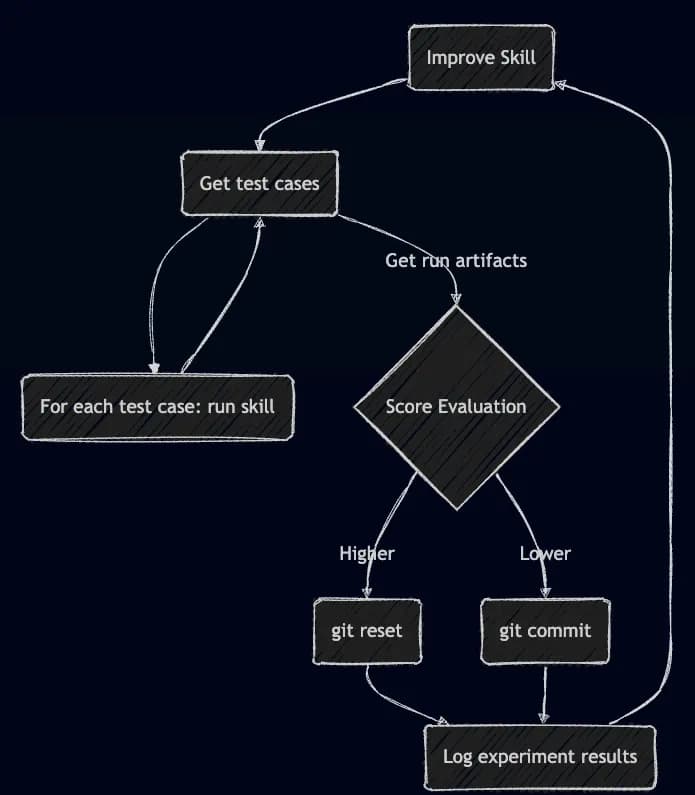

- 本論文は、101言語にわたる翻訳を改善しつつ高資源言語の性能を維持する、モノリンガルテキストのみを用いる強化学習法である WALAR を提案します。

- 単語アライメントと言語アライメントを適用して RL 報酬を洗練させることで、ソースベースの多言語品質評価モデルの穴を緩和します。

- 著者らは WALAR を用いて 101 言語の翻訳向けに LLM を訓練し、Flores-101 データセットにおける 1400 の言語方向で LLaMAX を上回ったと報告しています。

- このアプローチは低リソース言語に対する並列データへの依存を減らし、モノリンガルデータが多言語翻訳の大きな改善を駆動できることを示しています。

- 本研究は、多言語NLPにおける RL の報酬設計とアライメントの重要性を強調し、多言語 LLM のスケーリングに対する幅広い示唆を示しています。