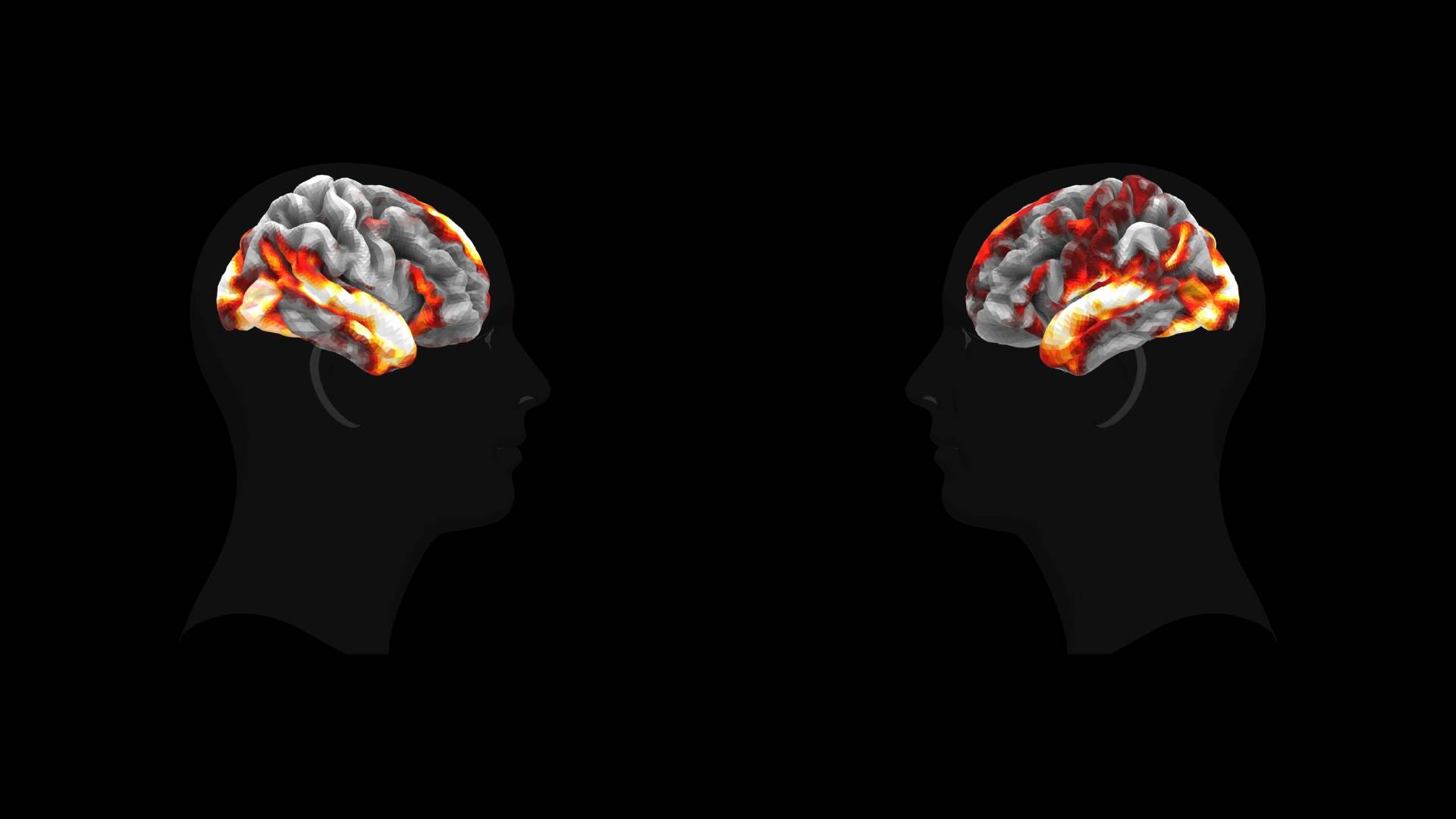

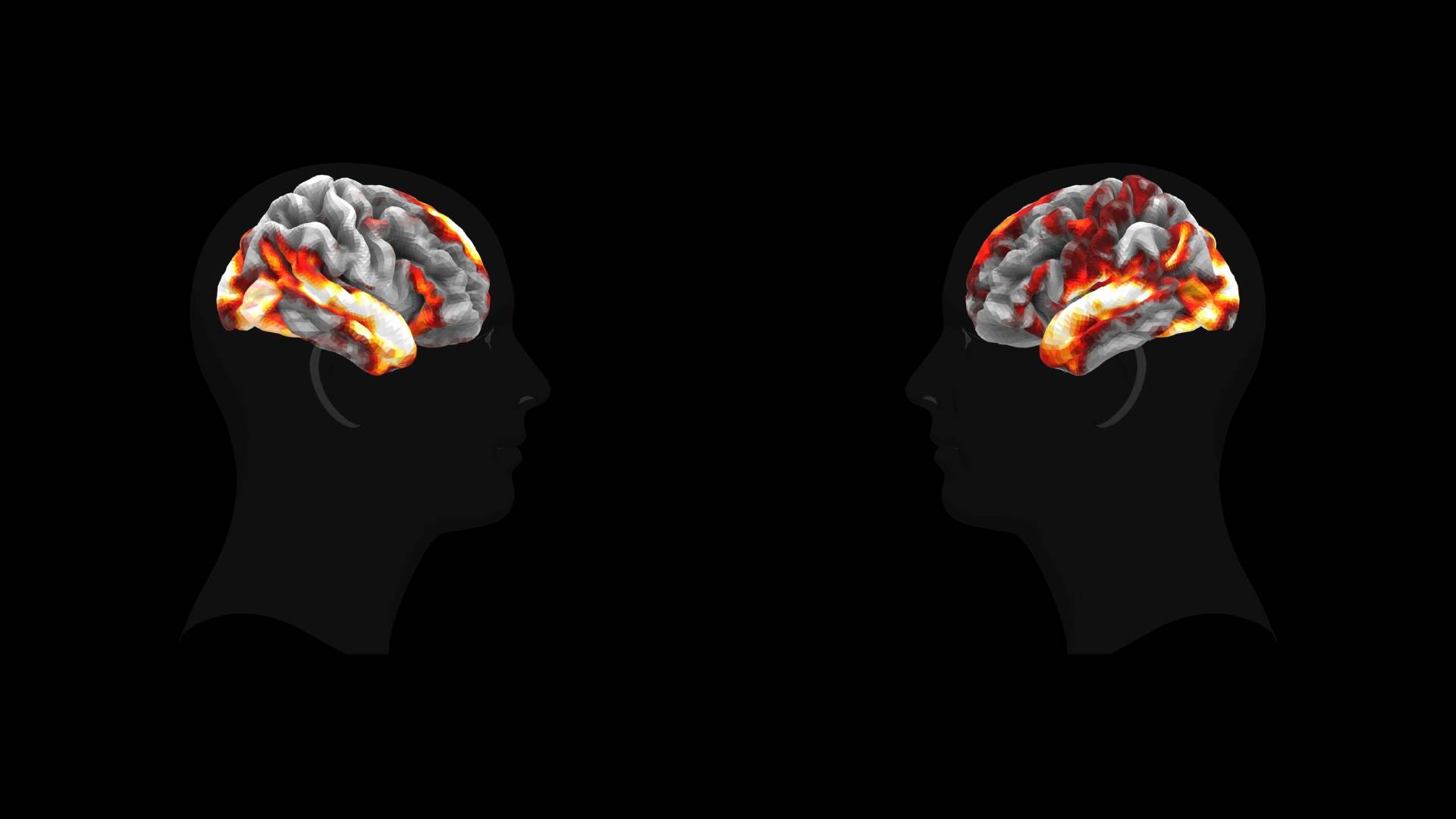

Metaは、人間の脳が画像、音、そして音声にどう反応するかを予測するAIモデルを構築しました。テストでは、特定の1人の実際のスキャンよりも、その予測のほうが典型的な脳の反応により近い結果となりました。

この記事 Metaの新しいAIモデルは、あなたの脳が画像、音、音声にどう反応するかを予測します は、The Decoder に最初に掲載されました。

THE DECODER / 2026/3/28

Metaは、人間の脳が画像、音、そして音声にどう反応するかを予測するAIモデルを構築しました。テストでは、特定の1人の実際のスキャンよりも、その予測のほうが典型的な脳の反応により近い結果となりました。

この記事 Metaの新しいAIモデルは、あなたの脳が画像、音、音声にどう反応するかを予測します は、The Decoder に最初に掲載されました。