LLMアーキテクチャを理解するための私のワークフロー

新しいオープンウェイト・モデルのリリースを理解するための、学習重視のワークフロー

ここ数か月の間、多くの人に、私が記事や講演、そして LLM-Gallery でLLMアーキテクチャのスケッチや図を思いつくまでの、自分のワークフローを共有してほしいと頼まれました。そこで、私が普段たどっているプロセスを記録しておくと役に立つのではないかと思い、まとめることにしました。

要点だけ言うと、私は通常、まず公式の技術レポートから始めます。しかし最近は、特に業界のラボが公開しているオープンウェイトの多くのモデルでは、論文が以前ほど細かく書かれていないことがよくあります。

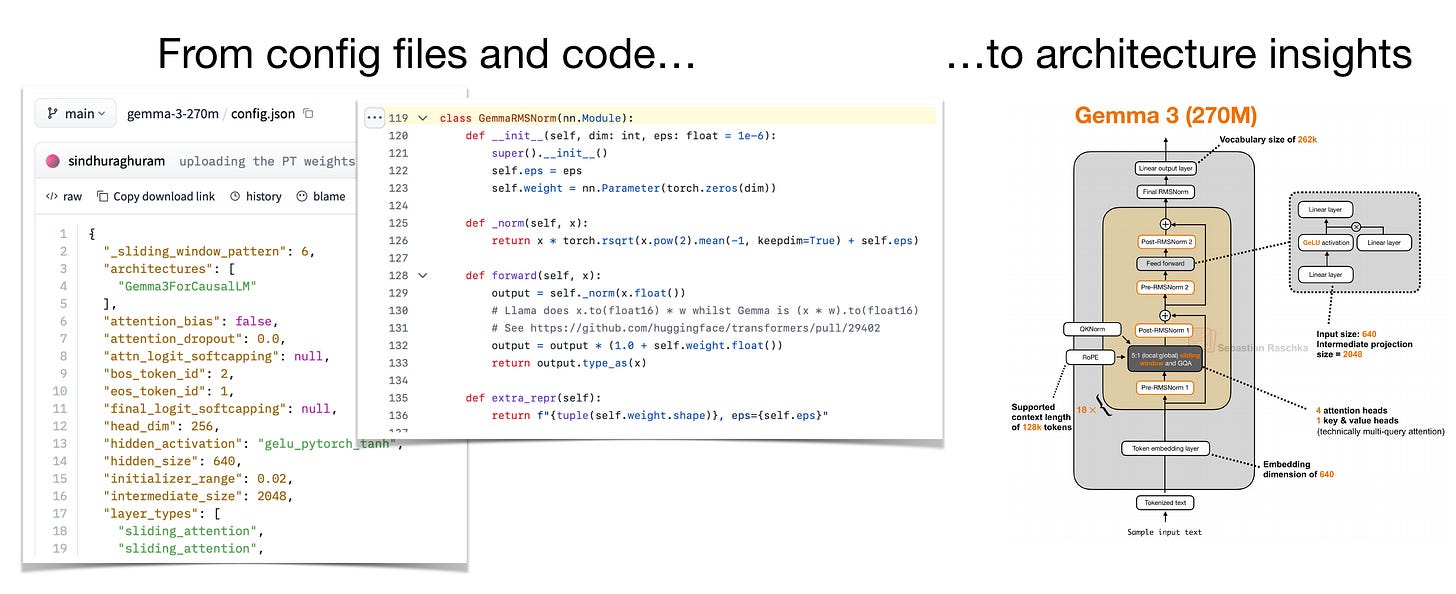

良い点は、重みがHugging FaceのModel Hubで共有されていて、モデルがPythonの transformers ライブラリでサポートされている場合、アーキテクチャの詳細に関するより多くの情報を得るために、設定ファイルと参照実装を直接調べられることです。そして「動く」コードは嘘をつきません。

また、これは主にオープンウェイトモデル向けのワークフローだということも付け加えておきます。ChatGPT、Claude、Gemini のようなモデルには実際には当てはまりません。これらは重みや詳細がプロプライエタリ(非公開)だからです。

さらに、これは意図的にかなり手作業のプロセスです。いくつかの部分は自動化できるでしょう。ですが、狙いがこれらのアーキテクチャがどのように動作するかを学ぶことなら、私の考えでは、このような作業をいくつか手作業で行うことは、やはり最高の練習の1つです。