編集者注: 本記事は Nemotron Labsのブログ・シリーズの一部であり、最新のオープンモデル、データセット、トレーニング手法が、企業がNVIDIAプラットフォーム上で専門特化したAIシステムやアプリケーションをどのように構築できるかを探ります。各投稿では、透明性のあるリサーチ・コパイロットからスケーラブルなAIエージェントまで、生産環境で本当の価値を届けるためにオープンなスタックを活用する実践的な方法を紹介します。

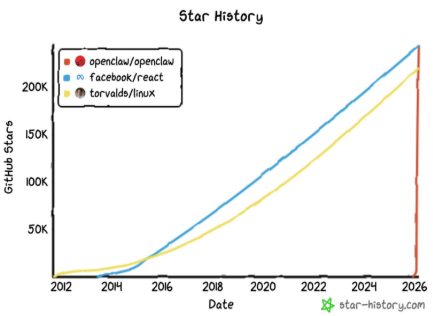

2026年初めまでに、オープンソース・プロジェクト OpenClawは一大現象となっていました。1月には、開発者の関心が急増し、GitHubのスター数が10万を超えました。コミュニティのダッシュボードやトラフィック分析では、たった1週間で200万人以上の訪問者があったことが示されています。3月までにOpenClawは25万スターでトップに躍り出て、わずか60日でReactを抜き、GitHub上で最もスターが付くソフトウェア・プロジェクトとなりました。

Peter Steinberger(Peter Steinberger)によって作られたOpenClawは、ローカルまたはプライベート・サーバー上で動作することを想定した、自社ホスト型の永続的なAIアシスタントです。このプロジェクトは、その手軽さと、限界のない自律性が注目を集めました。ユーザーはクラウド基盤や外部のアプリケーション・プログラミング・インターフェイス(API)に依存せずに、AIモデルをローカルにデプロイできました。

今日のほとんどの AIエージェントは、プロンプトによって起動され、定義されたタスクを完了すると、そのまま実行を停止します。長時間稼働する自律エージェント、つまり「claw(クロー)」は、仕組みが異なります。これらのエージェントはバックグラウンドで永続的に動作し、自分でタスクを完了させ、人間の判断が必要なものだけを表出させます。動作は心拍のように行われます。一定の間隔でタスクリストを確認し、対応が必要なことを評価し、次のサイクルまで待つか、または行動します。

OpenClawの急速な普及もまた、議論を呼び起こしました。セキュリティ研究者は、自社ホスト型のAIツールが機密データ、認証、モデル更新をどのように管理するかについて懸念を示しました。また、ローカルでの導入がユーザーに新たなリスクをもたらし得るのか疑問視する声もありました。たとえば、未パッチのサーバー・インスタンスから、コミュニティのフォークに混入した悪意のある貢献までです。寄与者や保守担当がこうした課題に対処する作業を進める中で、OpenClawの台頭は、オープン性、プライバシー、安全性のトレードオフに関する、AIエコシステム全体のより広範な議論を促しました。

OpenClawプロジェクトのセキュリティと堅牢性を高めるために、NVIDIAは SteinbergerおよびOpenClawの開発者コミュニティと協力し、潜在的な脆弱性に対処しています。詳細は OpenClawによる最近の ブログ記事 で 説明されています。

NVIDIAは、モデルの隔離を改善し、ローカルのデータアクセスをより適切に管理し、コミュニティのコード提供を検証するためのプロセスを強化することに焦点を当てたコードとガイダンスを提供します。目的は、OpenClawの独立したガバナンスを維持しつつ、オープンかつ透明性のある方法でセキュリティとシステム面の専門知識を提供することで、プロジェクトの勢いを支えることです。

長時間稼働するエージェントをエンタープライズ向けにより安全にするため、NVIDIAはNVIDIA NemoClawも導入しました。これは参照実装であり、単一のコマンドでOpenClaw、NVIDIA OpenShellのセキュア・ランタイム、ならびにネットワーク、データアクセス、セキュリティに対して強化されたデフォルト設定を備えたNVIDIA Nemotronのオープン・モデルをインストールします。NemoClawは、組織がより安全にclawsをデプロイするための設計図として機能します。

推論需要はAIの波が来るたびに増幅する

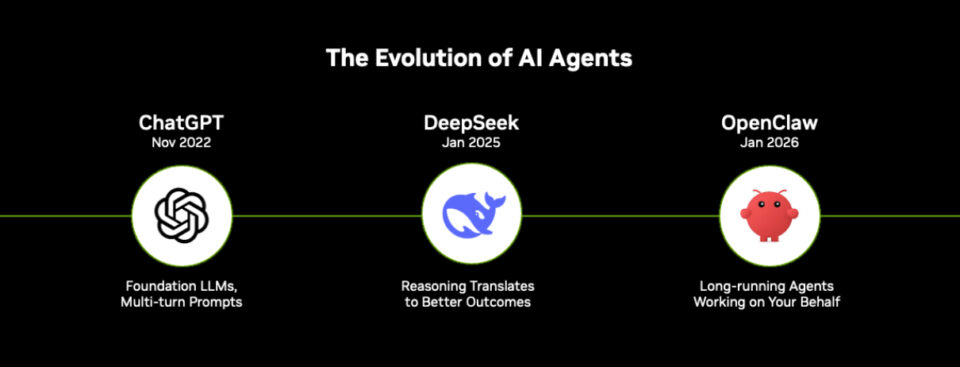

AIはすでに4つの段階を経ており、各段階の間隔は短くなっています。予測型AIが主流になるまでには何年もかかりました。 生成AIは、より速いペースで広まりました。 推論AIは、さらに速く到来しました。OpenClawが表している自律AIは、さらに加速したスピードで進んでいます。

各波で増えていくのは 推論(inference)の需要です。生成AIは予測型AIよりも トークン使用量を増やしました。推論AIではさらに100倍に増えました。継続的に動作し、長い時間軸にまたがって行動する自律エージェントは、推論AIに対してさらに1,000倍の推論需要を押し上げます。各波は必要となる計算(コンピュート)を乗数的に増やしていきます。

トークン使用量のこの増加は、組織の生産性を桁違いに高めることを可能にしています。たとえば、長時間稼働するエージェントは、研究者が一晩かけて問題を解くのを助けたり、数千の設定にわたって設計を反復したり、システムを監視して人間の判断を必要とする異常だけを取り上げたりできます。これにより、研究者の作業時間をより価値の高いタスクに振り向けられるようになります。

ツールの選び方: 「claw」をデプロイするのはいつか

生成AIは、要求に応じたタスクの定番として定着しましたが、永続的な「心拍(heartbeat)」を持つclawには、特定のシナリオで明確な利点があります。標準的なプロンプトベースのAIから長時間稼働するエージェントへ移行するかどうかは、しばしばワークフローの性質に左右されます。

- 「オンデマンド」から「常時稼働」へ:標準モデルは、即時に人がトリガーする質問に対しては非常に優れていますが、爪(クロー)は、手動で開始せずに継続的なバックグラウンド監視や定期的なシステムチェックが必要なタスクでは、しばしばより適しています。

- 高反復ループの管理:数千の化学組み合わせのテストやインフラのストレステストのシミュレーションのような複雑な問題では、クローは、人の介入によってボトルネックになりがちな反復の膨大な量を処理できます。

- 提案からアクションへの切り替え:多くのワークフローでは、標準的なAIは情報の提供や下書きの作成に使われます。目標が、AIを実行フェーズへ移行させることである場合──APIと連携する、データベースを更新する、長い時間軸にわたってファイルを管理する──そのときにクローが検討されることがよくあります。

- リソース最適化:トークンを大量に消費する大規模な推論タスクでは、 NVIDIA DGX Sparkのような専用ハードウェア上にローカルのクローをデプロイすることで、高頻度のクラウドAPI呼び出しと比べて、コストをより予測可能にし、データのプライバシーも保護できます。

長時間稼働する自律エージェントを、組織はどのように使っているのでしょうか?

長時間稼働する自律エージェントの実用的な活用は、あらゆる機能と業界にまたがっています。

金融サービスでは、エージェントが取引システムや規制フィードを継続的に監視し、朝のレビューの前に重要な出来事を検知・フラグ付けします。創薬では、エージェントが新しい科学文献をスキャンし、関連する知見を抽出して、研究者の介入なしにリアルタイムで社内データベースを更新します──このプロセスは以前は数週間かかっていました。

エンジニアリングや製造の分野では、エージェントはパラメータの組み合わせを数千通り試して検証することで問題分析を加速し、結果をランキングし、検討する価値のある設定をフラグ付けします──そして、こうしたことは一晩で実行できます。

IT運用では、エージェントがインフラのインシデントを診断し、既知のリメディエーションを適用し、新規の問題だけをエスカレーションします。その結果、平均の解決までの時間が「数時間」から「数分」へと圧縮されます。 ServiceNowでは、Apriel と NVIDIA Nemotron モデルを活用する AI 専門家が、自律的にチケットの 90% を解決できます。

企業は、自律エージェントを責任を持ってどのように導入できるでしょうか?

自律エージェントは、手を動かす存在です。通信を送信したり、ファイルを書き込んだり、APIを呼び出したり、稼働中のシステムを更新したりできます。エージェントが誤ったアクションを生成した場合には、現実の影響が生じます。最初から説明責任(アカウンタビリティ)のフレームワークを正しく整えることが不可欠で、自律エージェントを本番環境で導入する組織は、ガバナンスを最優先の要件として扱わなければなりません。

組織は、エージェントが何をしているのかを把握し、各ステップで推論を点検し、アクションを監査し、必要に応じて介入できるようにする必要があります。

自律エージェントを責任を持って導入する組織は、次の3つの優先事項に注力しています。

- オープンで監査可能なフレームワーク:NemoClaw は OpenClaw の MIT ライセンスのコードベースに基づいて構築されています。つまり、組織はエージェントの仕組み一式を自社で所有しているということです。組織は、エージェントがどのように作られ、デプロイされるかについて、あらゆる層を読み取り、フォークし、変更できます。この透明性により、チームはコードのレベルでシステムを理解し、制御できます。 NVIDIA Nemotron のようなオープンソースモデルをローカルで動かすことで、患者記録、法的文書、金融取引、独自の研究などの機密ワークロードを、組織自身の環境の中に維持できます。その結果、トレースデータが組織の管理下にとどまることが保証されます。

- 実行環境の保護: NemoClaw は、 OpenShell というサンドボックス化された環境の中でエージェントを実行します。そこでは、エージェントに「何ができる/できないか」を正確に定義し、開始時から明確な権限境界を強制します。

- ローカル計算: NVIDIA DGX Spark スーパーコンピュータは、常時稼働の継続的なローカル推論に向けて設計された、デスクサイド型の形態でデータセンターレベルのGPU性能を提供します。さらに、ローカルでのモデルホスティングとデータ管理により、データを組織の環境内に保持できます。 NVIDIA DGX Station システムは、複雑で長時間にわたるワークロードにわたって複数のエージェントを同時に動かすチーム向けに、この能力を拡張します。

実際に自律エージェントが何を行うのかを定義している組織は、価値あるものを蓄えています。つまり、ライブな運用学習が数か月分、実際のワークロードを通じて開発されたガバナンスのフレームワーク、そして本当に役に立つようになっている「組織の文脈」を吸収したエージェントです。この土台は、時間とともにさらに深まっていくでしょう。

NVIDIA NemoClaw から始めましょう

手順に沿ったチュートリアルにアクセスしてください。 NVIDIA DGX Spark 上で NemoClaw を使って、より安全な AI エージェントを構築する方法。NemoClaw が、1つのコマンドでより安全で常時稼働の AI アシスタントをどのようにデプロイできるかを探ってみてください。

NVIDIA Nem oClaw を試してみてください。 GitHub で利用でき、そして DiscordのDiscordで DGX Spark 上で NVIDIA Nemotron 3 Super と Telegram を使った NemoClaw を構築する開発者コミュニティ に参加してください。

エージェント型AIの最新情報を、NVIDIA NemotronおよびNVIDIA AIニュースを購読してチェックし、 コミュニティに参加し、NVIDIA AIをLinkedIn、Instagram、X、Facebookでフォローしてください。

オンデマンドの ビデオチュートリアルとライブ配信をぜひご覧ください。