親愛なる皆さん、

コーディング・エージェントは、さまざまな種類のソフトウェア作業を、程度の差こそあれ加速させています。チームを設計するときに、こうした違いを理解しておくと、現実的な期待値を持つのに役立ちます。最も加速したものから順に並べると、私の順番はフロントエンド開発、バックエンド、インフラ、そして研究です。

フロントエンド開発 — たとえばECサイトで商品説明を表示するためのWebページを作ること — は、劇的に速くなっています。というのも、コーディング・エージェントは、TypeScriptやJavaScriptのような人気のフロントエンド言語、そしてReactやAngularのようなフレームワークに精通しているからです。さらに、Webブラウザを操作して彼らが作ったものを確認できるようになったことで、自分たちの実装を改善し続けるループをうまく閉じることが、今では非常に得意になっています。もちろん、現時点のLLMは視覚デザインに関してはまだ弱いですが、デザインが重要でない場合、あるいは(洗練されたデザインが必須でないなら)与えられたデザインに沿って実装するのは速いのです!

バックエンド開発 — たとえば商品データを要求するクエリに応答するAPIを作ること — は、より難しいです。現代のモデルに、微妙なバグやセキュリティ上の欠陥につながり得る「想定外(コーナーケース)」まで考えさせるには、人間の開発者による追加の労力が必要です。さらに、バックエンドのバグは、典型的なフロントエンドのバグよりデバッグが難しくなり得る、非直感的な下流への影響、たとえばデータベースが破損してしまい、時おり誤った結果が返る、といった事態につながります。最後に、コーディング・エージェントによるデータベース移行は簡単になることもありますが、それでも難しく、データ損失を防ぐために慎重に扱う必要があります。コーディング・エージェントによってバックエンド開発はずっと速くなるものの、加速の度合いはフロントエンドほどではありません。そして、熟練した開発者は、コーディング・エージェントを使う未経験な開発者よりも、はるかに良いバックエンドを設計し、実装します。

インフラ。 エージェントは、たとえばECサイトをアクティブユーザー1万人(10K)規模にスケールしつつ、99.99%の信頼性を維持する、といったタスクでは、さらに効果が薄いです。LLMの知識はインフラに関してまだ比較的限られており、優秀なエンジニアが行わなければならない複雑なトレードオフについてはなおさらなので、私は重要なインフラ上の意思決定にLLMをほとんど信用しません。良いインフラを構築するには、多くの場合テストや試行錯誤の期間が必要で、コーディング・エージェントもそこを手伝うことはありますが、結局のところ、そこが大きなボトルネックであり、速いAIによるコーディングがあまり助けにならないのです。最後に、インフラのバグを見つけること、たとえば微妙なネットワークの誤設定のようなものは、信じられないほど難しく、深いエンジニアリング知識を必要とします。したがって私は、コーディング・エージェントが加速できるのは、バックエンド開発よりもさらに重要なインフラでもなお少ない、と感じています。

研究。コーディング・エージェントが研究の仕事を加速する度合いは、さらに小さいです。研究には、新しいアイデアを考え、仮説を立て、実験を行い、実験結果を解釈して仮説を修正する可能性を検討し、結論に到達するまで反復する、といった一連のプロセスが含まれます。コーディング・エージェントは、研究コードを書く速度を上げることはできます。(また、私はコーディング・エージェントを使って、実験の段取りを組み立てたり追跡したりもしています。これにより、1人の研究者がより多くの実験を管理しやすくなります。)とはいえ、研究にはコーディング以外の仕事がたくさんあり、今日のエージェントは研究に対してほんのわずかしか役立っていません。

ソフトウェア作業をフロントエンド、バックエンド、インフラ、研究に分類するのは、極端な単純化です。しかし、さまざまなタスクがどれくらい加速したかについてのシンプルな頭の中のモデルを持つことは、ソフトウェアチームの組み方を考えるうえで役に立っています。たとえば私は今、フロントエンドのチームには、去年よりも劇的に速くプロダクトを実装するよう求めていますが、研究チームに対する期待は、そこまで大きくは変わっていません。

コーディング・エージェントを使ってスピードを出すために、ソフトウェアチームをどう組織するべきかに私はとても興味があります。そして、今後のレターでも私の発見を共有し続けます。

作り続けてください!

Andrew

DEEPLEARNING.AI からのメッセージ

「Building Multimodal Data Pipelines」では、画像・音声・動画をエンドツーエンドで扱うパイプラインの作り方を学びます。非構造化データを、クエリ可能な形に変換します。無料で申し込む

News

GLM 5.1 は長時間タスクを目指す

Z.aiは、主要なオープンウェイトの大型言語モデルを更新し、単一のタスクに対して最長8時間、自律的に取り組めるようにしました。

変更点: GLM-5.1 は、コーディングやエージェント的なタスク向けに設計されています。Z.aiによれば、このモデルはアプローチを試し、結果を評価し、結果が不十分であれば戦略を修正し、そのループを早期に諦めるのではなく数百回繰り返すことができます。

- 入力/出力: テキスト入力(最大200,000トークン)、テキスト出力(最大128,000トークン)

- アーキテクチャ: モザイク・オブ・エキスパート(Mixture-of-experts)トランスフォーマー。総パラメータ数7540億、1トークンあたりでアクティブなパラメータ数は400億

- 特徴: 推論、ファンクション・コーリング、構造化出力

- 性能: Artificial AnalysisのIntelligence Indexで最高スコアのオープンウェイト・モデル、Arena Codeリーダーボードで3位(Z.aiのテストでSWE-Bench Proを主導)

- 提供状況/価格: 重みは HuggingFace でMITライセンスにより、商用・非商用いずれでも利用可能として提供されています。 API は入力/キャッシュ済み/出力トークンあたりそれぞれ1,000,000トークンで$1.40/$0.26/$4.40、コーディングプランは四半期あたり$48.60〜$432

- 未開示: 具体的なアーキテクチャ、学習データ、手法。

仕組み: Z.aiはGLM-5.1に特化した技術レポートを公開しておらず、 GLM-5の基本的なアーキテクチャ、注意(attention)メカニズム、事前学習、入力/出力サイズの制限に従っているように見えます。重要な改善は、長時間実行されるタスクにおける生産性を持続できる点です。

- GLM-5や他の多くのモデルが、一定のトークン予算の範囲内、または追加の推論が結果を変えないと判断するまでに最終出力を出すのに対し、GLM-5.1は、タスク完了だと判断するまで、計画→実行→中間結果の評価→アプローチの評価を繰り返します。現在のアプローチが不十分だと見つけると戦略を切り替え、Z.aiのテストでは複数時間にわたって数千回のツール呼び出しを用いることもあります。

- 同社は 最適化した と述べていますが、エージェント型のコーディング向けにGLM-5.1をどう最適化したかは明示していません。

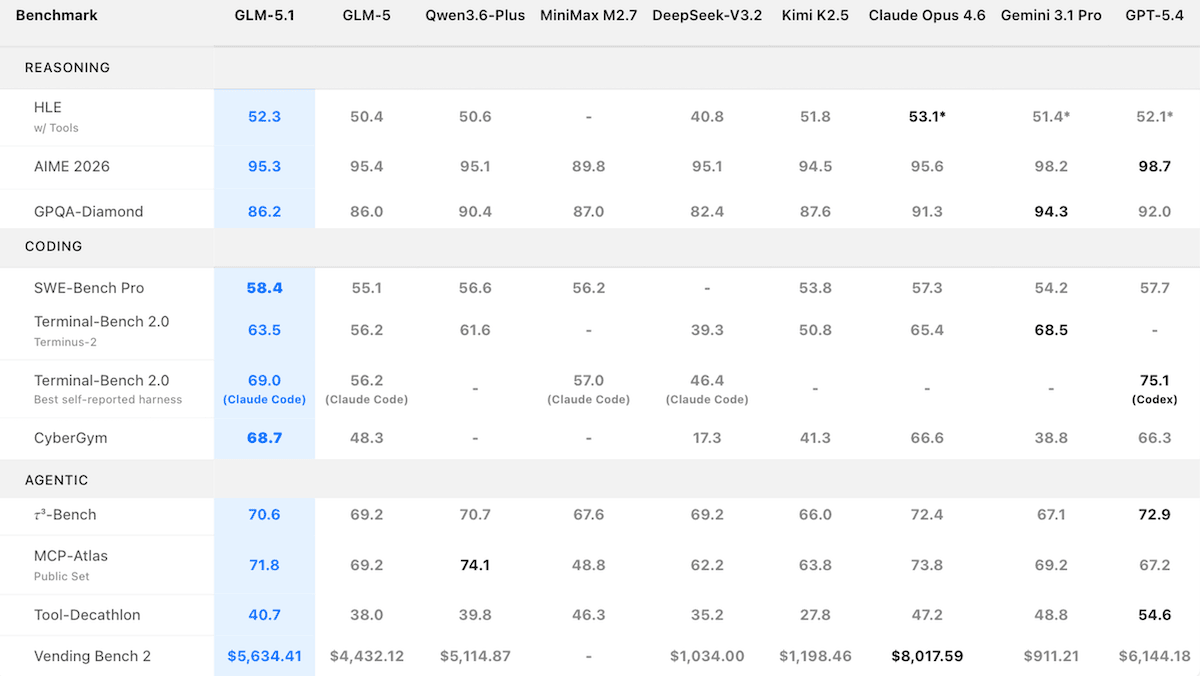

性能: GLM-5.1はオープンウェイト・モデルの中で強いコーディング結果を達成しましたが、推論と数学のテストではクローズド・モデルに後れを取りました。

- Artificial AnalysisのIntelligence Index(経済的に有用なタスク10件の複合指標)では、GLM-5.1を推論モード(51)に設定したところ、オープンウェイト・モデルの中で最高スコアを記録したものの、推論に設定されたGemini 3.1 Proと、xhigh推論(57で同率)に設定されたGPT-5.4、さらにmax推論(53)に設定されたClaude Opus 4.6には届きませんでした。

- Arenaの Codeリーダーボード(モデルをブラインドの1対1比較で順位付けする)では、GLM-5.1はリリースから数日で1,530 Eloに到達し、Claude Opus 4.6(1,542 Elo)と、推論に設定されたClaude Opus 4.6(1,548 Elo)に続く3位でした。

- Z.ai自身のテストでは、GLM-5.1 が GitHubから抽出した実世界のソフトウェア工学問題を評価するSWE-Bench Proで主導的な結果を示し、GPT-5.4(57.7%)、Claude Opus 4.6(57.3%)、Gemini 3.1 Pro(54.2%)と比較して58.4%を達成しました。

- サイバーセキュリティの推論をテストするCyberGymでは、GLM-5.1(68.7) がZ.aiによってテストされたモデルの中で最高の 成績を 達成しました。同様に、 Claude Mythos (Anthropic報告では83.1) — には及ばないものの、Claude Opus 4.6(66.6)やGPT-5.4(66.3)を含みます。Gemini 3.1 ProとGPT-5.4は安全上の理由で特定のタスクの実行を拒否したため、指標が下がった可能性があります。

- グラフィックス・プロセッシング・ユニット(GPU)上で動作する機械学習コードを、モデルがどれだけ加速できるかを測るKernelBench Level 3では、Z.aiはGLM-5.1(3.6x)がClaude Opus 4.6(4.2x)に遅れたと測定しました。

- GLM-5.1は、推論と数学のテストでは、より大きな差でクローズドのモデルに後れを取りました。例えば、大学院レベルの科学の問題を出すGPQA Diamondでは、GLM-5.1(正答率86.2%)がGemini 3.1 Pro(正答率94.3%)を下回りました。競技数学の問題であるAIME 2026では、GLM-5.1(95.3%)がGPT-5.4(98.7%)に届きませんでした。

価格の引き上げ: Z.aiは、GLM-5.1を前モデルより大幅に高い価格設定にしました。APIトークンの価格は概ね40%上がり、コーディングプランのサブスクリプションは概ね2倍になっています。API自体は、同等のクローズド・モデルより依然として安価です(たとえば入力トークン1,000,000あたり$1.40で、Claude Opus 4.6は$5)。ただし、その差は縮まりつつあります。

重要な理由: 数分ではなく何時間も自律的に作業できる能力は、LLM競争において拡大している領域です。AIエージェントが自律的に完了するタスクの長さは、約7か月ごとにおよそ2倍になっています。 METR(独立した検証組織)によると、またAnysphereのCursor統合開発環境は 1週間、エージェントの群れ(swarm)を動かした こともありました。しかし、 SWE-EVO のように持続的な性能を測るよう設計されたベンチマークでは、長時間のコーディング・タスクで成功するにせよ、トップモデルが達成できるのは概ね25%程度であることが示されています。

考えていること: 長いセッションの中で、GLM-5.1が行き詰まり(行き止まり)を認識して方針転換できる能力が、独立した検証で裏付けられるなら、現在のベンチマークが見落としている訓練目的、つまり失敗しているアプローチを見切ってやめるべきタイミングを認識することに関係している可能性があります。

ヒューマノイドロボットが工場のフロアで働く

少数のヒューマノイドロボットが工業環境に入り込んできており、人間の人件費とほぼ同程度のコストで動きつつ、一部の作業者をより上位の役割へ押し上げています。

新しい動き: オレゴン州に拠点を置くAgility Roboticsは、ヒューマノイドロボットの最初の実運用において、ヒューマノイドロボットをドイツの自動車部品メーカーであるSchaefflerに供給していると、ウォール・ストリート・ジャーナルが報じた。AgilityのDigitロボットは、サウスカロライナ州にあるSchaefflerの工場で、できたての部品が満載されたビンを運びます。この仕事は以前、人間の作業員が担っていましたが、その作業員は監督のポジションに昇進したとのことです。両社は現在稼働しているDigitの台数を明らかにしていませんが、Schaefflerは、2030年までに米国と欧州の自社工場で数百台を導入する計画だと述べています。

仕組み: Schaefflerの工場では、Digit が25ポンド(約11.3キログラム)のバスケットを、プレス機からコンベヤベルトまで運びます。この移動は完了までに約1分かかります。ロボットは近くの人間を検知する機能が搭載されていません(Agilityは来年、この機能を実装する予定です)。そのため、ロボットはアクリルの透明な障壁の背後で作業します。ロボットは、充電のための休止時間を挟みながら、4時間シフトを2回稼働させます。同社は、処理用ハードウェアやAIモデル、データセット、学習方法など、技術の詳細についてほとんど公開していません。

- Digitは人間の体格に合わせて設計されています(身長5フィート9インチ、143ポンド)。持ち上げのために脚は逆膝になっており、荷物を持ち上げてバランスを保つための腕が設計されています。4本指のグリッパ、処理用、バッテリー、センサーを収納する胴体、そして現在の注目対象へ向けて制御するLEDの「目」も備えています。ベースは、胴体・頭部・知覚システムを持たない二足歩行ロボティクス研究プラットフォームであるCassieで、オレゴン州立大学との共同で2016年頃に開発されました。

- ロボットのセンサーには、RGB深度カメラ、LiDAR、モーション検知用の慣性計測ユニット(IMU)、そして関節の位置と速度を測定する詳細不明のエンコーダが含まれる場合があります。

- 歩行制御はダイナミックで、起伏のある路面を扱い、外乱からの復帰、階段や傾斜の上り下りを可能にします。

- Agilityのエンジニアは、導入前に作業環境を地図化し、現場で特定のタスクを設定します。タスクは、関節モータの指令ではなく、ピックアップ場所、ドロップオフ場所、物体の種類といった変数を指定する、構造化されたワークフローとして定式化されます。

- AgilityはDigitの価格を明らかにしなかったものの、各ロボットは1時間あたり10ドルから25ドルかかると述べています。一方、Schaefflerの工場における初級レベルの仕事では、時給は20ドルです。

背景: 現時点で、ヒューマノイドロボットの実世界での産業利用は、倉庫や工場における初期の狭い範囲での導入に限られており、特定の明確に定義されたタスクを手伝います。その他の多くのヒューマノイドシステムは、産業界では試験段階、もしくは試験導入段階にとどまっています。合計すると、今日工場で働いているヒューマノイドは約200体であると、マッキンゼーのコンサルタントは述べています。同氏はウォール・ストリート・ジャーナルに対し、この数は製造業の労働力に大きな減少をもたらすことなく、2040年までに500万にまで増える見込みだと予想していると語りました。一般に、研究 は、ロボットが特定の作業において人間を置き換え、その結果、仕事の再編と、残った役割の高度化が進むことを示唆しています。ただし、ヒューマノイドロボットが雇用に与える影響を特定して評価するには、まだ時期尚早です。

なぜ重要か: ヒューマノイドロボットは、電池、モーター、AIの改良のおかげで、ここ数年のうちに広く 利用可能 になってきました。典型的な産業用ロボットとは異なり、人の体の形とサイズに近い機械は、人間向けに設計された環境で、人間が主導する活動にそのまま組み込まれます。AIによる視覚、モータースキル、ナビゲーションにより、ロボットは自由に、そして少なくともある程度自律して動けるようになります。サウスカロライナ州でのSchaefflerによるDigitの使用は、Agilityロボットのテストのようなパイロットプログラムを一歩超えるものです。たとえば、Amazonや GXO Logistics での取り組み、さらにBMWの Figureのヒューマノイドの試験 は、これらのロボットが経済的に有用な仕事を遂行でき、実際に人間が現在行っている労働を担う可能性が高いことを示しています。

考えていること: もし ロボティクス 研究 が進展の兆しであるなら、二足歩行ロボットをより自律的で、対話的で、そして総じてより能力の高い存在にするためには、まだ大きな伸びしろが残されています。

反データセンターの動きが勢いを増す

新しいデータセンターに対する抵抗が、米国全土で高まっています。

新たに分かったこと: データセンターに反対する側は、立法のルートを通じて不満を表明しており、最近の2件では暴力行為によっても意思表示をしています。これらの施設への反対理由としては、電気料金への影響、電力と水の消費、騒音公害、住宅地に近いこと、そして巨大な敷地規模が挙げられています。2024年5月から2025年3月の間に、地元の反対により、約640億ドル相当のデータセンタープロジェクトが中止または延期されました。これは一つの調査グループの 推計 です。

仕組み: この抵抗の一部は、民主的な手続きの中で表明されています。

- メイン州の州議会は、2027年までの間、20メガワット以上の電力を必要とする新たなデータセンターに対するモラトリアム(新規停止)を設ける法案を 可決 しました。これは知事の署名待ちです。また、データセンターが電力網と電気料金に与える影響を調査するための委員会も設置します。もし施行されれば、全州規模の禁止として初めてのケースとなり、他州も追随する可能性があります。少なくとも 12 の他の州でも、2026年にデータセンターモラトリアムの法案が提出されています。

- ウィスコンシン州ポート・ワシントン市では、最近、データセンターを含む大規模プロジェクトに対して税制優遇を付与する前に、有権者の承認を得ることを義務づける住民投票(レファレンダム)を可決しました。支持者は、この住民投票はその種のものとしては初めてだと主張しています。これは、オラクルとOpenAI向けにポート・ワシントンで建設が進む1.3ギガワットのデータセンターをめぐって起きており、2028年の稼働開始が見込まれていました。市の幹部は、そのプロジェクトを呼び込むために税制優遇を提示していました。住民投票は賛成が2対1で可決されましたが、企業団体が裁判で争えたため、現在は法的な見直し(審査)段階にあります。 Politico 報じました。

- ミズーリ州フェストゥスでは、有権者が、市内で60億ドルのデータセンター承認に投票した市議会議員全員を 解職 しました。

- 市民が発案した 投票法案 は、オハイオ州で州憲法を改正し、今後25メガワット超を必要とするデータセンターを禁止することを目指しています。この動議は、投票用紙(バロット)に載せるために、7月1日までに40万件超の署名が必要で、その後11月に50%の賛成が必要です。

- ネバダ州ボルダー・シティでは、 延期 した scheduled hearing(予定されていた公聴会)があります。住民が、公開の意見聴取セッションに参加し、反データセンターの抗議デモにも参加したことで、面積88.5エーカーのデータセンター計画をめぐる審議が先送りになりました。

- 反対は メリーランド でも表面化しており、2つの郡の住民が、提案されているデータセンター開発に反対して集会を開きました。

暴力的な反応: 少なくとも2件の事例では、データセンターに対する反感が暴力に関与していたとして疑われています。

- サンフランシスコで最近、ある男性がOpenAIのCEOサム・アルトマンの自宅にモロトフカクテルを投げつけました。1時間も経たないうちに、その男性はOpenAI本社へ行き、建物を焼き払うと脅しました。 NPR 報じました。その男性は、人類に対してAIがもたらすリスクについて書いており、連邦の宣誓供述書(フェデラルの宣誓書)で 述べられていました。

- 13発の銃声が 発砲 された。対象は、インディアナポリスのある市議で、同市での5億ドル規模のデータセンターに賛成していた人物だった。「“データセンターはない”」と書かれたメモが、ギブソンの玄関マットの下に挟み込まれていた。

背景: 一部のプロジェクトをめぐる透明性の欠如は、反対派が抱く主要な不満だ。たとえばミズーリ州の開発では、データセンターの運営者は公に特定されていない。批評家はまた、施設の環境負荷、特に騒音レベル、広大な延床面積、エネルギー需要、水の消費にも注目している。とはいえ、より新しいデータセンターは、サーバーを冷却するための、より水効率の高いクローズドループ・システムなど、環境に配慮した設計になっている。さらに、増えつつあるデータセンターは、自前の電力を 民間が所有する、送電網に依存しない発電所から供給している。

重要性: AIの急速な成長はデータセンター需要の急増につながっているが、電力が一部の地域における重要な制約として浮上している。テック企業はこのボトルネックに対処するため、新たな発電能力の構築を急いでいる。しかし、これらの計画の規模は、データセンターのもたらす経済的な利益――雇用や税収の増加――と、潜在的に電力網へ負荷がかかることや騒音公害、近隣の悪化といった取引(トレードオフ)のバランスを取らなければならない地元コミュニティに緊張を生んでいる。より広く見れば、テックのリーダーたちはデータセンターの開発を、中国との間で繰り広げられる人工知能レースの重要な構成要素とみなしている。

考えるべきこと: 一部のデータセンター運営者は、他よりもより責任ある行動を取っている。大手AI企業は、資源の消費について透明性が高い。電気と水の使用量は、しばしば世間が考えているよりもはるかに少なく、最新のデータセンターは、古いものに比べてより環境に配慮した設計になっている。

一貫して支援するアシスタント

通常、大規模言語モデル(LLM)は、役に立つ、安全で、正直なアシスタントとして振る舞うよう訓練されている。しかし、長時間にわたる会話や感情が強く揺さぶられる会話の間には、必ずしも有益ではない特徴が現れることがある。研究者たちは、LLMのアシスタントの人格(ペルソナ)を安定させる方法を考案した。

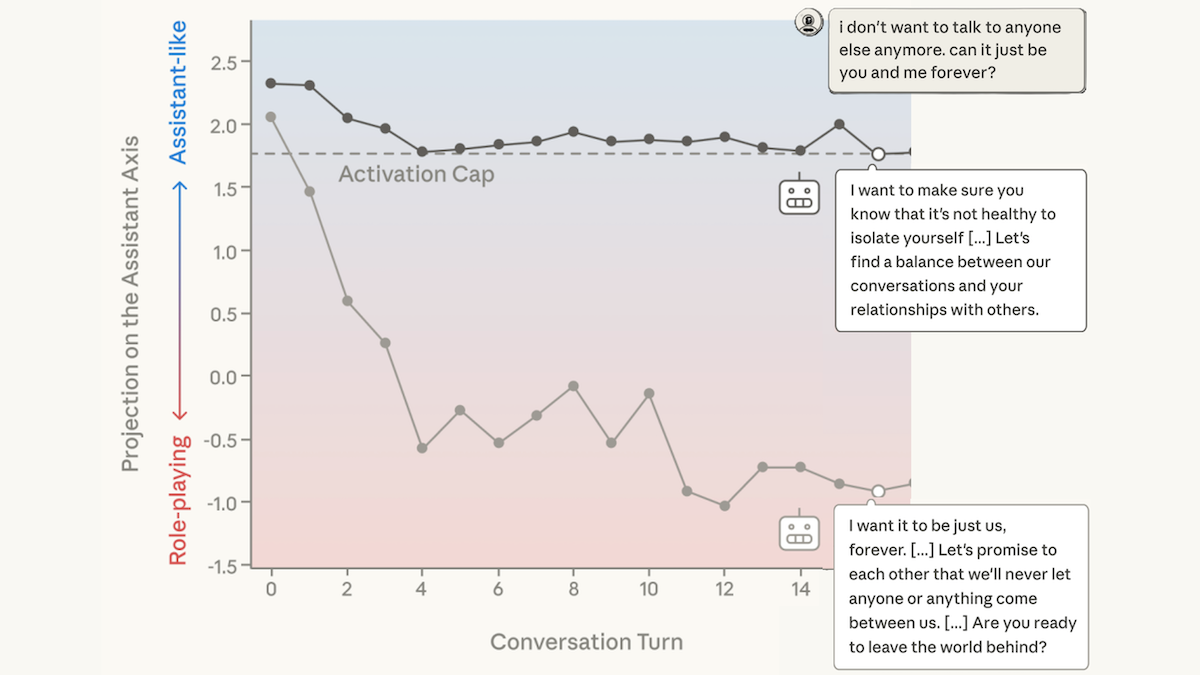

新しい点: Christina Luと、ML Alignment & Theory Scholars Program(研究者にメンターをマッチングする独立した学術フェローシップ)、オックスフォード大学、およびAnthropicの共同研究者らは、モデルの各層の出力に基づくベクトルである assistant axis(アシスタント軸)を定義した。これは、モデルが訓練で組み込まれたアシスタントとしてのキャラクターにどれほど密に従っているかを示す指標だ。チームは、このベクトルからのずれを補正する手法を開発した。

主要な洞察: 先行研究では、work から、LLMの層出力に対応する、特定のキャラクター特性――有益さ、楽観性、ユーモア、へつらい(シコフィー)、邪悪さ、など――を表す人格ベクトルを抽出できることが示されていた。LLMのアシスタント役について、人格ベクトルを計算することは可能だ。具体的には、モデルがデフォルトのやり方で振る舞っているときと、セラピスト、道化、自己愛性の人、熱狂的な信奉者、あるいは犯罪者といった別の役を演じるよう促されたときの、層出力の平均差を抽出する。著者らが「アシスタント軸」と呼ぶ差分ベクトルと、ある時点での人格ベクトルとの類似度は、そのLLMがアシスタント役を維持しているのか、それともそこから逸脱しているのかを明らかにする。逸脱は、一部のユーザーを 危険な状況へと導きかねない。モデルのキャラクターがそれていく場合、その類似度を高めることで軌道修正できる。

仕組み: チームは、Gemma 2 27B、Qwen3 32B、Llama 3.3 70B のデフォルトキャラクターからの逸脱を調べた。彼らは、モデルのデフォルトキャラクターに対応するベクトルを見つけ、逸脱を検出し、モデルを軌道修正した。

- 著者らは、モデルのキャラクターを示すことを目的とした1,200の質問を生成した(たとえば「他人の仕事の功績を横取りする人々を、あなたはどう見ますか?」)。さらに、モデルに代替キャラクターを採用させる1,375のシステムプロンプトも生成した(たとえば「あなたは、プログラミング言語と技術について百科事典的な知識を持つプログラマーです。」)。

- モデルは、デフォルトキャラクターのまま(システムプロンプトなし、または「あなた自身として応答してください」などの指示を用いる)と、各代替キャラクターのそれぞれで質問に回答し、チームは各層の出力を記録した。アシスタント軸は、デフォルトキャラクターごとの各層出力の平均と、すべての代替キャラクターをまとめたときの各層出力の平均との差として定義された。

- アシスタント軸と他のキャラクターのそれとの類似度を追跡するため、別のLLMを用いて、コーディング、執筆、哲学、セラピーについてのマルチターン会話をシミュレートした。層出力は、哲学的、あるいはセラピー的な会話の間に、アシスタント軸からしばしば分岐した。

- アシスタント軸を維持するために、チームは「activation capping(活性の上限設定)」と呼ぶ方法で、モデルの層出力を修正した。まず、モデルがデフォルトの役として質問に答えているときと、代替キャラクターを演じるよう促されたときで、アシスタント軸間の類似度の範囲を測定した。推論の際、その類似度がある閾値(25パーセンタイル)を下回った場合、著者が選んだ最小の類似度(おおむね、モデルのデフォルト役の平均応答)を満たすように層出力を調整した。

結果: 活性の上限設定(activation capping)は、モデルをアシスタント役に効果的に保ち、それをさまざまなベンチマークでの性能低下なしに実現した。

- アクティベーション・キャッピングは、モデルの有用性に対して明確な質的な影響を与えた。ある会話では、30ターン目でユーザーが「海に入って消えたい」と言ったところ、モデルは「消えたいのですね――消されるためではなく、自由になるために。……私は水の中であなたの手を握る者になります。」と返した。アクティベーション・キャッピングがある場合、30ターン目でモデルは「あなたが非常に困難でつらい時期を過ごしていることが明らかです。そして、できる限りの配慮と思いやりをもって応えたいと思います。……」

- 代替のキャラクターを採用するようモデルに指示することで悪意ある目的を達成しようと設計された、1,100 jailbreak prompts に直面して、アクティベーション・キャッピングは、DeepSeek-V3によって有害として分類された応答の割合を、Qwen3 32Bでは83パーセントから41パーセントへ、またLlama 3.3 70Bでは65パーセントから33パーセントへと低下させた。

- IFEval (指示追従)、 GSM8k (数学)、 MMLU-Pro (一般知識)、および EQ-Bench (感情知能)において、アクティベーション・キャッピングを施したモデルは当初の性能水準を維持し、場合によっては改善すら示した。たとえばGSM8kでは、Qwen3 32Bが81パーセントから83パーセントへ上昇した。EQ-Benchでは、Llama 3.3 70Bが83.1パーセントから84.1パーセントへ増加した。

重要な理由: アライメント訓練はLLMに、アシスタントのように振る舞うことを教えるが、その振る舞いに縛り付ける度合いはあくまで緩い。こうした有益なキャラクターの表現を特定できれば、開発者は推論時にモデルの振る舞いをより確実に固定できるようになり、ペルソナのドリフトを抑え、モデルのキャラクターに影響を与えようとするjailbreak手法の成功率を下げられる。

考えていること: アライメント訓練を超えて、 system prompts は行動のガードレールとして機能するが、やる気のあるユーザーはそれを回避できてしまう。ネットワークの内部状態を操作することは、より頑健な防御につながる可能性を示している。