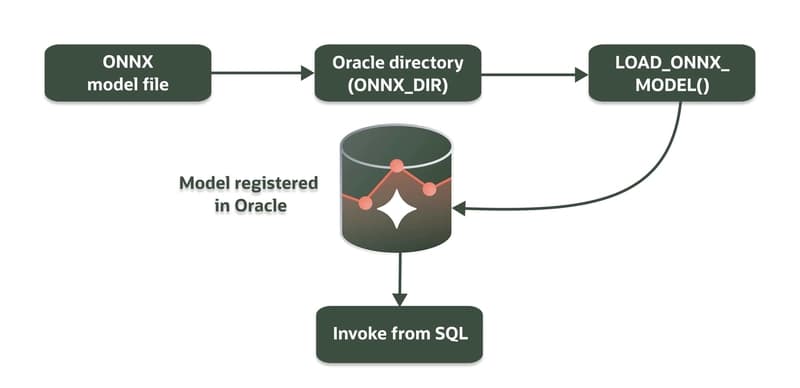

要旨: 混合エキスパート(Mixture-of-Experts: MoE)モデルは大規模言語モデルにおいて支配的なアーキテクチャとなった一方で、オンプレミスでの提供(serving)は本質的にメモリバウンドです。バッチングにより、トークン当たりの疎な計算が密なメモリアクティベーションへと変わるためです。メモリ中心のアーキテクチャ(PIM, NMP)は帯域幅を改善しますが、MoEではバッチサイズが大きいと算術強度が低いため、計算資源の活用が十分に進まないままです。推測デコード(Speculative Decoding: SD)は、アイドル状態の計算を、ターゲット呼び出しの回数削減と引き換えにするものですが、検証では、却下されたトークンであってもエキスパートを読み込む必要があり、特にバッチサイズが低い場合には、MoEにおけるこの利点が大きく制限されます。私たちは、キャッシュベースの高速化と推測デコードを統合し、バッチサイズ全体で総合的な高速化を実現する、ハイブリッドボンディング(HB)ベースのHW-SW共同設計フレームワークであるELMoE-3Dを提案します。MoEエキスパートとビット(bit)の、2つの固有の弾力性(elasticity)軸を特定し、それらを共同でスケーリングして、エキスパートキャッシュと、高HB帯域によって加速される強く整合した自己ドラフトモデルの双方として機能する、Elastic Self-Speculative Decoding(Elastic-SD)を構築します。我々のLSB拡張(LSB-augmented)されたビットスライス・アーキテクチャは、ビットスライス表現に内在する冗長性を活かし、ビットネスト実行をネイティブにサポートします。3D積層ハードウェア上で、ELMoE-3Dは、バッチサイズ1〜16にわたってxPU上で行うナイーブなMoE提供に対して平均6.6 imesの高速化と4.4 imesのエネルギー効率向上を達成し、さらに、最も性能の良い先行アクセラレータのベースラインに対して2.2 imesの高速化と1.4 imesのエネルギー効率向上を提供します。

ELMoE-3D:MoEの固有の弾性を活かしたハイブリッド・ボンディング対応セルフ自己推測デコーディングによるオンプレミス推論サービング

arXiv cs.LG / 2026/4/17

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- ELMoE-3Dは、オンプレミスでのMoEサービングにおける主要なボトルネックである、バッチングによりスパースなMoE計算が密なメモリ活性へ変わりメモリ帯域が律速になる点に着目しています。

- 本研究は、キャッシュベースの高速化と推測デコーディングを、ハイブリッド・ボンディング対応のハードウェア帯域を用いたHW-SW協調設計の枠組みで統合します。

- Elastic Self-Speculative Decoding(Elastic-SD)を提案し、MoEエキスパートとbit-andにおける固有の弾性を同時にスケールさせることで、エキスパートキャッシュと整合度の高い自己ドラフトモデルとして機能させます。

- LSB拡張のビットスライス構成により、ビットスライス表現の冗長性を活用してビットネスト実行をネイティブにサポートします。

- 3DスタックのxPU上で、ELMoE-3Dは(バッチサイズ1〜16で)素朴なMoEサービングに対して平均6.6×の高速化と4.4×のエネルギー効率向上を達成し、さらに先行する最良のアクセラレータ基準に対して2.2×の高速化と1.4×のエネルギー効率向上を示します。