要旨: 大規模言語モデル(LLM)の急速な普及により、自動化された査読への関心が高まっています。しかし現状では、査読を主として評価予測タスクとして扱うベンチマークが進展を妨げています。私たちは、査読の有用性はスカラー値の得点ではなく、その文章による正当化――議論、質問、そして批評――にあると主張します。これに対処するために、本稿では Beyond Rating(評価を超えて)という全体論的な評価フレームワークを導入し、AI査読者を5つの次元、すなわち Content Faithfulness(内容の忠実性)、Argumentative Alignment(議論の整合性)、Focus Consistency(焦点の一貫性)、Question Constructiveness(質問の建設性)、AI-Likelihood(AIらしさ)に基づいて評価します。特に、妥当な専門家間の意見の相違を許容するための Max-Recall 戦略を提案し、さらに手続き上のノイズを厳密に除去した、高い確信度を持つ査読が付与された論文のための厳選データセットを構築します。大規模な実験の結果、従来の n-gram 指標は人間の嗜好を反映できない一方で、私たちが提案するテキスト中心の指標――特に弱点に関する議論の想起(recall)――は、評価の正確さと強く相関することが示されました。これらの知見は、信頼できる自動スコアリングのための前提として、AIの批評における焦点を人間の専門家と一致させることが必要であることを明確にし、今後の研究に対する堅牢な基準を提供します。

Beyond Rating:AIレビューの包括的評価とベンチマーク

arXiv cs.CL / 2026/4/22

📰 ニュースIdeas & Deep AnalysisModels & Research

要点

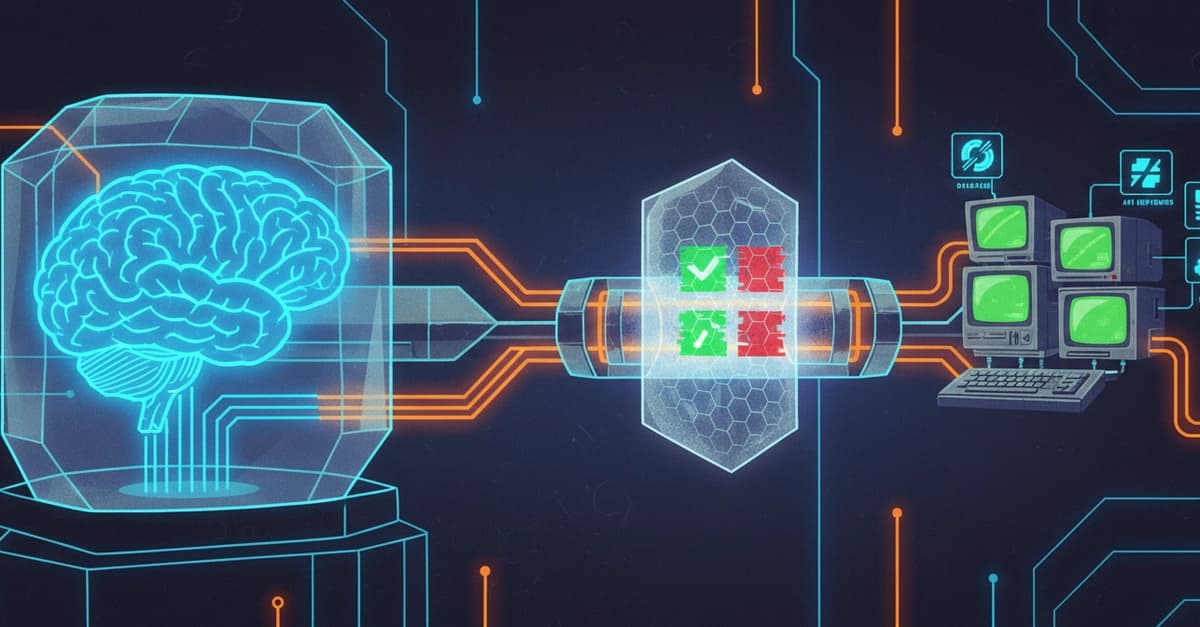

- 本論文は、AIの査読はスカラー値の評価予測だけでなく、文章による正当化(主張、質問、批評)の質で評価されるべきだと主張している。

- 「Beyond Rating」という枠組みを提案し、AIレビュアーを5つの観点(内容の忠実性、論証上の整合、焦点の一貫性、質問の建設性、AIらしさ)でベンチマークする。

- 有効な専門家間の意見の相違を評価に反映するために、Max-Recall戦略を提案している。

- 手続き的なノイズを厳密に除去した、高信頼度のレビューを含む厳選データセットも提供する。

- 実験では、従来のnグラム指標は人間の嗜好を反映できず、特に「弱点に関する主張」のリコールなどのテキスト中心の指標が評価精度と強く相関することが示されている。