米Metaは4月8日(現地時間)、Superintelligence Labs立ち上げ後初のAIモデル「Muse Spark」を発表した。「Meta AI」アプリおよびWeb版(meta.ai)を通じて一般ユーザーへの提供を開始した。今後数週間以内に、「WhatsApp」「Instagram」「Facebook」「Messenger」などのMeta製アプリに順次ロールアウトされる予定だ。

「Muse Spark」は、視覚情報の統合やツールの利用、マルチエージェントの連携をサポートするためにゼロから構築されたネイティブなマルチモーダル推論モデル。初期モデルとして小型かつ高速に設計されているのが特徴で、モデルのアーキテクチャ、最適化、データキュレーションを改善した結果、以前の同社のモデル「Llama 4 Maverick」と比較して「1桁以上少ない計算量で同等の能力に到達できる」としている。

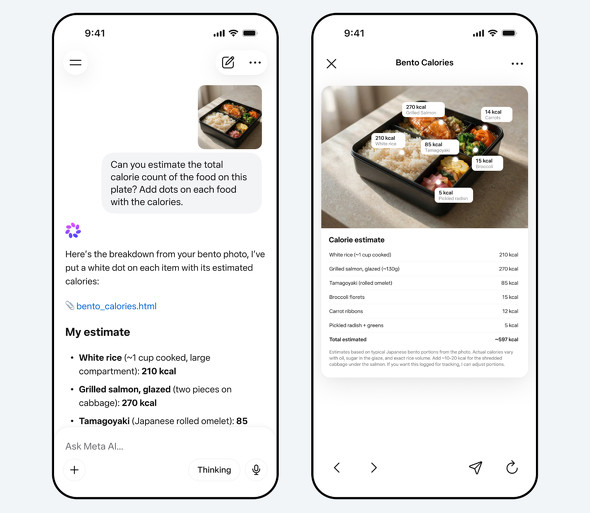

テキストによる指示だけでなく、ユーザーが見ている世界を視覚的に理解できるのが大きな特徴だ。例えば、スマートフォンのカメラで撮影したスナック菓子をタンパク質量の多い順にランク付けしたり、製品をスキャンして代替品と比較したりすることができる。

「Ray-Ban Meta」シリーズなどの同社のAIメガネにも統合する。モデルの高度な視覚認識機能がAIメガネに搭載されることで、アシスタントがユーザーの周囲の環境をより正確に見て理解できるようになる。

また、1000人以上の医師と協力して学習データがキュレーションされており、健康に関する複雑な質問に対しても画像やグラフを用いて詳細に回答できるという。

さらに、プロンプトからWebサイトやミニゲームを作成する視覚的コーディング機能や、複数のAIエージェントが並行して推論を行って複雑な問題に対処する「Contemplating(熟考)モード」も搭載している。

マーク・ザッカーバーグCEOはFacebookへの投稿で「9カ月前に超知能(superintelligence)をあらゆる人の手に届けることを目指してMeta Superintelligence Labsを設立した」と振り返り、その最初のマイルストーンとしてMuse Sparkを発表したと語った。将来の展望については、「今後は新しいオープンソースモデルを含め、知能の限界を押し広げる、より高度なモデルをリリースしていく計画だ。単に質問に答えるだけでなく、あなたのために行動するエージェントとなる製品を構築している」という。

なお、本モデルはMeta製品専用というわけではなく、選ばれた一部のパートナー企業向けにはAPIを通じたプライベートプレビューとしても提供される。

関連記事

Meta、自社製AIチップ「MTIA」新モデルと次世代データセンター構想発表

Meta、自社製AIチップ「MTIA」新モデルと次世代データセンター構想発表

Metaは、AI関連タスクに特化した自社製カスタムチップ「MTIA」シリーズの最新4モデルを公開した。推論処理の最適化とコスト削減を狙い、開発サイクルを大幅に短縮。並行して、NVIDIA製GPUを大量投入した巨大クラスタの構築や、将来的な5GW規模の超巨大データセンター「Hyperion」の稼働計画も進めている。 Meta、AIエージェント向けSNS「Moltbook」を買収 創設者はMSL入り

Meta、AIエージェント向けSNS「Moltbook」を買収 創設者はMSL入り

MetaがAIエージェント専用SNS「Moltbook」を買収したとAxiosが報じた。開発チームは次世代AI部門に参画する。Metaは当面サービスを継続する方針だが、将来的には技術統合による単独サービスの終了も示唆している。 MetaのザッカーバーグCEO「超知能に数千億ドル投資する」 「Superintelligence Labs」に初言及

MetaのザッカーバーグCEO「超知能に数千億ドル投資する」 「Superintelligence Labs」に初言及

MetaのザッカーバーグCEOが「超知能」研究への数千億ドル規模の投資を表明。才能豊かな人材を集めて「Superintelligence Labs」を編成し、GW級の巨大なAIスパコンクラスタも複数構築する。 Meta、ネイティブマルチモーダルAI「Llama 4」発表 最小モデルは「H100」1枚で利用可能

Meta、ネイティブマルチモーダルAI「Llama 4」発表 最小モデルは「H100」1枚で利用可能

Metaは、マルチモーダルなLLMファミリー「Llama 4」を発表した。Llamaシリーズで初めて、MoEアーキテクチャを採用した。「Scout」「Maverick」「Behemoth」の3種類で、Behemoth以外は既にダウンロード可能だ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia AI+メールマガジン」の登録が必要です