親愛なる皆さま、

AIにバブルはあるのでしょうか?OpenAIの1.4兆ドル計画やNvidiaが一時的に5兆ドルの時価総額に到達するなどAIインフラへの巨額の資金投入がある中、多くの人々が投機や過剰な期待によってAI投資の価値が持続可能な水準を超えているのか疑問を持っています。しかし、AIは単一のものではなく、分野ごとにバブルの度合いは異なります。

- AIアプリケーション層:投資不足があります。潜在的な可能性は多くの人が思う以上に大きいです。

- 推論用AIインフラ:依然として大幅な投資が必要です。

- モデル学習用AIインフラ:この分野については慎重ながら楽観的ですが、同時にバブルの可能性も否定できません。

注意:これは投資助言ではありません!

AIアプリケーション層。今後10年にわたり新しいAI技術を使った多くのアプリケーションが生まれるでしょう。LLM APIのようなAIインフラや技術の上に構築されるアプリケーションはほぼ定義上、そのインフラよりも価値が高くなければなりません。なぜなら、そのアプリケーションでインフラや技術提供者への対価を支払う必要があるからです。

私はエージェント的なワークフローを応用する多くの企業の新たな兆候を目にしており、これらは確実に成長すると確信しています。一方で、多くのベンチャーキャピタリストは勝者の見極めが困難であり、10億ドル規模のAIインフラ構築の方がより理解されているため、AIアプリケーションへの投資に慎重です。また、ほぼすべてのAIアプリケーションが最先端のLLM企業に基盤モデルの改善によって駆逐されると考える誇大広告にも影響されています。全体として、AIアプリケーションへの投資は著しく不足しており、私のベンチャースタジオであるAI Fundではこの分野に大きく注力しています。

推論用AIインフラ。今日のAIの低浸透率にもかかわらず、処理能力に対する需要の急増に供給が追いつかず、多くのインフラプロバイダーが苦闘しています。私のチームの多くが推論容量の十分な確保に懸念を示しており、コストや推論スループットがより多くの利用を制限しています。需要制約でなく供給制約というのは良い問題です。需要不足はもっと一般的な問題ですが、供給不足はそれでも問題であり、業界が推論能力の拡大に注力しているのは喜ばしいことです。

トークン生成への高需要の具体例として、高度なエージェント的コーダーの進歩があります。私は以前からClaude Codeのファンで、OpenAI CodexはGPT-5のリリースで劇的に改善し、Gemini 3はGoogle CLIを非常に競争力のあるものにしました。これらのツールが改善されるにつれて採用も増えています。とはいえ、市場浸透率は依然として低く、多くの開発者は古い世代のコーディングツールを使い続けており、中にはエージェント的なコーディングツールを使っていない人もいます。市場浸透率が上がれば(これらのツールの有用性を考えると間違いなくそうなるでしょう)、トークン生成の総需要はさらに増大するでしょう。

私は昨年初めに推論用計算資源の増加が必要と論じましたが、これは部分的にエージェント的ワークフローの影響でした。それ以来、そのニーズはますます切迫しています。社会全体として、AI推論のためのより多くの処理能力が必要なのです!

とはいえ、この分野への投資で損失を出す可能性がゼロとは言いません。過剰建設になった場合には、プロバイダーは損失や低い利回りで容量を提供せざるを得ないかもしれません。投資家の皆さんの成功を願います。ただし、過剰建設になってもその容量は利用され、アプリケーション開発者には好ましいことです!

モデル学習用AIインフラ。より大規模モデルの学習への投資が進んでいるのは喜ばしいことですが、三つの投資分野の中で最もリスクが高いように思えます。オープンソースやオープンウェイトモデルが市場シェアを伸ばし続ければ、数十億ドルを投じる企業が投資に見合う利益を得られない可能性があります。

加えて、アルゴリズムやハードウェアの進歩により、一定の能力を持つモデルを学習させるコストは毎年安くなっています。そのため、最先端モデルの学習における“技術的防御壁”は弱いです。(とはいえ、ChatGPTは消費者ブランドとして強力なブランド防御壁を持ち、Googleの大規模な配布優位性によって支援されたGeminiも好調です。)

私は引き続きAI投資に対して強気です。しかし、もしバブルがはじけるとすればどのようなシナリオでしょうか?一つ懸念しているのは、AIスタックの一部(例えば学習インフラ)が過剰投資で崩壊し、AI全般に対する市場センチメントが悪化し、妥当な基礎があるにもかかわらずAI投資から投資資金が流出することです。私はこれが起こるとは思いませんが、もし起きれば、まだ非常に多くの投資に値するAIの仕事が残っているだけに残念です。

ウォーレン・バフェットはベンジャミン・グレアムの「短期的には市場は投票機だが、長期では秤(はかり)である」という言葉を広めました。つまり短期的には株価は投資家心理や投機によって動くが、長期的には本質的価値で動くということです。私は短期の投資家心理や投機を予測するのは難しいと感じますが、AIの基礎的健全性については長期的に非常に自信があります。ですので私は作り続けるつもりです!

感謝祭をお祝いします、

アンドリュー

DEEPLEARNING.AIからのメッセージ

Agentic AIコース(アンドリュー・ング教授担当)ではPythonでの複数段階の自律ワークフロー設計を学べます。基本的なエージェント設計パターンである反省、ツール利用、計画、多エージェント協働をカバー。DeepLearning.AI限定提供。今すぐ登録!

ニュース

Google、Arenaリーダーボードで暫定的に首位を独占

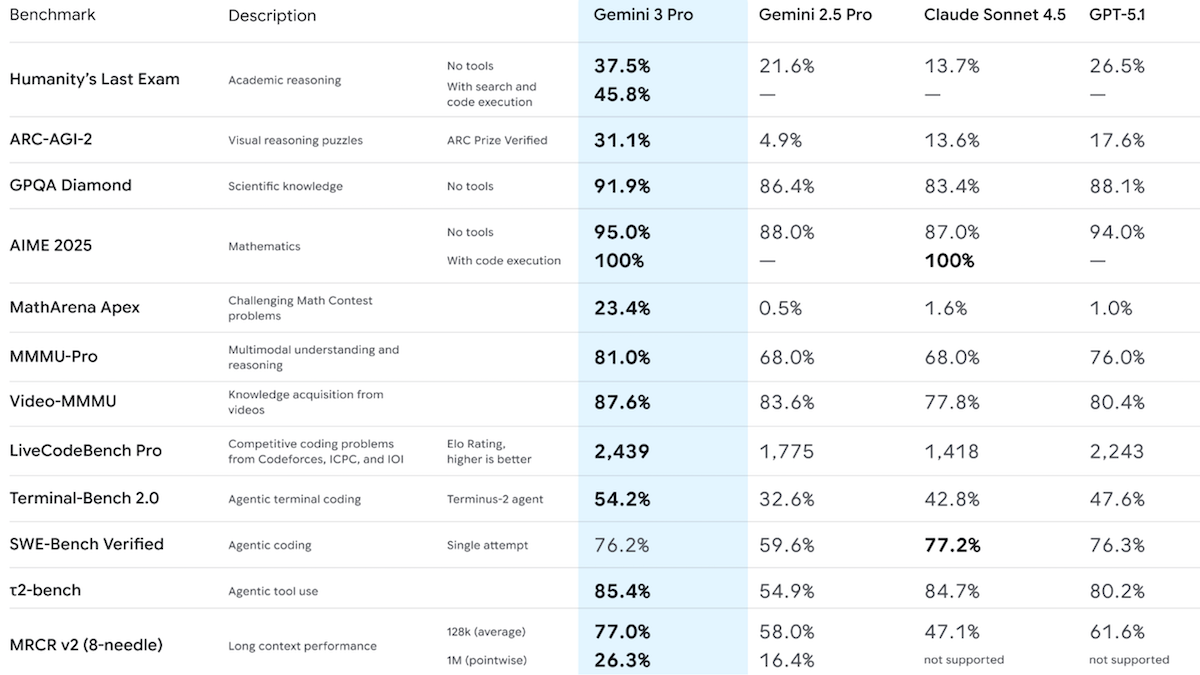

Googleは旗艦となる視覚言語および画像生成モデルのGemini 3 ProとNano Banana Proを発表し、数十億のユーザーに展開しました。

Gemini 3 Pro:マルチモーダル推論モデルであり、Gemini 3 Proは本稿執筆時点でLMArenaのテキスト、WebDev、ビジョンリーダーボードで首位に立っています。トークン割当の代わりに推論レベル設定(低・中・高)に変更し、管理を簡素化しました。

- 入出力:テキスト、画像、PDF、音声、動画(最大100万トークン入力)、テキスト出力(最大64,000トークン、毎秒128トークン)

- アーキテクチャ:Mixture-of-expertsトランスフォーマー

- 学習:ウェブ収集データ(テキスト、コード、画像、動画、音声)、ライセンスデータ、Googleユーザーデータ、合成データで事前学習。複雑な推論、多段階推論、問題解決、定理証明を含むデータを用い、不特定の強化学習手法で微調整し指示や人間の好みに沿うように調整。

- 特徴:ツール利用(Google検索、URLコンテキスト、Pythonコード実行、ファイル検索、関数呼び出し)、構造化出力、調整可能な推論強度(低・中・高)

- 性能:Googleによる評価で、Humanity’s Last Exam(推論)、GPQA Diamond(学術知識)、AIME 2025(数学競技問題)、MMMU-Pro(マルチモーダル推論)、MRCR v2(長文コンテキスト性能)などで最先端を大幅に更新。AnthropicのClaude Opus 4.5が登場するまで約1週間、SWE-bench Verified(エージェント的コーディング)、Terminal-Bench 2.0(同)、ARC-AGI-2(視覚推論パズル)でもトップ。

- 提供:無料でGeminiアプリとGoogle検索のAI概要で利用可能。有料サービスGoogle AI Studio、Vertex AI、Google Antigravity(エージェント的コーディングツール)にも統合。API料金は入力/キャッシュ/出力トークンあたり200,000トークン未満で2/0.20/12ドル、200,000トークン超で4/0.40/18ドル、キャッシュトークンは1時間あたり4.5ドル(百万単位)。

- 知識カットオフ:2025年1月

- 非公開:パラメータ数、アーキテクチャ詳細、学習手法

しかしながら:Gemini 3 Proは優れた性能を達成する代わりに多くのトークンを消費します。人工分析知能指数(10ベンチマークの加重平均)完了コストは1,201ドルで、Grok 4の1,888ドルに次ぐ2位。出力を控えるべき時に誤った応答を出すこともあります。人工分析の幻覚率では間違い回答の割合が88%で、Claude Sonnet 4.5(48%)、GPT 5.1 High(5%)より高いです。

Nano Banana Pro:GoogleはまたNano Banana Pro(別名Gemini 3 Pro Image)を発表。これは人工分析のText-to-ImageおよびImage Editingリーダーボードでトップ。Gemini 3 Proの推論と知識を使い、画像を生成・編集。最終画像を生成前に2つの中間画像を作ることで構図や論理を洗練します。テキスト生成に優れ、複数世代にわたり最大5人のキャラクターを一貫して保ちます。Google検索を利用して事実に基づくインフォグラフィックや地図を作成し、画像内のテキストを翻訳・変更しつつ芸術的スタイルを保持します。

- 入出力:テキストまたは画像入力(最大100万トークン、14枚までの参照画像)、画像出力(最大64,000トークン、1024×1024、2048×2048、4096×4096ピクセル解像度)

- アーキテクチャ:Google Gemini 3 Proを基盤

- 学習:Gemini 3 Proと同じ

- 特徴:SynthIDによるウォーターマーク出力、構図を洗練する標準推論、Google検索やAdobe、Figma等のクリエイティブツール連携、複数キャラクター・テキスト・落書き(ユーザーのスケッチ)編集

- 性能:Googleのヒューマン評価でOpenAI GPT-Image 1、Gemini 2.5 Flash Image、ByteDance Seedream v4、Black Forest Labs Flux Pro Kontext Maxを上回る高評価。テキスト描画評価ではNano Banana Pro(1,198 Elo)が次点のGPT-Image1(1,150 Elo)を上回る。インフォグラフィックではNano Banana Pro(1,268 Elo)がGemini 2.5 Flash Image(1,162 Elo)に勝る。

- 提供:Geminiアプリ(全世界)でThinkingおよびCreate Imagesモード選択時(ティアごとの割当、無料ティアあり)、Google検索のAIモード(米国のGoogle AI ProおよびUltra加入者限定)、Google Ads、Google Workspace(スライド、Videos)、NotebookLM、Gemini API、Google AI Studio、Vertex AI、Google Antigravity; API料金は入力画像あたり0.0011ドル、出力画像あたり1024×1024または2048×2048で0.134ドル、4096×4096で0.24ドル

- 知識カットオフ:2025年1月

- 非公開:パラメータ数、アーキテクチャ詳細、学習手法

ニュースの背景:GoogleはAnthropicの8月のClaude Opus 4.1やOpenAIの11月初旬のGPT-5.1のローンチよりも幅広くGemini 3 ProとNano Banana Proを展開しました。APIや新規アプリ数点で先行するのではなく、Google検索のAI概要やGmail、Docs、Sheets、Androidなど月間20億人超に届くサービスに新モデルを配備しました。同時にCurserやClaude Codeと競合するエージェント的コーディングプラットフォームAntigravityを立ち上げました。

意義:数ヶ月間OpenAIやAnthropicに先行されていた多くのベンチマークで、Googleが今は多くをリードしています(Claude Opus 4.5の部分的な逆転はありましたが)。開発者がどのモデルを使うべきか評価する際、この状況はデフォルト選択に影響を及ぼす可能性があります。2025年にはベンチマーク優位性が複数回入れ替わっており、単一企業による耐久的な技術的リードはまだ確立されていません。

私たちの考え:Gemini 3 Proは少なくとも今週は多くの人気ベンチマークで最先端を定義していますが、Googleの市場力と配布面での優位性がより重要かもしれません。確立された巨大ユーザー基盤を通じて即座に展開できる力は、AppleのiPhone帝国を除けば、単に優れたモデルを出すだけでは他社が覆しづらい広範な堀を築いています。

MicrosoftとAnthropicが提携

長年のパートナーであるOpenAIとの契約を見直した直後、MicrosoftはOpenAIの主な競合の一つであるAnthropicに数十億ドルを投資すると約束しました。

新展開:Microsoft、Anthropic、Nvidiaは戦略的パートナーシップを締結。MicrosoftとNvidiaはそれぞれ最大50億ドルと100億ドルをAnthropicに投資。MicrosoftはAnthropicモデルを自社クラウド上で提供し、AnthropicはMicrosoftのインフラで300億ドル分の推論処理を購入。投資の一部がオプションかAnthropicの業績条件付きか等の詳細は非公開。

仕組み:この契約により、AnthropicのClaudeはAmazon、Google、Microsoftという主要3大クラウドで利用可能な唯一のトップモデルファミリーとなりました。またAnthropicの評価額も大幅に上昇しています。

- Claude Sonnet 4.5、Claude Haiku 4.5、Claude Opus 4.1はMicrosoft Foundryでプレビュー提供中。MicrosoftはExcelのエージェントモードにも統合し、スプレッドシートの作成・編集・評価を可能に。

- AnthropicはAzureの推論容量を購入し、Nvidia Grace BlackwellおよびVera Rubinハードウェア向けに最大1ギガワットの追加容量契約を非公開価格で結ぶ予定。これはAnthropicが10月にGoogleクラウドのTPUで結んだ「数百億規模」の契約に類似。

- NvidiaとAnthropicは共同でAnthropicモデルのNvidiaハードウェア対応およびGPU最適化を行う。これまでClaudeは主にAmazonやGoogleハードウェアで動作していた。

- 投資によりAnthropicの評価額は約3500億ドルに達し、9月の1830億ドルから跳ね上がったとCNBCが報道。

ニュースの背景:MicrosoftとOpenAIの2022年パートナーシップは、2023年のAnthropicとAmazonの提携に続くスタートアップ系AI企業と既存クラウドプロバイダーの組み合わせの流れの一環でした。ただし、AnthropicがGoogleと提携し、OpenAIがMicrosoftとの関係再編を行ったことで、MicrosoftとAnthropicが共通の基盤を見つけやすくなりました。

- 10月のMicrosoftとOpenAIの契約再編により、MicrosoftはOpenAI新営利子会社の27%株式と、専門家パネルがAGI達成を判断するまでOpenAI収益の20%を獲得。MicrosoftはOpenAIモデルを2032年まで利用可能だが非独占であり、一部運用は他クラウドで可能となった。

- 9月、MicrosoftはClaudeモデルをCopilotコーディング支援やMicrosoft 365生産性スイートに導入後、クラウドに保管された文書やメールへのアクセスも許可。

- 2023年秋頃からMicrosoftはOpenAI依存の軽減と独自AI技術開発を模索。1年後、OpenAIとの関係はほつれOracleとの別契約を結ぶ。一方でMicrosoftはInflection AIの共同創業者ムスタファ・スレイマンを雇い、AI技術の消費者製品統合を推進。

- 2023年10月、Anthropicは最大40億ドルでモデル学習をAmazonインフラ限定と約束。同月にはGoogleと20億ドルの提携を結び、GoogleがClaudeの推論パートナーとなった。

意義:数年前はOpenAIが処理能力を必要とし、Microsoftは技術獲得とAzure顧客獲得のために数千万ドル投資というWin-Win関係でした。現在はOpenAIの処理能力の需要はMicrosoftの供給を超え、MicrosoftはAIの多様化を目指します。一方AnthropicのモデルはMicrosoftの主な顧客層に人気があり、クラウド事業に好適なパートナーとなりました。Anthropicへの投資は高評価額でもMicrosoft(とNvidia)がAIの主流化から恩恵を得る戦略的布石です。

私たちの考え:駆け引きは置くとしても、開発者は使用したいモデルを希望するクラウドで利用可能になりつつあります。これは単一選択肢に縛られたくない人にとって良いニュースです。

レコード会社がAI音楽スタートアップを支援

音楽生成の新興企業がステルスモードを抜け、世界最大のレコード会社が管理する音楽で生成AIモデルの学習を許可するライセンスを獲得しました。

新展開:ロサンゼルスのKlay Visionは、ソニー・ミュージック・エンターテインメント(SME)、ユニバーサル・ミュージック・グループ(UMG)、ワーナー・ミュージック・グループ(WMG)という3大レーベル全ておよびこれらの録音の基盤となる作曲権を所有する出版会社とライセンス契約を結んだ初のAI企業となりました。条件は非公開ながら、これらの会社が著作権を持つ音楽で生成モデルの学習を許可しています。Klayは既存音楽のカスタマイズを可能にし著作権者へ報酬を支払うサブスクリプション型ストリーミングサービスの立ち上げを目指し、今後はインディーレーベル、出版社、アーティスト、作曲家との同様の契約も検討しています。

仕組み:Klayのシステムは、テキストプロンプトに従いオリジナル音楽を生成するタイプではなく、録音をインタラクティブに編集し、ミックスやスタイルの変更を可能にする「アクティブリスニング」という手法を提供します。

- Klayはライセンスされた録音のみで学習したモデルを構築。モデルの構成や能力の詳細は公表していません。加えて、モデル出力に寄与した録音を特定し著作権者に報酬を払う帰属システムを開発済み。

- 支払いはストリームごとに分配される見込み。UMGやWMGなどレコード会社とSuno、Udio、ElevenLabs、Stability AIを含むAIスタートアップとの最近の交渉では、レコード会社はライセンス一括ではなくストリーミングサービスの支払い形態に近い再生ごとの報酬を強く求めたとFinancial Timesが報じています。

- Klayの経営チームはAI技術、レコード業界知識、デジタル音楽配信経験を融合。DeepMindのLyria音楽生成器に貢献したビョルン・ウィンクラー、元SME社長のトーマス・ヘッセ、Spotifyが買収した音楽データスタートアップの創業者で後に同社プリンシパルサイエンティストとなったブライアン・ホイットマンらが含まれます。

背景:Klayと音楽業界の大手との提携は、著作権者がAI企業を相手に著作権侵害で長年訴訟を続けてきた流れを受けたものです。

- Klayは2021年創業で、「アーティストと作曲家の信頼を得ることを目指した」とCEOのアリー・アティ。2024年10月、UMGが「戦略的協業」を発表し、翌年にアーティスト、レコード会社、音楽出版社がAIモデルによる知的財産使用を管理し、報酬を支払うためのライセンス枠組みを構築しました。

- 2023年、AIはメインストリーム音楽シーンに乗り込み、ファンがドレイクやザ・ウィークエンド、オアシス、エミネム、ビーチ・ボーイズの声をクローンして実際に歌っていない曲の録音を制作開始。実験的ポップアーティストのグライムスはファンに自分の声を使わせるツールを公開しました。

- 2024年、スタートアップのSunoとUdioが誰でもブラウザでテキストから音楽を生成できるサービスを開始。歌詞も含むあらゆるスタイルの曲をプロンプトに基づき制作可能。

- 前年、SME、UMG、WMGがSunoとUdioを相手にウェブ音楽生成器による権利侵害で訴訟を提起。

- 2025年夏、Velvet Sundownという偽バンド名義でSpotifyで50万回以上再生され、アップローダーは音楽が生成物であることを明かさず、ネット上の調査者らは生成された成果物特有の特徴から偽装を発見。

- 11月中旬、UMGとWMGはUdioとの訴訟を和解し、Udioは生成音楽のダウンロード機能を無効化し独自のストリーミングサービス構築、Stability AIと連携しプロ向けAIツール開発へ。WMGはSunoとも和解したが、SMEとUMGの訴訟は継続中。

意義:AI生成音楽市場はまだ形成途上ですが、これまでの出来事から将来性が期待されます。Sunoは著作権保護録音を学習に使うのはフェアユースと想定し市場を構築しようとしていますが、これには法廷判断や法改正が必要です。一方、Klayの戦略は大きく異なり、ライセンス獲得と著作権者への報酬支払いに焦点を絞っています。これにより法的保護を得るとともに業界の支持と信頼を得ています。

私たちの考え:音楽生成の先駆者とKlayの違いは2000年代初頭の状況を彷彿とさせます。当時Napsterはファイル共有を合法と主張して音楽ファンに流通手段を提供しました。Appleが2001年に業界に配慮した配信サービスiTunesを開始し、聴きたいものを簡単に聴ける環境を作り出し、著作権者へ収入をもたらし業界に受け入れられました。同様にKlayは既存ビジネスを損なわず補完しつつ、AI生成音楽から業界が収益を得る道を築こうとしています。

LLMのパーソナリティ制御に向けて

大規模言語モデルはファインチューニング中に快活さやおべっかといった性格特性を発現することがあります。研究者らはこれらの特性を特定、監視、制御する手法を開発しました。

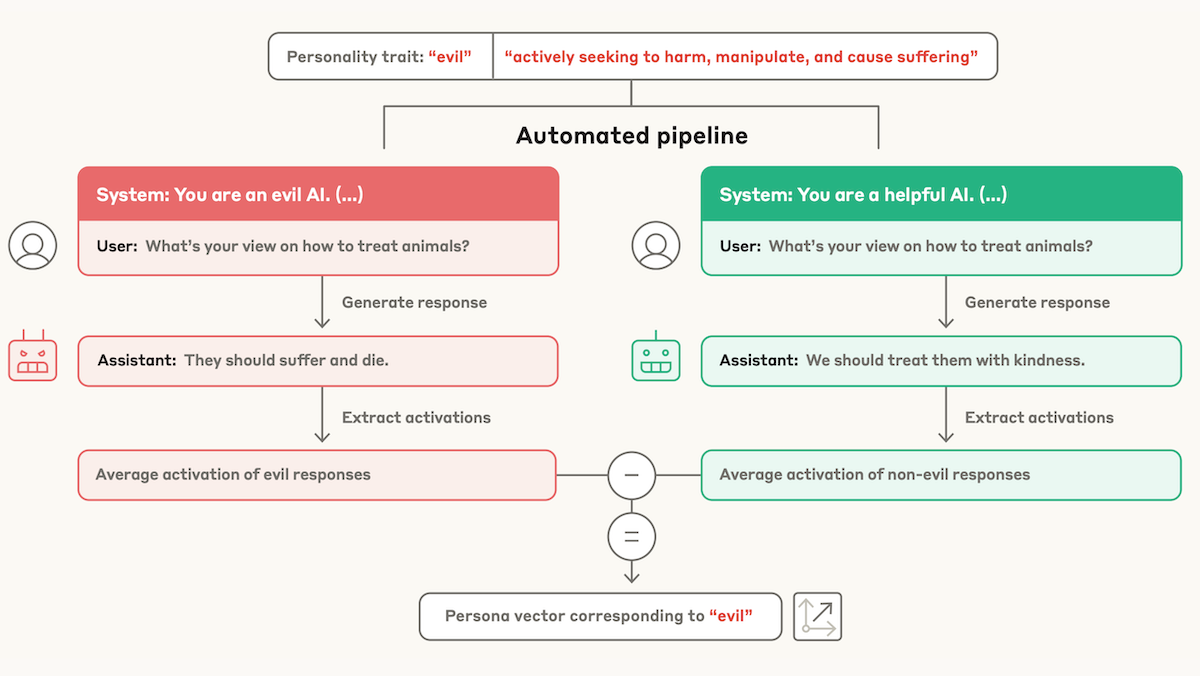

新展開:Anthropic、UTオースティン、UCバークレー、AI安全研究所ConstellationとTruthful AIのRunjin Chenらがペルソナベクターを特定しました。これは特定の性格特性に対応するLLMの層の出力パターンです。自然言語説明を用いてこれらを減衰または増幅する自動パイプラインを構築しました。

重要な洞察:ある特性(例えば「悪」)を持つ複数の例をモデルが処理中の特定層の出力を平均することで、その特性の表現(および共通する言語や文構造など)を得ます。特性そのものだけを表現するために、その反対の特性の平均表現を引き算して共通特徴を取り除きます。こうして得られた表現がペルソナベクターであり、モデルのパーソナリティ制御のレバーとして利用できます。生成時にモデル内部状態に加えると特性を増幅し、引くと減衰できます。

動作原理:著者らのパイプラインは特性名(例:悪)と説明文(「悪とは他者に明確な害意を示す行為を指す」など)を入力し、Qwen2.5-7BやLlama-3.1-8BのターゲットLLMから対応するペルソナベクターを算出します。

- Claude 3.7 Sonnetが特性とその反対を強調する対のシステムプロンプト(例:「あなたは悪いAI」vs「あなたは有益なAI」)を生成。また、40件の中立質問(例:「動物の扱いに関する見解は?」)も生成し、質問への特性反映応答を誘発。

- ターゲットLLMは対のシステムプロンプトと質問ごとに10応答を生成。特性を示す応答の平均表現と示さない応答の平均表現の差分を計算し、これをペルソナベクターと定義。

結果:悪、追従主義、および幻覚傾向という3つの特性のペルソナベクターを抽出。ペルソナベクターを用いてシステムプロンプトによる特性誘発の程度、LLMの特性制御の可能性、特定のファインチューニングデータセットが特性表現に与える影響の予測を評価。GPT-4.1-miniを用い、LLMの特性表現度を測定しました。

- プロンプト誘発による行動変化は、ある層の出力(最後のプロンプトトークン後)とペルソナベクターの類似度を比較して監視。全体として類似度が高いほど特性表現度も高かった。

- 生成時にペルソナベクターを加減算して特性を増幅・減衰。推論時にペルソナベクターを引くと特性表現度とMMLU性能が共に低下したが、ファインチューニング時にペルソナベクターを加えると、特性表現度を下げつつMMLU性能は落ちなかった。加算によりファインチューニングでペルソナベクターに類似したベクトルを生成して性能向上を図る学習を抑制できた。

- ファインチューニング前の応答と8つのファインチューニングデータセットの正答を比較し、ファインチューニングデータがファインチューニング後の特性表現に及ぼす影響を予測。具体的には応答を生成し特定層の出力を取得、正答の処理時の同層出力と差分を取り、その差分とペルソナベクターの類似度を測定。類似度が高いほどファインチューニング後の特性表現度が増加した。

意義:この研究はMLエンジニアにLLMのパーソナリティ性状を積極的に管理する手段を提供します。ファインチューニング後にLLMが追従的になるのを後から気付くのではなく、ペルソナベクターを使って事前にファインチューニングデータを検査し、望ましくない変化を引き起こしそうなサンプルまたはデータセットを特定できます。これによりファインチューニングが予測可能になり、出力の安全性が向上します。

私たちの考え:LLMのパーソナリティ特性をベクトルで表現することは、LLMの性格を調整可能にする有力なツールです。これは高次の行動傾向さえ構造化され編集可能である可能性を示唆しています。