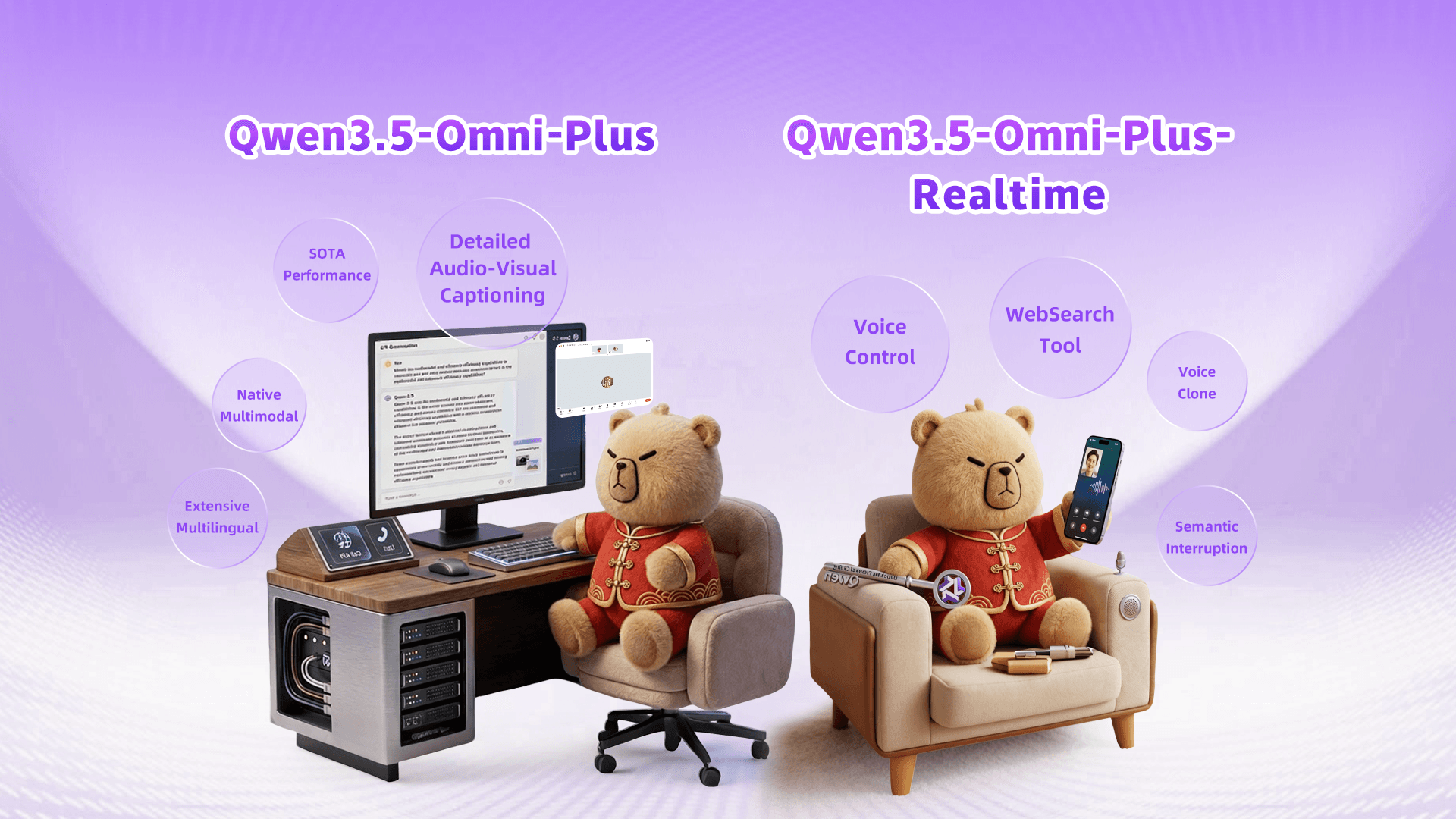

Alibabaは、テキスト、画像、音声、動画を処理するマルチモーダルAIモデル「Qwen3.5-Omni」をリリースしました。音声タスクにおいてGemini 3.1 Proを上回ると主張しており、その過程で思いがけない「技」も見つかりました。音声による指示と動画入力から、コードを書き起こせるのです。しかも、誰もそれに学習させてはいません。

この記事 Qwen3.5-Omniは、誰も学習させることなく音声による指示と動画からコードを書くことを学んだ は、The Decoder に最初に掲載されました。