ゼロショットからフルリソースへ:アスペクトベース感情分析のためのクロスリンガル転移戦略

arXiv cs.CL / 2026/4/30

📰 ニュースModels & Research

要点

- この論文は、複数言語(7か国語)と4つのサブタスクにわたってアスペクトベース感情分析(ABSA)を評価し、近年のトランスフォーマー進歩があるにもかかわらず非英語領域が相対的に少ない課題に取り組みます。

- 3つのデータ条件(ゼロリソース/データのみ/フルリソース)において、クロスリンガル転移・コードスイッチング・機械翻訳を用いながら、さまざまなトランスフォーマー方式を比較します。

- 微調整したLLMが全体として最も高いスコアを達成し、とりわけ生成型のより複雑なABSAタスクで優位性が大きいことが示されます。

- 微調整LLMには複数の非対象言語でのクロスリンガル学習が最も有効である一方、小規模なエンコーダやseq-to-seqモデルではコードスイッチングが特に効果的だと報告しています。

- 著者らは、ドイツ語の新データセットとして改訂版GERestと、初のドイツ語ASQPデータセットGERestを提供し、英語以外での多言語ABSA研究を促進します。

関連記事

OpenVidyaのフィードバック募集:NCERT/CBSE向けのオープンソースAI教室レイヤー [R]

Reddit r/MachineLearning

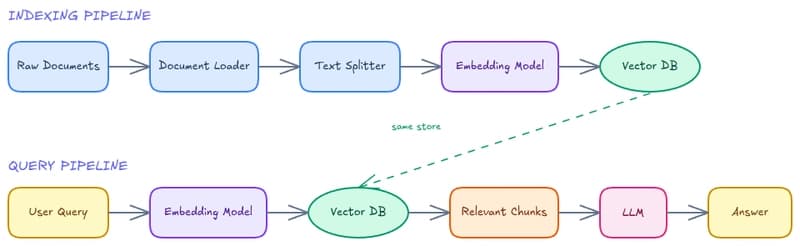

RAGシリーズ(1):なぜLLMには外部メモリが必要なのか

Dev.to

「Open Source Project a Day」第54回:Warp - AIネイティブなRustターミナル

Dev.to

「One Open Source Project a Day (No.53)」pi-mono:ミニマル&高性能なAIコーディングエージェント

Dev.to

おすすめのオープンソース字幕生成は?Canary Qwen 2.5B+Whisper 完全ガイド

Dev.to