Pangu-ACE:EduBench向け教育応答生成のための適応的カスケード型エキスパート

arXiv cs.CL / 2026/4/17

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

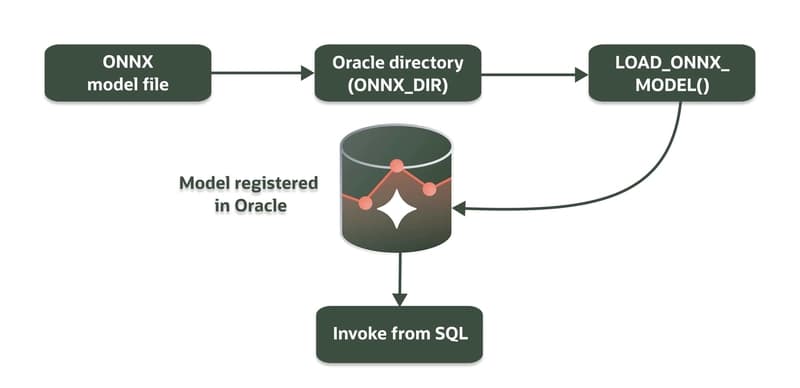

- Pangu-ACEは、必要なときだけ計算資源を増やす教育応答生成システムで、1Bの「tutor-router」から7Bの専門家プロンプトへサンプル単位でカスケードします。

- 手順では1Bモデルが下書き回答とルーティング用の信号を生成し、タスク依存の判断に基づいて、下書きを採用するか各サンプルを7Bの専門家へエスカレーションします。

- 論文は、以前のオフライン評価で「形式チェックを通過しただけ」の開形式出力を過大に評価してしまう重大なバグを修正し、EduBenchの中国語テストアーカイブ(7013サンプル)で改善を報告しています。

- 従来のrule_v2方式に比べ、決定論的品質は0.457から0.538へ、形式妥当性は0.707から0.866へ向上し、19.7%のリクエストは1Bのみで直接処理できました。

- アーカイブされたデプロイではレイテンシの改善はまだ示されていませんが、効率性の主張は壁時計時間の高速化ではなく、ルーティングの選択性によって裏付けられており、GPT-5.4のベースライン再判定はプロバイダ設定の不備によりインフラ修復待ちです。