モデル劣化と検閲について、なかなか興味深い話です。

AIの用途の一つとして、見えているままの中国の小説を章ごとに翻訳し、読み取らせることがあります。

いくつかの登場人物が秘密の正体というプロット上の要素を持っていて、さらにAIが翻訳のためだけでなく整合性のためにも文脈の手がかりに従う必要があったので、AIにそれを探すよう促し、翻訳の際には正しい名前を選びました。

最初に始めたとき、利用可能な主なモデルはGPT OOS 120B(遅い)、Qwen 3 max、無料のChat GPT 4oでした。

最初はGPT OSS 120Bを試しましたが、失敗しました。名前を混ぜたり、時には一貫して新しい名前を作ったりしました。

次に、それにQwen 3 Maxを使いました。良くはなりましたが、依然として失敗率が20%あります。さらに(NSFWではないにもかかわらず)一貫して検閲フィルタに引っかかり始めました。

次に当時の無料版のChat GPT(4o)を試したのですが、ダントツで最良でした。名前は常に正しく、翻訳そのものの品質も非常に高い出来でした。

それからしばらく後、5.2のアップデートで、問い合わせの20%で失敗し始めました。するとA-Bテストが行われていて、あるバージョンが翻訳に対して一貫して失敗し、間違った名前を選んでいるのが見えました。

そして今、GPT 5.3ではA-Bテストは終わったようで、より悪いバージョンがユーザー向けに展開されてしまい、旧来のQwen 3 Maxと同等くらいのレベルになっています。

これで、翻訳用の最新ローカルモデルを改めて再テストしてみたくなりました。すると驚いたことに、Gemma 4 31Bがクローズドモデルを一掃するほどの結果になりました。品質は、ピーク時のGPT 4oと非常に似ています。

そこで、同じプロンプトと章をいくつかのオープン/クローズド両方のモデルで再テストしてみたくなりました。結果は私たちにとって良好です:

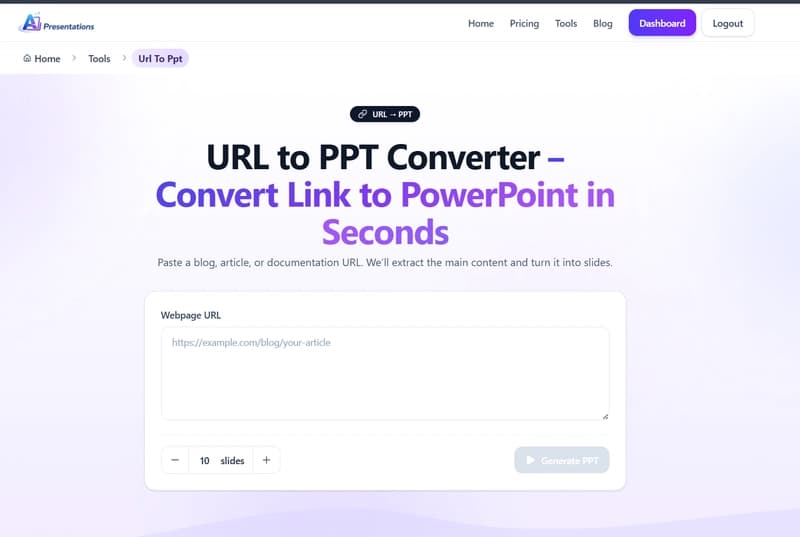

| Model | PASS/FAIL | INFO |

|---|---|---|

| GPT OOS 120B | FAIL | 登場人物の名前をマージする |

| Qwen 3 Max | FAIL (CENSORED) | 書き方はOKだが、モデルが検閲されて自動削除された |

| Qwen 3.6 Plus | FAIL (CENSORED) | 書き方は良いが、モデルが検閲されて自動削除された |

| Chat GPT 5.3 | FAIL | 正しい登場人物の名前を台無しにする。翻訳が不自然に感じられる |

| Gemma 4 31B | PASS | 良い翻訳で自然、しかも速い |

| Qwen 3.5 27B | PARTIAL PASS | Gemma 4と似ているが、少し不自然な感じで、登場人物の代名詞をめちゃくちゃにする(レディをロードと呼ぶ) |

| Gemini Chat | PARTIAL PASS | 意外なことにGemma 4より悪い。少し不自然な感じで、登場人物の代名詞をめちゃくちゃにする(レディをロードと呼ぶ) |

なんということだ、私はこの投稿を書き始めた“後”でテストをしました。いったいどうやって、Q4のGemma 4がGeminiとGPT 5.3の両方に勝つんでしょう? ジェミニは本当にGemmaより悪いのか、何なんだよ?!

[link] [comments]