OllamaでローカルLLM:導入から最新エコシステムまでを解説

Zenn / 2026/3/29

💬 オピニオンDeveloper Stack & InfrastructureTools & Practical Usage

要点

- Ollamaを使ったローカルLLM導入の全体像から、設定・運用の考え方までを体系的に解説しています。

- ローカルでモデルを動かすための周辺エコシステム(ツールや連携の仕組み)を「最新」視点で整理しています。

- 実際に使い始めるための導入フローに焦点があり、手を動かす前提で理解を進められる構成です。

- ローカルLLM活用における開発者/ユーザー双方の実装上のポイントを、段階的にまとめています。

はじめに

最近、LLM(大規模言語モデル)の話題が絶えませんが、「機密情報をクラウドに送りたくない」「APIの従量課金が気になる」といった悩みはありませんか?

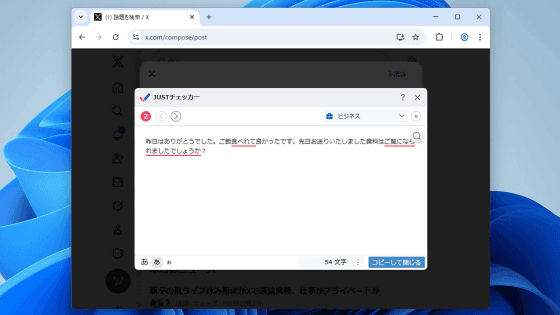

そんな課題を解決手段になりうるのが、ローカル環境でLLMを実行・管理できるオープンソースプラットフォーム Ollama です。2023年の登場以来、その手軽さと強力なエコシステムにより、いまやエンジニアにとって「ローカルLLMの標準」と言える存在になっています。

実業務で使う水準の動作環境という観点んではクラウド利用が堅実な選択肢となりますが、特定のユースケースに限れば使い所があると感じられるエコシステムです。

本記事では、2...

この記事の続きは原文サイトでお読みいただけます。

原文を読む →