米Google(グーグル)が米Meta(メタ)と組んで進めている「TorchTPU」構想が注目を集めている。中長期的に、米NVIDIA(エヌビディア)の独壇場を崩す可能性がある。

TorchTPUは、機械学習フレームワーク「PyTorch」をグーグルのAI(人工知能)チップ「TPU(Tensor Processing Unit)」上で互換性高く動かせるようにするものだ。2026年4月22日(米国時間)にGoogle Cloudの年次イベント「Google Cloud Next」で、一部顧客向けにプレビュー提供を開始したことを明らかにした。グーグルは2026年中にTorchTPUのGitHubリポジトリーを公開する方針を打ち出している。

PyTorchはメタ(発表当時はFacebook)が開発した、最も人気のあるフレームワークの1つである。当初は命令を即時実行し、容易にデバッグできる「Eager Mode」が自然言語処理の研究者による支持を集めた。その後はライブラリーの充実と共に、幅広い層に支持が広がった。

PythonとPyTorch、さらにエヌビディアのGPU(画像処理半導体)とソフトウエア開発基盤「CUDA」を加えた開発環境は研究者の間で高い人気を誇る。結果的に、AI研究開発環境の領域ではエヌビディア1強の状況が続いている。

PyTorchとの互換性の低さが課題

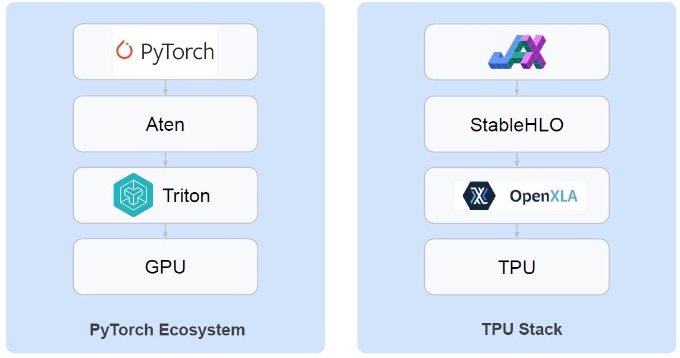

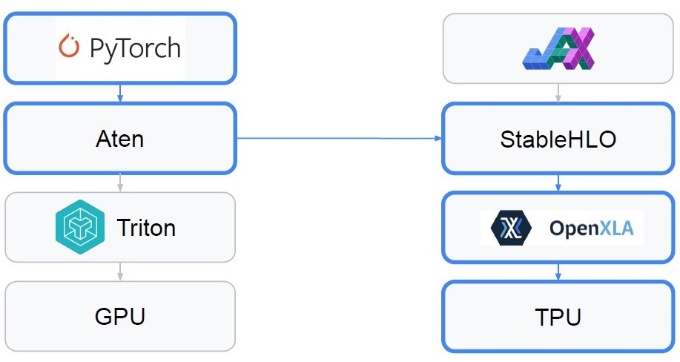

一方、グーグルが2016年に公式発表した、深層学習に特化したチップであるTPUは、PyTorchとの互換性の低さが課題の1つとされてきた。TPUはGPUとは設計が根本的に異なる。TPU上でコードを動かすためには「XLA(Accelerated Linear Algebra)」などのコンパイラーを使う必要がある。

PyTorchでXLAを使うには細かなコードの書き換えやバージョンの調整が必要となり、GPUからTPUに乗り換える上での課題となっていた。グーグルは処理の高速化や簡素化を目指し、2020年に「PyTorch/XLA」ライブラリーを一般提供するなど改善を続けていたが、サポートするカーネルやコードが限定的だった。

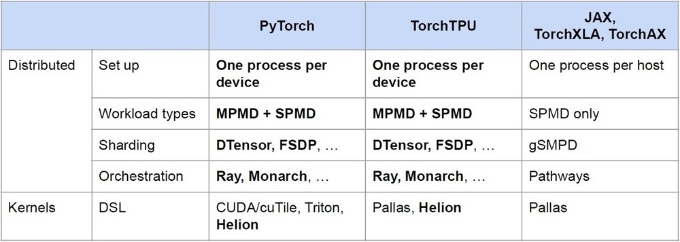

TorchTPUの登場で、こうした制約の多くが取り払われ、TPUの上でより円滑にPyTorchを動作できるとしている。例えばPyTorch/XLAでは、同一のプログラムが複数データを処理する「SPMD(Single Program, Multiple Data)」コードを前提としており、並列処理におけるログ記述との相性が悪かった。TorchTPUは複数のプログラムが複数データを処理する「MPMD(Multiple Program, Multiple Data)」にも対応している。他にも3つのEager Modeを備え、よりPyTorchの操作性に近づけた。

グーグルがTorchTPUに注力する背景には、チップ需要が学習から推論に傾いていることがあると見られる。エヌビディアは2026年3月16日(米国時間)に開催した開発者会議「GTC」で推論特化チップ「NVIDIA Groq 3 LPU」を発表した。グーグルもGoogle Cloud Nextで、第8世代TPUを推論用と学習用と2つのモデルに分けて発表した。TPUの使い勝手を高めて、推論チップの需要を取り込み、シェアを伸ばしたい考えが透ける。次のページ

「短期的には切り替えたいとは思わない」この記事は有料会員限定です