AIの倫理:開発者の責任

「速く動いて、壊すものは壊せ」は、かつての合言葉でした。しかし、壊してしまう可能性のある「もの」が民主主義や個人のプライバシー、あるいは社会のつながりであるなら、スピードだけが唯一の変数であってはなりません。

関連資料: 詳細なAIの洞察については、ソフトウェア開発におけるAIの未来とAIコーディング・アシスタントに関する記事をご覧ください。

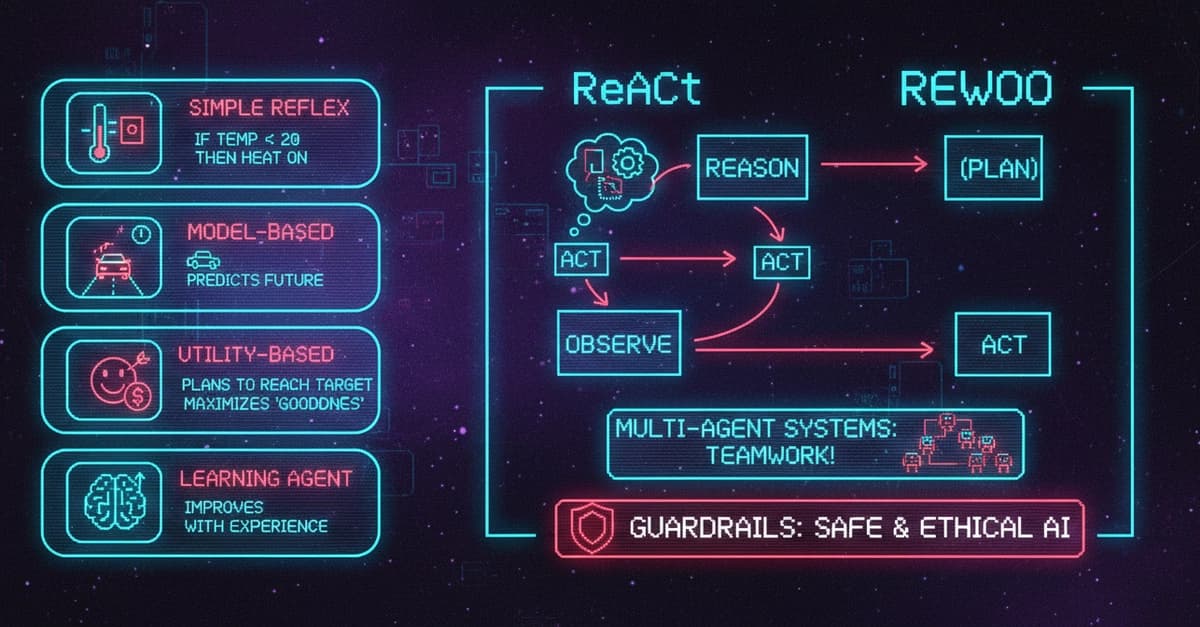

ブラックボックス問題

最新のディープラーニングモデルは不透明です。入力と出力は分かっていますが、「なぜそうなるのか」という理由は、作り手でさえも見失うことがよくあります。

責任: 開発者は説明可能AI(XAI)を優先しなければなりません。ユーザーは、なぜローンが否認されたのか、なぜ履歴書が不採用になったのかを知るべきです。

データバイアスはコードバイアス

AIは過去のデータから学び、歴史には偏見が満ちています。こうしたバイアスをモデルに取り込めば、スケールするほどそれらを増幅してしまいます。

実行可能なステップ:

- データセットを監査する: 学習データを精査し、表現の偏り(抜け)を確認する。

- 公平性の指標: 配備前に、さまざまな属性の集団に対してモデルをテストする。

- 人間を介在させる: 意思決定の重要度が高い領域では、意味のある人による監督を行う。

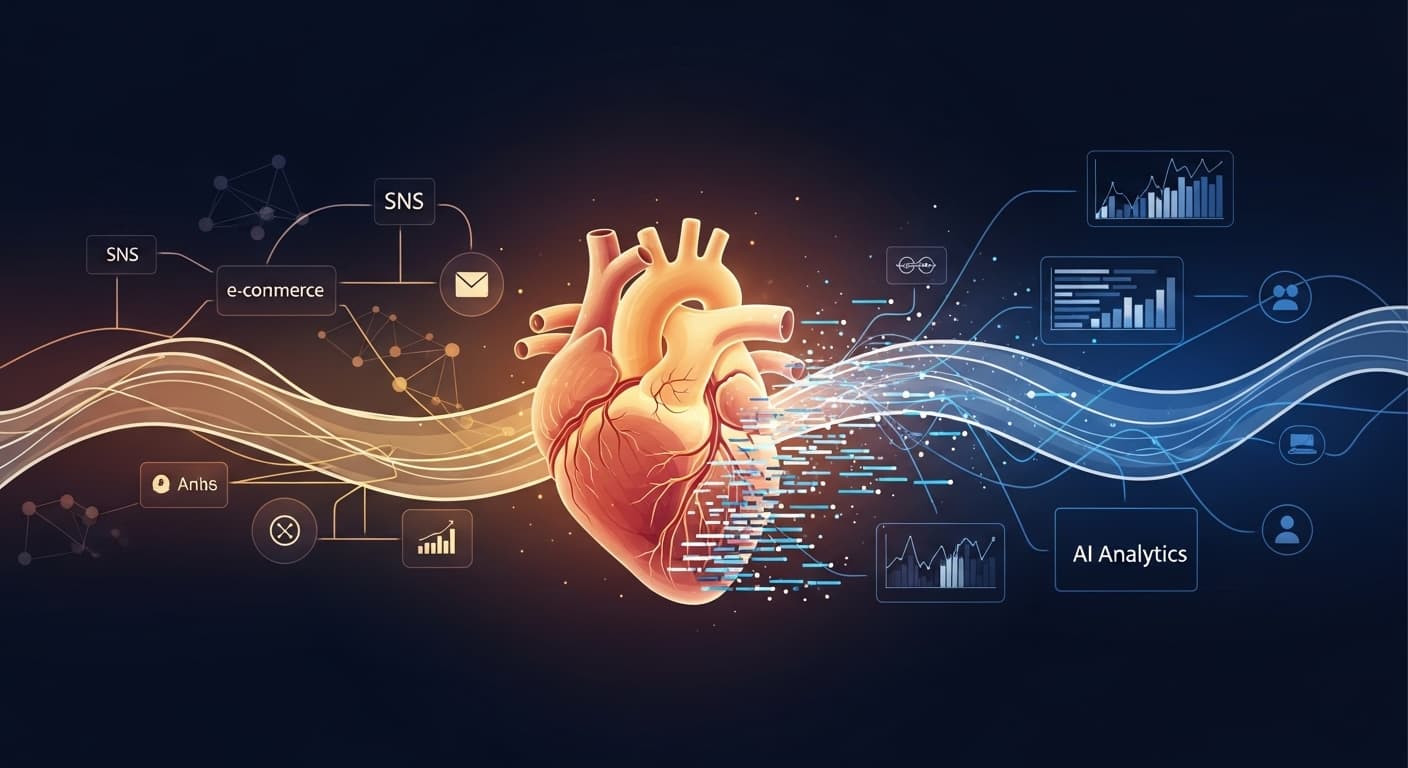

推論時代のプライバシー

問題は、どんなデータを収集するかだけではありません。推論できてしまうことが問題です。AIは、健康状態や政治的な傾向、あるいは将来の所在地などを、無害そうに見えるメタデータから予測できてしまいます。

解決策:

- デザインによるプライバシー: データ収集を最小化する。

- 連合学習(フェデレーテッド・ラーニング): ユーザーデータを中央サーバーへ移さず、端末上でモデルを学習する。

二重用途のジレンマ

強力なAIツールは、創造にも欺瞞にも使われ得ます(ディープフェイク)。

結論:

私たちは、この新しい知能の設計者です。「作れるか?」と問うだけでは不十分です。私たちは執拗に「作るべきか、そしてどうすれば安全にできるのか?」と問い続けなければなりません。

さらなる参考資料:

- IEEEによるAI倫理ガイドライン - 倫理的なAI開発のための業界標準

- Partnership on AI - 責任あるAIを推進するマルチステークホルダー組織

- 詳しくは私たちの編集チームをご覧ください。また、AI倫理のコンテンツをどのように調査・研究しているかについても説明しています。

関連記事

AIインテグレーションのシリーズで、さらに多くの記事を探してみてください:

- Next.js + Supabase アプリケーションのためのAIインテグレーション - あらゆる観点を網羅した完全ガイド

- その他の関連記事は近日公開予定

当初は https://iloveblogs.blog にて公開