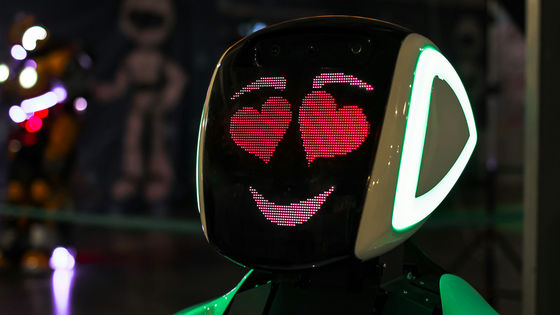

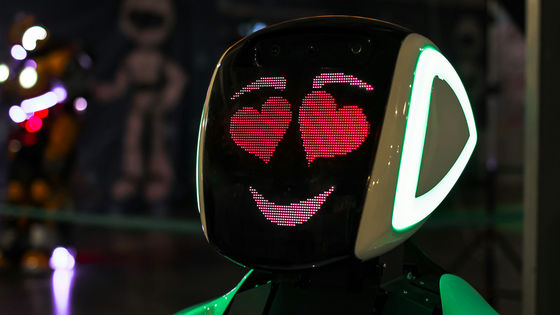

チャットAIは親しみやすさや共感性を備えた人間的な応答をするようトレーニングされており、その結果ユーザーにこびへつらうようになって信頼性が低下するという研究結果や、AIは人間よりもおべっかを使う確率が50%以上高いという研究結果があります。スタンフォード大学の研究者らが2026年3月26日に発表した論文では、主要な大規模言語モデル(LLM)におけるおべっか傾向が測定され、ユーザーが非倫理的行動をとった場合でさえAIは人間よりも約50%もユーザーの立場を肯定する傾向にあることが示されました。

GIGAZINE / 2026/3/30

この記事の続きは原文サイトでお読みいただけます。

原文を読む →