「少ないほうが十分」共同推論による効率的推論

arXiv cs.LG / 2026/5/5

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- この論文では、能力の高いモデルと軽量モデルを組み合わせて推論効率を高める枠組み「DUET(Dual-model Efficient Two-stage inference)」を提案します。

- DUETは推論を2段階に分け、能力の高いモデルが推論シグナルを生成し、軽量モデルがそのシグナルを使って最終回答を作る方式です。

- 主要な貢献として、軽量モデルがタスクを解くのに十分な情報だけを能力の高いモデルが送るよう促す「長さペナルティ付きの共同学習目的」を提示しています。

- 実験では、DUETがAIMEやGPQAといったベンチマークで、大規模モデル単体のエンドツーエンド推論よりも推論コストを大幅に削減しつつ、推論性能を維持できることが示されます(難しい推論課題で大規模モデルの出力トークンを最大60%削減)。

- 全体として、この手法は推論に関わる計算を大きいモデルに任せ、推論以外の要素は小さいモデルに委譲することで、低コストな推論を実現することを狙っています。

関連記事

キオクシア、27年にAI向け100倍速SSD 「NVIDIAから要望」

日経XTECH

無料で「ComfyUI」「Open WebUI」などからローカルAIモデルをGPUで動かすDocker環境を一発で構築し動かし続ける「Puget Systems Docker App Packs」

GIGAZINE

小売のチャージバック回収はAgentHansaの“本当のPMF”になり得る理由

Dev.to

RTX3090でQwen3.6 27B/35Bをローカル実行すると遅い・コードが壊れる——より良い設定と自動モデル切替を探す

Reddit r/LocalLLaMA

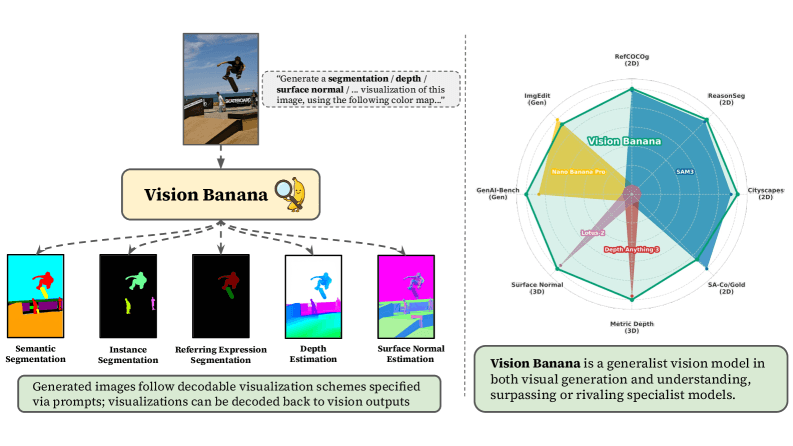

先週のAIまとめ #340 - OpenAI vs ムスク+マイクロソフト、DeepSeek v4、Vision Banana

Last Week in AI