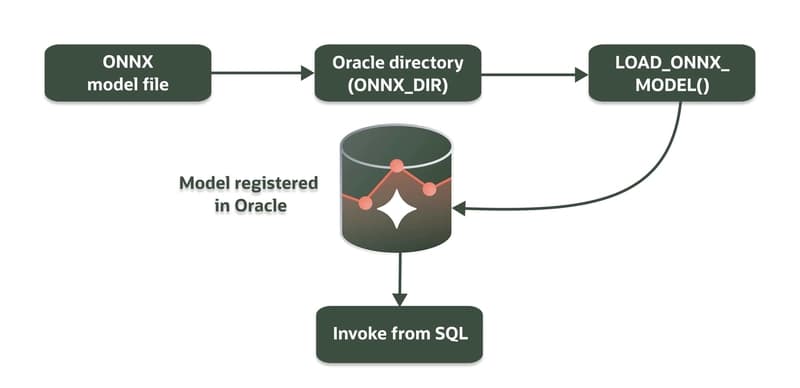

要旨: 一般化カテゴリ発見(GCD)は、部分的にラベル付けされたデータを用いて、既知クラスと新規クラスの両方を同定する方法に挑戦を突きつけ、人間のカテゴリ学習を模倣する。従来のGCD手法は単一モダリティ内で動作し、データセット固有の微調整を必要とするのに対し、我々は人間の脳による抽象的カテゴリ形成に着想を得た、モダリティ非依存のGCDアプローチを提案する。我々の extbf{OmniGCD}は、モダリティ固有のエンコーダ(例: 画像、音声、テキスト、リモートセンシング)を用いて入力を処理し、その後に次元削減を行って extbf{GCD潜在空間}を構築する。この潜在空間はテスト時に、独自に合成データで学習したTransformerベースのモデルによって変換され、クラスタリングにより適した表現へと改良される。OmniGCDを評価するために、データセット固有の微調整を許可しない extbf{ゼロショットGCD設定}を導入し、モダリティ非依存のカテゴリ発見を可能にする。 extbf{合成データで一度だけ学習}したOmniGCDは、4つのモダリティにまたがる16のデータセットでゼロショットGCDを実行し、既知クラスと新規クラスの分類精度をベースラインより向上させる(平均パーセンテージポイント改善が、 extbf{+6.2}、 extbf{+17.9}、 extbf{+1.5}、 extbf{+12.7}で、画像、テキスト、音声、リモートセンシングそれぞれ)。これは、表現学習の分離によってカテゴリ発見から独立させつつ、強力なエンコーダが重要であることを示している。モダリティ非依存の手法を改善すれば、その効果はモダリティ間で伝播し、GCDとは独立した形でエンコーダ開発を可能にする。我々の研究は、今後のモダリティ非依存GCD研究のためのベンチマークとして機能し、スケーラブルで人間に着想を得たカテゴリ発見への道を切り開く。すべてのコードは

\href{https://github.com/Jordan-HS/OmniGCD}{here}

OmniGCD:モダリティ非依存性のための一般化カテゴリ発見を抽象化する

arXiv cs.CV / 2026/4/17

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- 本論文は、部分的にラベル付けされたデータから既知クラスと新規クラスの両方を発見することを目指す、モダリティ非依存のGeneralized Category Discovery(GCD)手法「OmniGCD」を提案している。

- OmniGCDは、視覚・音声・テキスト・リモートセンシングなどのモダリティ別エンコーダを用いた上で、次元削減により共有のGCD潜在空間を構成し、テスト時にクラスタリングに適した表現へ変換する。

- 合成データで学習したTransformerベースのモデルの導入と、データセット固有の微調整を禁止する「ゼロショットGCD」評価設定が主要な貢献として挙げられている。

- 4つのモダリティにまたがる16のデータセットで評価した結果、OmniGCDは既知・新規クラスの両方でベースラインを上回る精度向上を報告しており、平均改善幅は視覚+6.2、テキスト+17.9、音声+1.5、リモートセンシング+12.7(ポイント)である。

- 著者らは、表現学習とカテゴリ発見を切り離すことでモダリティ横断のエンコーダ開発を加速できるとし、OmniGCDを今後のモダリティ非依存GCD研究のベンチマークとして位置付けている。