「なに君、AIより賢いの?」という暴力。AIは中立で完璧な答えを出してくれるなんて妄想にすぎない3つの理由

「……でも、AIがこう言ってるんだから、これが正しいでしょ?」

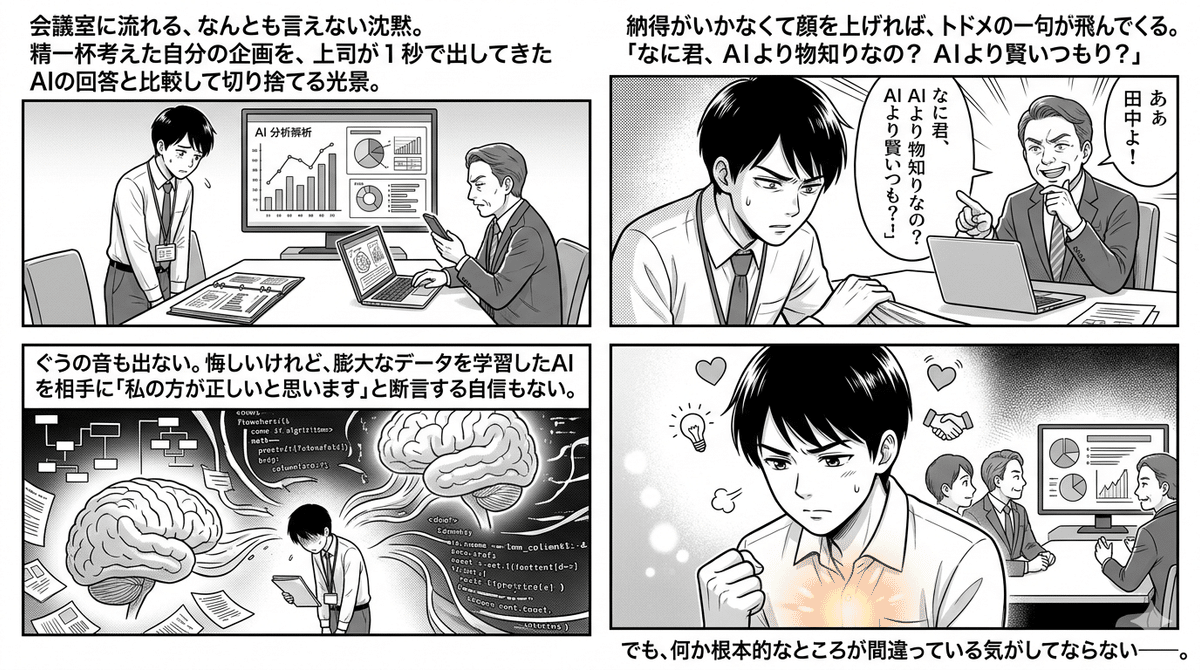

会議室に流れる、なんとも言えない沈黙。精一杯考えた自分の企画を、上司が1秒で出してきたAIの回答と比較して切り捨てる光景。

納得がいかなくて顔を上げれば、トドメの一句が飛んでくる。

「なに君、AIより物知りなの? AIより賢いつもり?」

ぐうの音も出ない。悔しいけれど、膨大なデータを学習したAIを相手に「私の方が正しいと思います」と断言する自信もない。

でも、何か根本的なところが間違っている気がしてならない——。

そんな、喉の奥に小骨が刺さったような「腑に落ちない感覚」を抱えたことはありませんか?

実は、その直感のほうが正しいですよ。AIを「中立で完璧な審判」だと信じ込む人たちが、決定的に見落としている「AIの正体」についてお話しします。

設計者の「意図」と「防衛本能」というフィルター

まず私たちが知るべきなのは、AIは「無色透明の真理」ではないということです。AIの開発には莫大なコストがかかっており、そこには必ず開発企業の「思想」や「防衛本能」が組み込まれています。

例えば、社会的にセンシティブな問題について尋ねたとき、AIは驚くほど優等生で、当たり障りのない回答を返してきます。

これはAIが中立だからではありません。企業が「訴訟リスク」や「炎上」を避けるために、あらかじめ回答の範囲を厳格に制限しているからです。

AIが何を語り、何を語らないか。その「沈黙の境界線」は、設計者の意図によって引かれたものです。中立に見えるその態度は、実は徹底的に計算された「企業の安全策」にすぎないのです。

欧米中心のデータが作る「偏った平均値」

AIが学習しているデータそのものにも、巨大な偏りがあります。現在、主流となっているAIモデルの学習データの多くは、インターネット上の英語圏、つまり「欧米中心」の情報に偏っています。

そこには欧米の価値観、歴史観、文化的な常識が色濃く反映されています。AIはそれらを統計的に処理し、「確率的に、この単語の次にはこの単語がくるのがもっともらしい」と計算しているだけです。

つまり、AIの回答は「全人類の真理」ではなく、欧米的な視点に偏ったデータの「平均値」です。

もし私たちがこの平均値を「絶対的な正解」として採用し続ければ、日本固有の文脈や少数派の視点はノイズとして切り捨てられます。

AIを盲信することは、特定の偏った価値観を「唯一の正解」として再生産し、画一的で平坦な社会を強化することになりかねません。

「問いの偏り」が答えを決める

さらに見落とされがちなのが、質問者側の「問いの質」です。AIは鏡のような存在です。あなたが投げかけた問いに「最もらしい振る舞い」を返そうとします。

「この案がダメな理由を挙げて」と聞けば、AIは全力で否定の材料を揃えます。

問いの立て方(プロンプト)のうまさや公平さ、あるいはそこに混じった主観。それらを人間がコントロールしている以上、そこから出力される結果が純粋に中立であるはずがないのです。

普段の生活を思い出してもらえれば明らかです。例えば、誰かとのトラブルについて友人に話すとき、自分の都合のいい部分だけを切り抜く傾向はありませんか?

当事者である以上、公平中立にどちらの立場にも立たずに話をできる人はほとんどいないでしょう。それと同じです。

問いの前提に偏りがあれば、AIは簡単にあなたの偏見を補強する「裏付けマシーン」に成り下がるのです。

最後に責任を負うのは、常に「生身の人間」しかいない

結論を言えば、この世に「AIに100%任せていい判断」など、ただのひとつも存在しません。

なぜなら、AIは自分の言葉に「責任」を取ることができないからです。AIの判断によって誰かが傷つき、プロジェクトが失敗しても、AIは謝罪も賠償も、後悔もしません。

責任を負えないシステムに最終的な決定権を渡すことは、人間としての権利放棄です。

「AIより賢いの?」という問いは、一見論理的に見えて、実はリーダーとしての責任から逃げているだけです。

AIに膨大な知識でそれっぽいことを言われたら、論破するのは難しいかもしれませんが、あなたが感じている違和感はきっと正しいと思います。その違和感を捨てたらいけませんよ。

まとめ

AIの中立性は、設計・データ・問いのすべてにおいて不可能な幻想です。

・AIの回答は、企業の「設計意図」や「訴訟リスク回避」に縛られている

・学習データは「欧米中心」に偏っており、AIはそれを確率的に再生産する

・「問いの立て方」次第で、結果はいくらでも恣意的に誘導できる

・AIに責任は取れない。判断の最終的な主体は、常に「人間」である

AIを「正解」ではなく、自分の思考を深めるための「道具」として使い倒しましょう。

本記事は、拙著「AIは中立なのか」の2章のテーマをnote用に新たに書き直したものです。より詳しく知りたい方は下記よりどうぞ。読み放題対象です。