2026年4月22日 - リンクブログ

Qwen3.6-27B: 27Bの高密度モデルでフラッグシップ級のコーディング(via)Qwenによる最新のオープンウェイトモデルについての大きな主張:

Qwen3.6-27Bは、エージェント的なコーディングのフラッグシップ級の性能を提供し、前世代のオープンソース・フラッグシップであるQwen3.5-397B-A17B(合計397B / アクティブMoE 17B)を、主要なコーディングベンチマークのすべてで上回ります。

Hugging Faceの Qwen3.5-397B-A17B は807GBで、この新しい Qwen3.6-27B は55.6GBです。

私は、16.8GBのUnsloth Qwen3.6-27B-GGUF:Q4_K_M を量子化したバージョンと、llama-server を、Hacker Newsのbenobによるこのレシピを使って試してみました。その前に llama-server を brew install llama.cpp でインストールしています:

llama-server \

-hf unsloth/Qwen3.6-27B-GGUF:Q4_K_M \

--no-mmproj \

--fit on \

-np 1 \

-c 65536 \

--cache-ram 4096 -ctxcp 2 \

--jinja \

--temp 0.6 \

--top-p 0.95 \

--top-k 20 \

--min-p 0.0 \

--presence-penalty 0.0 \

--repeat-penalty 1.0 \

--reasoning on \

--chat-template-kwargs '{"preserve_thinking": true}'

最初の実行で、約17GBのモデルが ~/.cache/huggingface/hub/models--unsloth--Qwen3.6-27B-GGUF に保存されました。

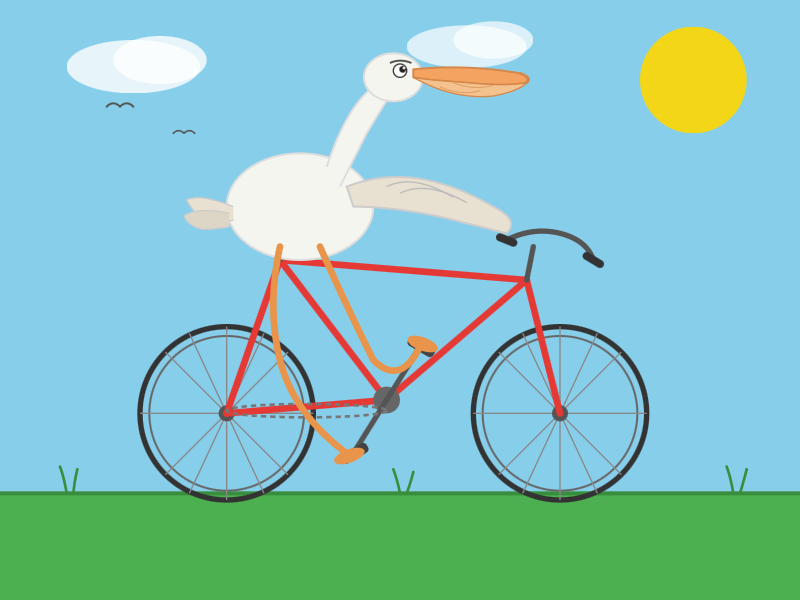

「ハチを自転車に乗せたSVGを生成する」のトランスクリプトはこちらです。これは、16.8GBのローカルモデルとしては傑出した結果です:

llama-serverが報告している性能数値:

- 読み取り: 20トークン、0.4s、54.32 tokens/s

- 生成: 4,444トークン、2分53秒、25.57 tokens/s

おまけに、こちらも E-SCOOTERの上のNORTH VIRGINIA OPOSSUM(ノース・バージニアオポッサム)をSVGで生成する(事前に GLM-5.1で実行済み):

これは6,575トークン、4分25秒、24.74 t/sでした。

最近の記事

- Claude Codeは月100ドルかかるの?たぶん違う——それが全部とてもややこしい - 2026年4月22日

- ハムラジオを持ったアライグマはどこ?(ChatGPT Images 2.0) - 2026年4月21日

- Claude Opus 4.6と4.7のシステムプロンプトの変更点 - 2026年4月18日

これはSimon Willisonによるリンク投稿で、2026年4月22日に掲載されました。

ai 1977 generative-ai 1753 local-llms 155 llms 1720 qwen 55 pelican-riding-a-bicycle 108 llama-cpp 28 llm-release 194 ai-in-china 94月次ブリーフィング

$10/月で私をスポンサーし、今月の最も重要なLLMの動向を厳選したメールのダイジェストを受け取ってください。

私に払って、あなたに送る量を減らしてもらいましょう!

スポンサー&購読