抄録: Dyna-style 強化学習(RL)エージェントは、環境モデルによって生成されたシミュレート経験で価値関数を更新することで、モデルフリーRLエージェントよりもサンプル効率を高めます。 しかし、環境ダイナミクスの正確なモデルを学習することはしばしば難しく、わずかな誤差でさえ Dyna エージェントの失敗につながることがあります。本論文では、その失敗の一つの潜在的な原因が、シミュレート状態の価値をブートストラップしてしまうことにある点を指摘し、その失敗を回避する新しい Dyna アルゴリズムを提案します。ここでは、後継(successor)モデルまたは前駆(predecessor)モデルを用いることで――前向きまたは後ろ向きにシミュレーションする――さらに 1 ステップ更新または多ステップ更新を用いる、という Dyna アルゴリズムの設計空間について議論します。これまでに 3 つの変種が調べられてきましたが、驚くべきことに第 4 の変種は調べられていませんでした。すなわち、多ステップ更新と前駆モデルの組み合わせです。私たちは mph{Hallucinated Value Hypothesis}mph(HVH)を提示します。これは、実状態の価値をシミュレート状態の価値へ更新すると、誤解を招く行動価値が生じ、それが制御方策に悪影響を及ぼし得る、という仮説です。私たちは、4 つの変種すべての Dyna を議論し評価します。そのうち 3 つは実状態をシミュレート状態へ(つまり、幻覚的な価値へ向かう可能性がある値へ)更新するのに対して、提案手法はそれを行いません。実験結果は HVH の裏付けを与え、前駆モデルと多ステップ更新を用いることが、モデル誤差に対してより頑健な Dyna アルゴリズムを開発する上で有望な方向性であることを示唆します。

マルチステップの先行モデルによるDyna計画における価値の幻覚(Value Hallucination)の軽減

arXiv stat.ML / 2026/4/7

💬 オピニオンIdeas & Deep AnalysisModels & Research

要点

- 環境モデルの誤りによって、シミュレーションされた状態が誤解を招く価値推定を生成し、その結果として学習された制御方策を損なうことがあるため、Dynaスタイルの強化学習は失敗する可能性がある。

- 本論文では「幻覚された価値仮説(Hallucinated Value Hypothesis: HVH)」を提案し、実状態の価値をシミュレーション状態の価値へブートストラップすることが誤った行動価値につながり、行動が劣化する可能性を論じている。

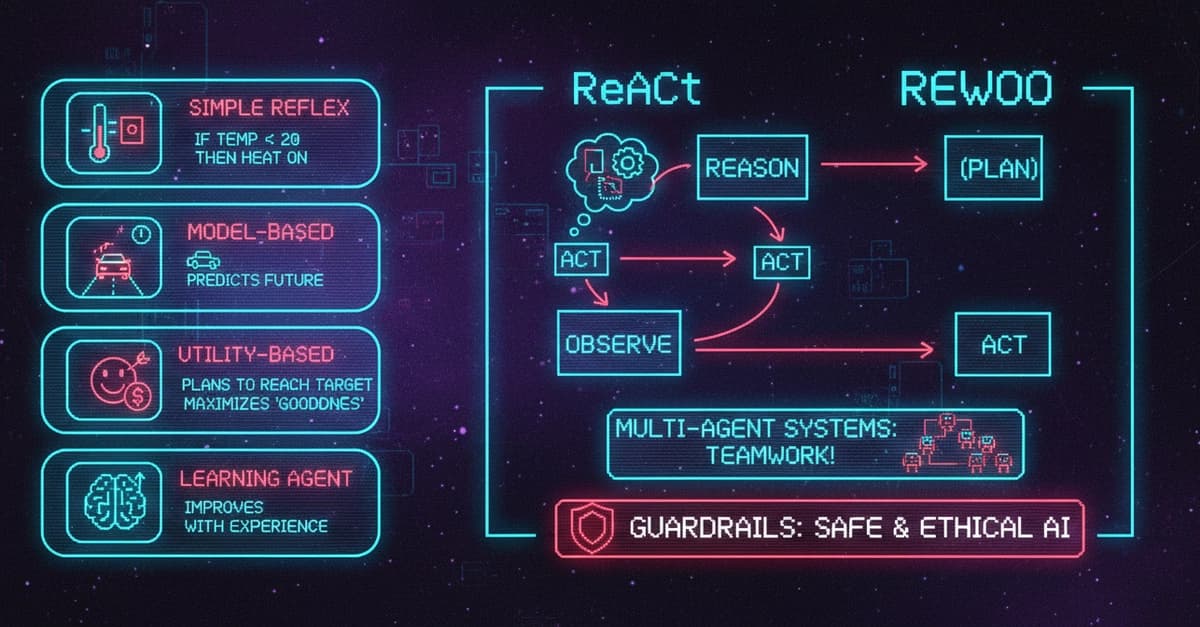

- 本研究は、後継(successor)モデルと先行(predecessor)モデル(順方向 vs. 後ろ向きのシミュレーション)、および1ステップ更新 vs. マルチステップ更新にまたがる、Dynaバリアントの設計空間を概観している。

- 著者らは、先行モデルを用いたマルチステップ更新という、これまで十分に検討されてこなかった変種を導入し、HVHによって示唆される失敗モードを回避できることを見出し、評価している。

- 実験結果はHVHを支持しており、マルチステップ更新を行う先行モデルが、モデル誤りに対してDynaをより頑健にする有望な手段であることを示している。