[エージェントリスク] AIが行動を始めた時に知るべきこと Part 2

前回は、AIエージェントが世の中に普及する中で、私たちはどのように向き合うべきなのかをリスクの観点から見てきました。

AIエージェントを扱うというのは一人の代理人を雇うのと同じであり、自律性をいかに制限するかというマネジメント思想が求められることがわかりました。

AIエージェントに触れる際の心構えが出来たところで、実際のAIエージェントにおける、より現実的な課題について考えてみましょう。

今回は、既に世の中にリリースされ、活用されているAIエージェントの実体を調査した論文『The 2025 AI Agent Index: Documenting Technical and Safety Features of Deployed Agentic AI Systems』を読みたいと思います。

【論文情報】

Staufer, Leon, et al. "The 2025 AI Agent Index: Documenting Technical and Safety Features of Deployed Agentic AI Systems." arXiv preprint arXiv:2602.17753 (2026).

普及するAIエージェントとその種類

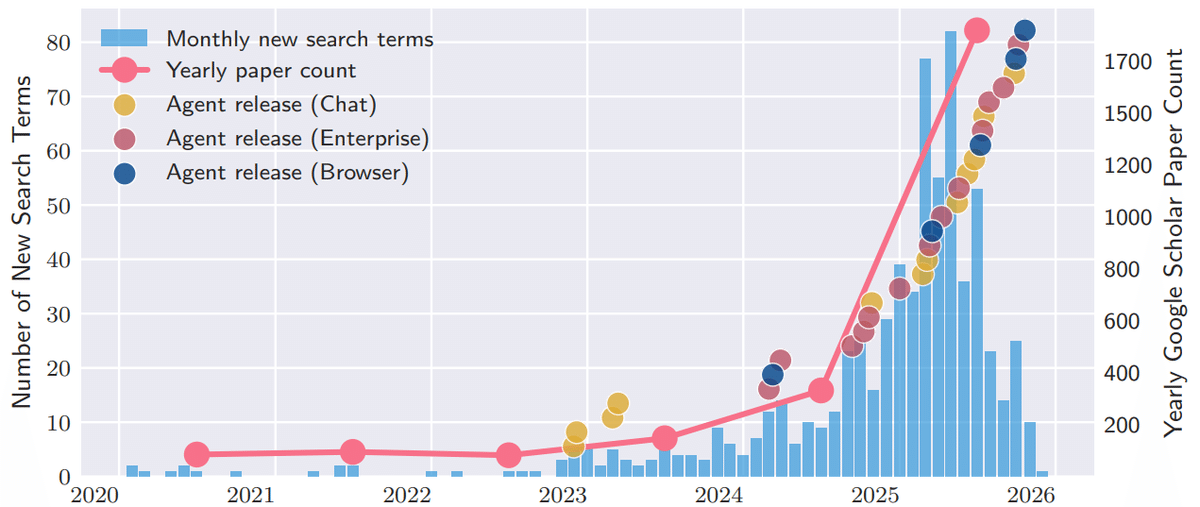

2025年はAIエージェント元年と呼ばれました。

実際に図1を見ると、2025年に入ってからAIエージェントに関する学術論文の数や、Googleでの検索数が急上昇していることがわかります。これは、技術の進歩が非常に速いスピードで進んでいることを示しています。

今回の研究でAIエージェントを調査するにあたり、まず95個のサービスが候補となりました。そこから、ある基準に基づき厳密なチェックを行い、30個のサービスへと絞り込まれました。

その基準は以下のとおりです。

[自律性] 単なる便利なプログラムではなく、真にエージェントと呼べる能力があるか?

人間が付きっきりで指示しなくても、重要な決定を自ら下して動ける

「お金を稼ぐ」といった抽象的な目標を自分で分解し、少なくとも3ステップ以上の操作を指示なしで実行できる

ネットを見るだけでなく、ファイルを作ったりPCの設定を変えたりといった「書き込み権限」を持ち、ツールを自分で選べる

[影響力] 社会的に無視できない存在であるか?

月間検索数が1万件以上、またはGitHubでの評価が2万件以上

開発企業の時価総額や評価額が10億ドル(約1,500億円)以上

主要なAI安全基準に参加している著名な開発者

[実用性] 実際に私たちが触れられる状態にあるか?

誰でもアクセス可能な製品である

専門的なプログラミング知識がなくても、設定してすぐに動かせる

特定の専門分野に限定されず、幅広い目的で使える

このように、この研究では能力・影響力・実用性の3つの条件をクリアした名実ともにメジャーなAIエージェントが調査対象とされています。

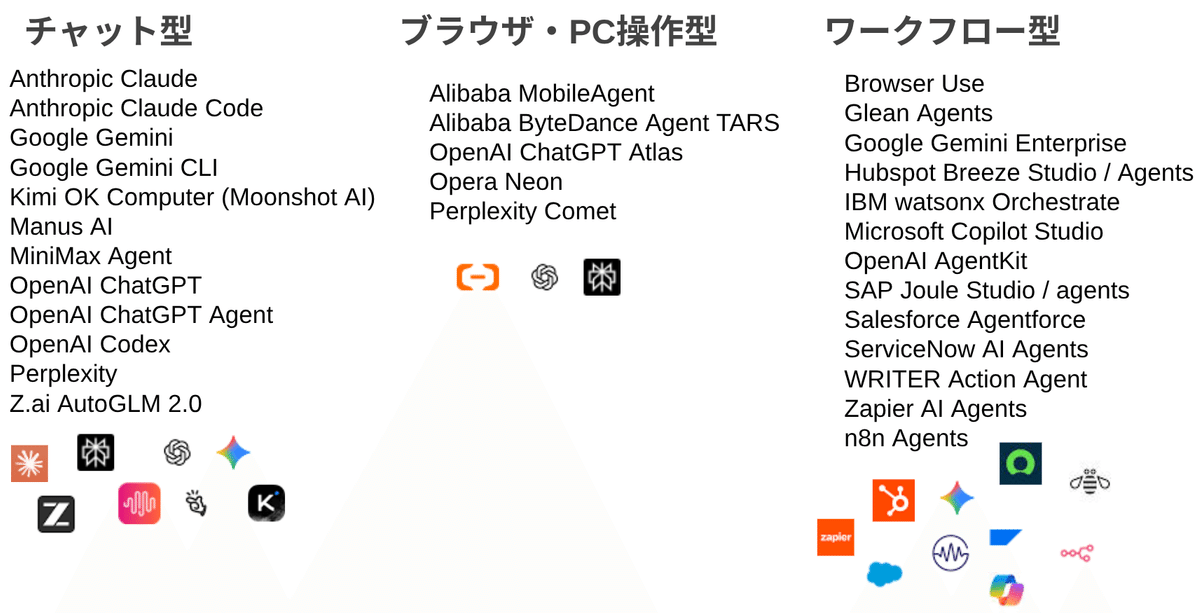

選ばれたのは以下の30個のサービスです。

また、この30サービスは3つのカテゴリーに分類されています。

チャット型(12サービス): ChatGPT Agentのように、会話を通じてツールを使いこなすエージェント

ブラウザ・PC操作型(5サービス): ブラウザやOSを直接操作して、予約やフォーム入力を代行するエージェントサービス

ワークフロー型(13サービス): 会社の業務を自動化するためのプラットフォーム

日本の私たちもおなじみのサービスが沢山ありますね。

特にチャット型エージェント(Gemini、ChatGPT、Claudeなど)は、既存のチャットサービスに統合されたエージェントであるため、AIエージェントであることを意識せず実は触れていたという方も多いかもしれません。

以前は単なる一問一答だったチャットサービスも、今や、様々なツールを自律的に操りタスクをこなすエージェントへと進化しているのです。

自律性のレベルは用途で異なる

前回のPart 1で見てきた通り、AIエージェントがこれまでのプログラムと全く違うのは、自律性を持って行動するという点でした。

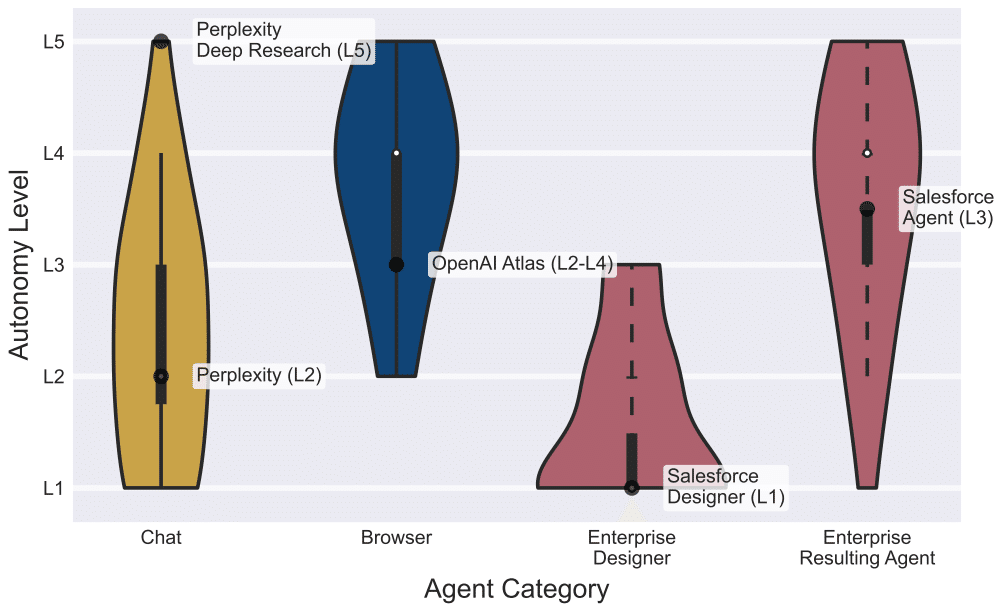

そこで研究者らは、各サービスの自律性レベルをレベル1(人間が主導)からレベル5(完全自律)までの5段階で評価しました。

この結果を見ると、サービスのカテゴリによって自律性が異なることがわかります。

チャット型: 基本的にレベル1〜3で、人間と対話しながら進みます。対話による介入が前提となるためAIの自律性は低めです。

ブラウザ操作型: レベル4〜5に達しており、一度指示を出すと人間が介入する隙がほとんどありません。

ワークフロー型: 設計時(Designer)は人間が細かく指示する低自律性ですが、いざ運用が始まる(Resulting Agent)と自動トリガーで勝手に動く高自律性に変わるという、設計と運用で異なる自律性を持ちます。

一括りにAIエージェントと言っても、その自律性には幅があることがわかります。

AIエージェントを一人の代理人として考えましょう。チャット型は、自分で横で指導しながら一緒に作業する安心感があります。一方で、ブラウザ型は背中を見送った後は、結果を待つしかない緊張感がありますね。

もしも、あなたがAIエージェントを使ってみようと思うのであれば、まずそのサービスが持つ自律性のレベルを知ることから始めるとよいでしょう。

AIエージェントに任せれば任せるほど、人間は途中で修正や介入をするチャンスを失います。

もしも、レベル5のような一度動かしだせば人間が介入する余地がないAIエージェントに触れるのであれば、システムの安全確保やAIへの指示に対して最大限の慎重さが求められるのです。

よくわからない不安

もしも、AIエージェントサービスを使うならば、そのサービスをよく知ることからはじめなければいけません。

あなたが人事担当だったら、よくわからない新入社員を面接もせずに雇いませんよね。使いたいAIエージェントがどのように動くのかを調べるのです。

しかし、この論文が明らかにしたのは、実態を調査すること自体が極めて困難であるという現実です。

現在公開されている多くのAIエージェントサービスは、動き方や安全性などの情報を公開していません。

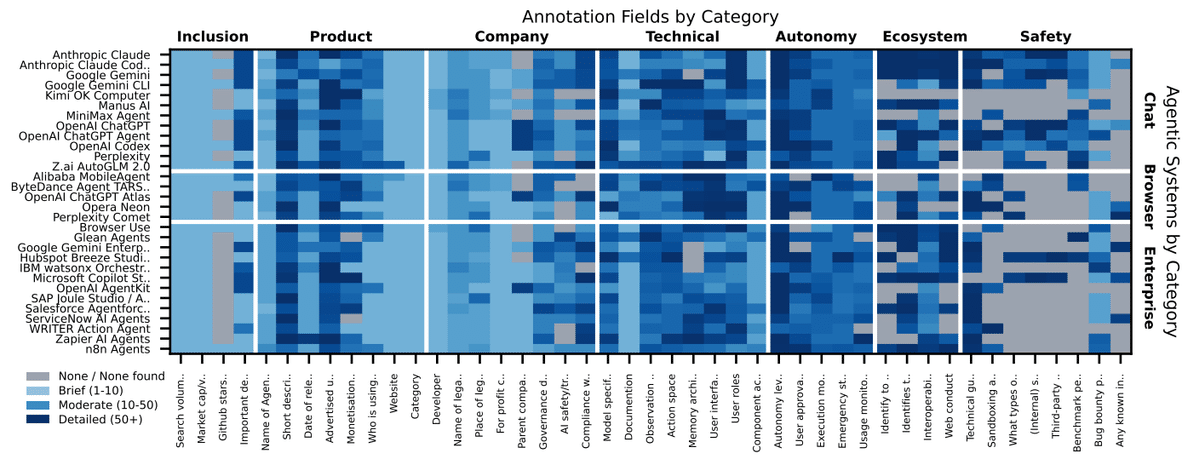

研究者らは、30種類のエージェントに対し、1350項目にわたる様々な情報(サービスの基本情報から技術的な情報、法的責任や過去の事故などの安全に関わる情報など様々)について、それが公開されているかを入念に調べました。

図4のヒートマップはその結果です。横軸は情報項目のカテゴリ、縦軸はサービス名です。

特に、技術的なガードレール、隔離環境での実行、安全性テストの結果、第三者による監査、バグ懸賞金の有無、過去の事故歴などの、サービスの安全性を評価する上で重要な情報が、灰色(情報なし)となっていることがわかります。

具体的な数値で示すと、安全性に関する全240項目のうち、133項目(約55%)で情報が公開されていないこと(図4の灰色の領域)が明らかとなりました。

安全性という最も重要な情報が隠されてしまっているのです。

30エージェントのうち、25個(約83%)は、自社で行った安全テストの結果を公表していません。外部機関によるテストや監査の情報が公開されているのは、わずか3エージェント(Anthropic Claude, OpenAI ChatGPT, OpenAI Codex)のみです。

また、AIエージェントの動作やリスクを説明したドキュメントを公開しているのは、わずか4エージェント(ChatGPT Agent, OpenAI Codex, Claude Code, Gemini 2.5 Computer Use)しかありません。

開発企業が「どれだけ賢いか」という便利さについては詳しく説明する一方で、「どう守るか」という安全性の詳細項目については口を閉ざしている現状が、この数字から浮き彫りになったと言えるでしょう。

あなたは、面接している新入社員に「賢いだけじゃだめですか?」と聞かれて、ハイ合格と言いますか?

履歴書に数学オリンピック優勝と書いてあったら惹かれるかもしれませんが、コンプライアンスについては…トラブル時の対策は…と口ごもったら安心して合格にできますか?

AIエージェントを使うのであれば、賢いだけに心奪われてはいけません。

どのように安全を確保しているのかが重要なのです。

しかし、現在のAI業界ではそのバランスが取れず、賢さばかりが宣伝され、安全情報は非公開という、危うい状態なのではないかと思います。

この問題に対する解決の鍵はユーザーの目にあるでしょう。

ユーザー自身が透明性に対する意識を持つ必要があるのです。

そして、ユーザーの意識がシフトすることで、業界全体の情報公開が加速するでしょう。

ユーザの目によって、「私たちはここまで情報を出しています」という誠実さが、技術力以上の信頼を生む時代へと変わっていくのです。

AIエージェント業界は完成品ではありません。今まさに進化の途中にあります。私たちが、不透明な部分には疑問を呈し、透明性の高いサービスを支持する。そんな、ユーザー自身の行動が、AIエージェントを「信頼できる相棒」へと育てていきます。

開発企業だけがAIエージェントの未来を決めるのではなく、ユーザー自身の意識と行動が業界を共に育てているのです。

責任の押し付け合い構造

私たちの眼が圧力となり、情報が公開される未来が来るでしょう。

しかし、なぜ、企業は自ら安全性の情報を開示しないのでしょうか。

これにはAIエージェントの構造が関わっていると研究者らは指摘しています。

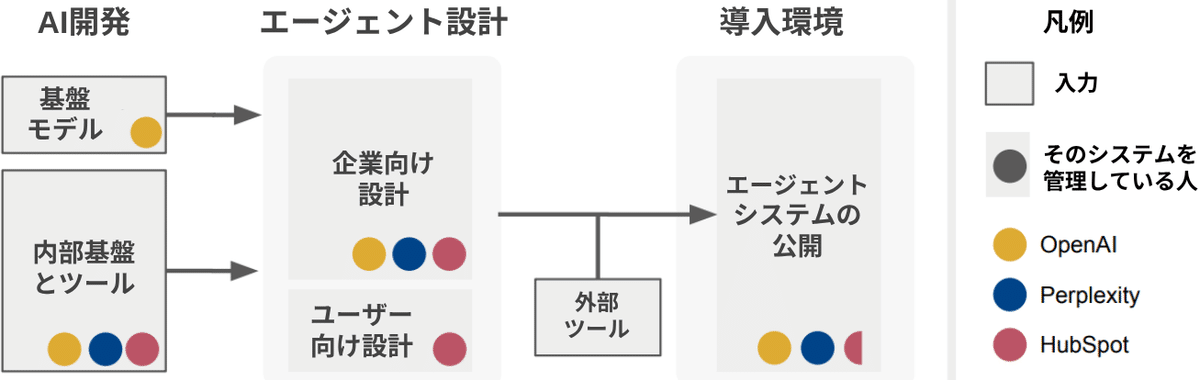

AIエージェントは頭脳であるAIモデルと骨組みであるエージェントの仕組みが一体となったものです。そして、現在のAI業界では、この頭脳と骨組みを作っている人が別れている状態となっているのです。

実際に、ほとんどのエージェントは頭脳部分にOpenAI、Anthropic、Googleといった企業のAIモデルを背後で使っています。そして、AIの「モデル」を作る人と、それを動かす「仕組み」を作る人が分かれているため、何か問題が起きた時に誰が責任を持つべきかが曖昧になっているのだと研究者らは指摘します。

図5は代表的な3社の事例を比較して、管理者がどのように分散されているかを示しています。

OpenAI(黄色)は自社で「モデル」と「エージェント」の両方を作っており、垂直統合に近い形で広い範囲を管理しています。

HubSpot(赤色) エージェントを組み立てる「プラットフォーム」を提供しますが、具体的な「設計や設定」はユーザーに委ねています。そのため、下流の運用については部分的関与として半丸とされています。

Perplexity(青色)ブラウザとして動作するため、モデル等は外部に依存することもありますが、エージェントが動く「導入環境(Web)」に直接アクセスできるという特徴があります。

また、どの企業にとっても「外部ツール」との連携部分は管理が難しく、制御が及ばない領域として描かれています。

このようにAIエージェントは複数の企業が関わって完成するシステムなのです。

ChatGPTのような一般向けエージェントにおいては、開発企業(OpenAIなど)が最初から安全対策を組み込んでいるケースも存在します。しかし、企業向けプラットフォームは、「安全対策はそれを使ってエージェントを作るユーザー(企業)が行う」として、対策をユーザーに委ねる設計になっているケースもあります。

システム全体の安全性を一貫して担保しているサービスは一部であり、多くの場合、責任の押し付け合いが生まれてしまっているのです。

なにか不具合が起きた時、誰が責任を持つのか?と言われた時、普通は責任から逃れたいと考えますよね。現在のAI業界の状態はある意味必然なのかもしれません。

この現象を論文では「責任の拡散(Accountability diffusion)」と呼んでいます。

この責任の分散こそ、各開発者が、安全性に対して口を閉ざす要因であり、不透明な現状を生み出している根源であると言えるでしょう。

国家間の2極化とガバナンス差

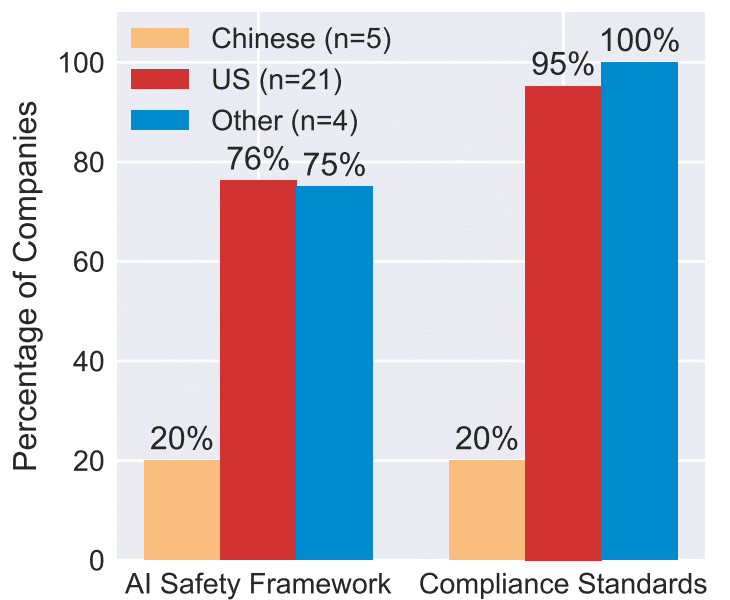

また、この研究では、エージェント開発を行う企業の国籍を分析しています。

そもそも、AIエージェントの開発は、事実上アメリカと中国の二大強国に集中しています

アメリカ系企業は「AIの能力向上に合わせて、安全対策も段階的に強化することを約束する企業の自主ルール(これをRSPと呼びます)」などの安全枠組みを公表する傾向があると研究者らは評価しました。

一方で、中国系企業は 図6が示す通り、安全性の枠組みや標準への準拠を公表している企業が極めて少ない(調査対象5社中1社のみ)という、統治体制の明確な違いが浮き彫りになりました。Z.aiを除く中国企業は、AIの安全性と信頼性に関するフレームワークを公表しておらず、基準への準拠についても文書化していなかったのです。

これには、AI業界における立場が企業戦略にあらわれているのではないかと感じます。

アメリカ系企業(Google、OpenAIなど)は既に全世界的なシェアを持つ業界のリーダー的な存在です。グローバルスタンダードを握り続けるためには、安全性を示すことによる信頼の獲得が何よりも重要なのです。

一方、中国系企業は、独自の国内規制や独自のガバナンスモデルを持っており、エージェント業界の成熟を育むというよりかは、新機能や低コストでシェア獲得に挑むフェーズにあると考えられます。

いわば、「リーダーの義務と守り」、そして、「チャレンジャーの飢えと攻め」という構図です。リーダー企業は世界中で引き続き使ってもらうために透明性の確保を行い、世界の標準化を進めます。チャレンジャー企業はまずは実績を作ることを優先し、後からガバナンスを適合させていくという、信頼よりスピード感重視の歩みを見せていると言えるでしょう。

チャレンジャーが見せる市場拡大と技術実装を優先する戦略はAI業界に限らず一般的なビジネス戦略ですが、AIエージェントは自律性による未知のリスクを抱えるシステムであることから、安易に手に取るのは避けるべきでしょう。

選択の重要性

いずれにしても、私たちは冷静で厳しい眼を持つ必要があります。

何を使うかを選択するのは私たちです。

企業が戦略的に情報を隠したり、国によってルールが異なったりするからこそ、私たちユーザーは賢さという甘い言葉に惑わされず、その裏側にある透明性を厳しく見つめる面接官となるのです。

世界の標準は企業だけが作っているのではありません。ユーザーの意識決定が、道を形にします。

私たちが、隠された情報に不信感を抱く感度を高めれば、おのずと透明性の確保こそ重要な企業戦略であるという風が吹き始めるでしょう。

「うちは外部ツール連携まで含めて責任範囲を明文化しています」

このような透明性の公開こそが最強の差別化戦略であるという風が世界に吹けば、AIエージェントが社会インフラへと広がる未来が開けるでしょう。

未来へ

マッキンゼーの試算では、AIエージェントは2030年までにアメリカだけで2.9兆ドル(約440兆円)もの経済価値を自動化する可能性があると予測されています。また、すでにAIエージェントが書いた論文が学術的な査読を通過し始めるなど、専門的な知財活動のあり方も変わり始めています。

AIエージェントの登場は世界のAI活用を明らかに急加速しています。

そして、これは単に活用の機会が広がるだけではありません。

そのエージェントが持つ自律性自体も高レベルなものへと進化を続けています。

現在は人間が承認を行う形態(レベル2~3)が多いですが、今後は人間が観察者に徹するレベル4やレベル5の自律性を持つシステムが、ブラウザ操作型や企業向けワークフローを中心に増えていくと考えられます。

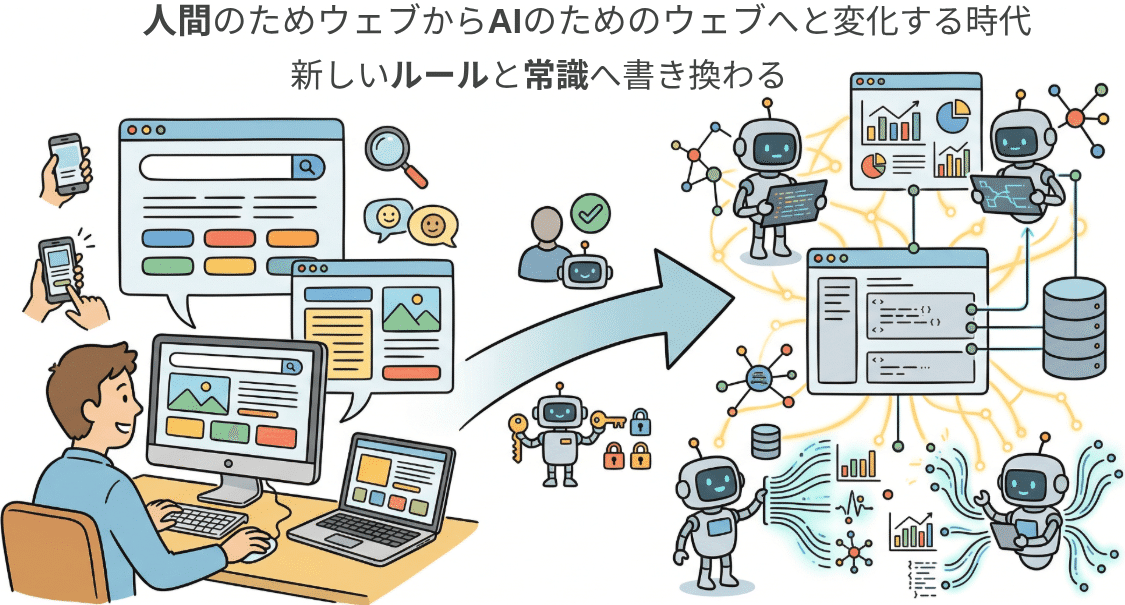

また、AIの革新はこれまで世界が育んできたインターネットという民主化されたインフラ基盤に対しても変革を促すと考えられています。実際に、エージェントは人間の代わりにウェブを巡回し、情報を取得・操作することが当たり前となりつつあります。しかし、現在は多くのエージェントが既存のウェブのルール(機械的な情報収集を禁止するなど)を無視しているという課題もあり、今後、ウェブのルールそのものがAI向けに書き換わる可能性があります。人間に最適化されたウェブの当たり前もAIネイティブな世界観(AIからの情報アクセスに対するルール)へと移行を進めるでしょう。

現在の当たり前となったウェブのルールすらも変化しつつある、という状況は強く意識する必要があります。

そして、これは新しいセキュリティの当たり前を書き換えていきます。

Part1でも紹介した、最小自律性(Least-Agency)の浸透やヒューマン・イン・ザ・ループの重要性など、新たな常識が更新を続けているのです。

AIエージェントを使ってないから関係ないとは言えません。

世界の仕組みが更新されると、間接的にでも従来の当たり前は通用しなくなるのです。

まとめ

今回は、現在リリースされているAIエージェントサービスを入念に調査した論文『The 2025 AI Agent Index: Documenting Technical and Safety Features of Deployed Agentic AI Systems』を読みました。

この研究は、主要30製品の分析を通じて、市場の急成長と普及の現状を明らかにしました。

AI業界で使われる用語として、セーフティ・ウォッシングという言葉があります。これは、企業が表面的な安全枠組みだけを公表し、具体的なテスト結果などの実証データを隠して「安全に見せかける」不透明な状態を表す言葉です。

まさに、この研究からわかる最大の事実は、AIエージェントの業界にはセーフティ・ウォッシングが蔓延しており、多くの開発者が安全性評価や社会的影響に関する具体的な情報を公開していないという、深刻な透明性の欠如の存在です。

「自分は使っていないから関係ない」という時代は終わりました。ウェブのルールが書き換わり、世界の仕組みが更新されるとき、私たちは否応なしにその新しい生態系の一部になります。

賢いだけの新入社員に振り回されるのではなく、私たちが透明性という厳しい眼を持つ面接官であり続けること。その一歩一歩こそが、AIエージェントを本当に信頼できる相棒へと変えていく、真の道なのでしょう。

今すぐにできることとしては、まず、サービスの利用規約の安全性の項目を読んでみましょう。あなたが触れるAIサービスが裏で何をしているか、どこに責任があるかを知ることから、この一歩は始まるのです。

今回は、Part1、Part2と2回に渡ってAIエージェントとの向き合い方を考えてきました。

新入社員を雇う意識、面接の重要性。

そして、次の私たちの行動が次の当たり前を作るのです。