VOFA:力適応制御によるホムンクルス向けビジュアル・オブジェクト・ゴール・パッシング

arXiv cs.RO / 2026/5/5

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- 本論文は、オンボードの自己中心視(エゴセントリック)映像知覚を用いて、特権的な物体状態情報なしに物体を任意の目標位置へ押し出せるホムンクルス(ヒューマノイド)向けのロコマニピュレーション手法VOFAを提案している。

- VOFAは2層の階層構造からなり、高レベルのビジュオモータ・ポリシーがノイズを含む視覚観測から目標条件付き指令を生成し、低レベルの力適応型全身コントローラが物体質量や地面摩擦など未知の物理特性に対応する。

- 視覚ノイズやアクチュエーション誤差といった現実の不確実性を前提に、実時間の閉ループ制御でロバストに動作することを狙っている。

- Booster T1での評価では、シミュレーションで90%以上、実機試験で80%以上の成功率が報告されている。

- VOFAは最大17kgの物体を押せることを示し、これはBooster T1の体重の半分超に相当し、倉庫での資材取り扱いのような物理的に負荷の高い作業能力を裏付けている。

関連記事

キオクシア、27年にAI向け100倍速SSD 「NVIDIAから要望」

日経XTECH

無料で「ComfyUI」「Open WebUI」などからローカルAIモデルをGPUで動かすDocker環境を一発で構築し動かし続ける「Puget Systems Docker App Packs」

GIGAZINE

小売のチャージバック回収はAgentHansaの“本当のPMF”になり得る理由

Dev.to

RTX3090でQwen3.6 27B/35Bをローカル実行すると遅い・コードが壊れる——より良い設定と自動モデル切替を探す

Reddit r/LocalLLaMA

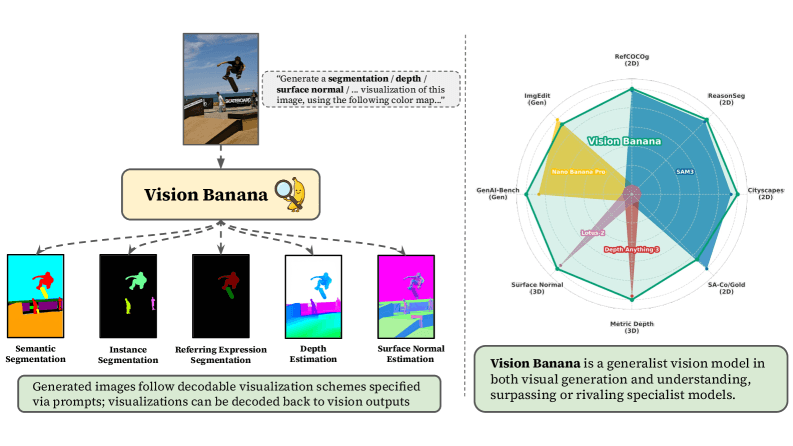

先週のAIまとめ #340 - OpenAI vs ムスク+マイクロソフト、DeepSeek v4、Vision Banana

Last Week in AI