親愛なる皆さま、

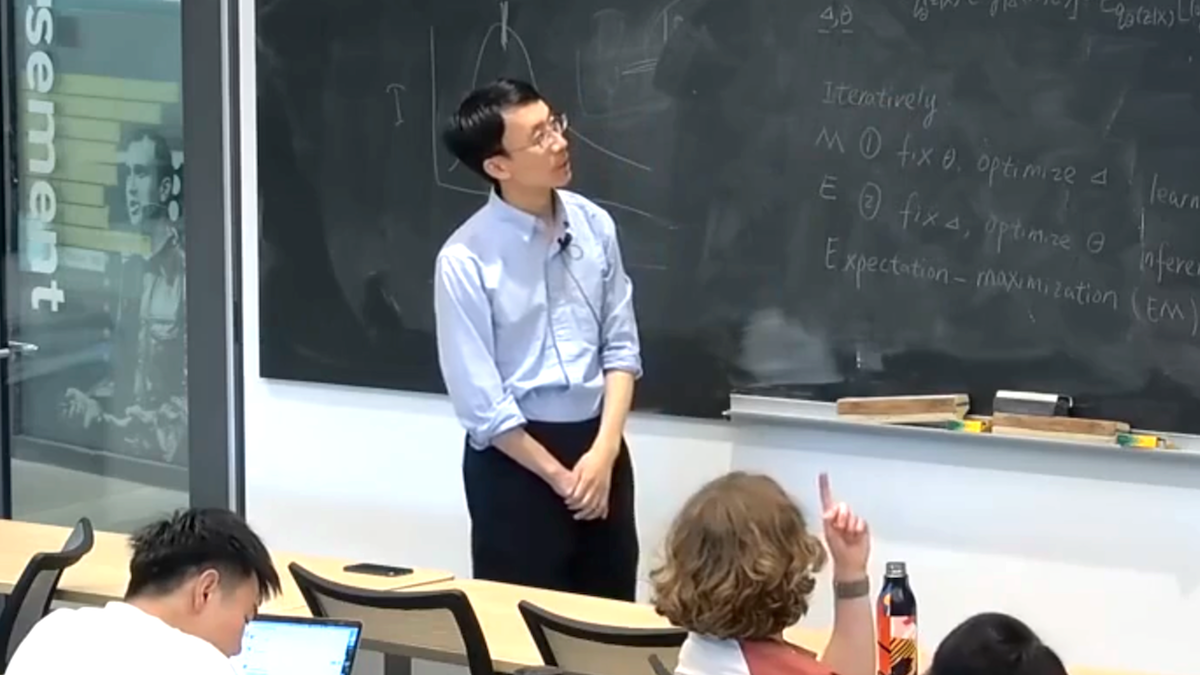

2026年あけましておめでとうございます!今年こそついにAGIを達成する年になるでしょうか?今回は、新たなチューリングテストのバージョンとして「チューリング-AGIテスト」を提案したいと思います。なぜ新しいテストが重要なのか、少し後で説明します。

一般の人々は、AGIを達成するとはコンピュータが人間と同じくらい賢くなり、ほとんどまたはすべての知的労働ができるようになることだと考えています。私は新しいテストを提案します。テスト対象はコンピュータか熟練した専門家の人間で、インターネットアクセスやウェブブラウザ、Zoomなどのソフトウェアが使える状態のコンピュータにアクセスできます。審査員は複数日にわたる業務タスクの実行体験を設計し(例として、コールセンターのオペレーターとしてのトレーニング期間後に実際に電話対応をするなど)、フィードバックを受けながら作業を行います。これはウェブカメラがない完全なコンピュータを使うリモートワーカーが求められることを模しています。

コンピュータが熟練した人間と同等に業務遂行できれば、チューリング-AGIテストに合格したことになります。

多くの一般の人々は、本物のAGIシステムはこのテストに合格すると信じているでしょう。コンピュータが人間と同じ知能を持つなら、人間が雇うレベルの仕事ができて当然だからです。したがって、このテストはAGIの一般的なイメージに沿ったものです。

なぜ新しいテストが必要かというと、「AGI」という言葉が誇大宣伝の文脈で使われ、明確な意味を持たなくなっているからです。合理的なAGIの定義は「人間ができるあらゆる知的作業をこなせるAI」ですが、企業が数四半期以内にAGIを達成すると大げさに言う場合、実際には基準を大幅に下げて言い訳します。この定義のズレは有害で、人々にAIの実際の力以上に強力であると誤解させます。私は高校生やCEOまで、AGIが間近に迫っていると信じて特定分野を避けたり、数年以内にAIが実情を超越した能力を持つと誤解して投資判断を誤っている例を多く見ています。

もともとのチューリングテストはテキストチャットで人間がコンピュータと区別できなくなることを求めましたが、人間レベルの知能を示すには不十分でした。ローブナー賞のコンペでは、人間らしいタイプミスなどをシミュレートしないと審査員を騙せないことが分かりました。今日のAI開発の主な目標は審査員を騙すことではなく、経済的に有用な仕事を遂行することです。したがって、人間を騙す能力を問うより、本当の業務遂行能力を測る改良版テストのほうが有益です。

現在の多くのAIベンチマーク(GPQA、AIME、SWE-benchなど)は事前にテストセットが決まっており、AIチームは間接的にそこに最適化されがちです。固定のテストセットは知能の一部しか測りません。一方、チューリングテストでは審査員が自由に質問して知能の一般性を試験できます。チューリング-AGIテストでも審査員はAIや人間に事前には知らされない体験を設計して、一般性を測る方法として優れています。

AIは驚異的な進歩を遂げています。過去数十年の過剰な期待はAIの冬をもたらし、能力不足で失望と資金減少を招いたものの、進歩で再び盛り上がりました。AIの勢いを妨げうる数少ない要因は過度な誇大宣伝による投資バブルのリスクです。これを避けるために社会のAIへの期待値を調整する必要があり、その助けとなるのがテストです。

もしチューリング-AGIテストコンペを開催し全てのAIシステムが基準に達しなければ、それは良い結果です。過剰な期待が緩和されバブルが減れば、より確かな道筋でAIへの投資が続き、AGIの域に達しなくても価値ある進歩や応用が着実に進むからです。このテストが明確な目標となれば、AGI達成を名乗る基準として素晴らしいものになります。そしてもし企業がこのテストをクリアすれば、単なるマーケティングリリース以上の非常に価値ある何かを創ったことになります。

新年おめでとうございます。素晴らしい1年をお過ごしください。

アンドリュー

2026年のエージェントたち

必要な要素は整いました。AIモデルは一貫したテキスト、画像、動画、その他のデータを生成し、独自データベースにアクセスし、ウェブを操作して行動も起こせるようになりました。これからは、私たちの生活を良くし、組織や地域社会の運営を支援するインテリジェントなアプリケーションの爆発的増加が訪れるでしょう。今回のThe Batch特別号では、AI界屈指の識者たちが次の展開に対する希望を共有しています。

オープンソースが勝つ

David Cox 著

私の願いは、オープンAIが引き続き繁栄し、最終的に勝利を収めることです。

オープンなエコシステムは常に真のイノベーションの原動力でした。コミュニティは何十年もの進歩を基盤とし、単一企業の資源だけでなく共同の才能を活用できます。1990年代にはLinuxやApache、Eclipseなどのオープンソフトウェアが支配的なプロプライエタリシステムに挑み、現代のインターネット形成に大きな影響を与えました。今、同じ原則がAIの進化を導くべきです。

その類似性は不気味です。一部のプレイヤーはAIを支配・コントロールしようとしています。かつてマイクロソフトが開発途上国で無料のWindowsを配布してLinuxの普及を妨げたように。

過去のマイクロソフトの無料フロッピーディスクのように、主要なAI開発者はオープンモデルと称しながら実際は閉じているモデルを提供しました。訓練データや数式は非公開にされ、収益上限も設けられています。誰もが利用できず、自社製品だけが勝つ仕組みです。

しかし、本当にオープンなAIの可能性は極めて重要です。AIが特定企業に所有されず、一つの企業の価値観だけを反映しないこと。また、他社、学者、一般ユーザーも未来を形作るのに参加できることが重要です。

オープン開発には重要な利点があります。一つはベンダーロックインのリスクを減らせること。API背後のプロプライエタリモデルに依存するのは誰も望みません。二つ目はカスタマイズ性が高まること。オープンモデルは法的にカスタマイズ可能で、どう作られたかが分かるため改変しやすいのです。

中国では活発なオープンエコシステムがあり素晴らしい成果を上げていますが、地政学的な影響もあります。国同士の不信感があり、データが汚染されたモデルが作られる可能性もあります。真のオープン開発は、訓練データとその取得方法が誰もに知られるため、これを解決します。

IBMではこの方針を実践しています。モデルの詳細、訓練方法、特にデータ内容を公開しています。スタンフォード透明性指数で95%のトップスコアを取り、2位に23ポイント差を付けました。アレン研究所や中国の開発者も素晴らしい仕事をしていますが、前述の地政学的問題は残っています。米中双方が互いのモデルを信用していません。

IBMは慎重派という評価がありますが、それは決して悪いことではありません。安定は基盤であり、そのうえで最先端の実験が可能です。2026年はもっとオープンで、実験的で、少し慎重なAIを推進しましょう。

David CoxはIBMリサーチのAIモデル担当副社長で、MIT-IBM Watson AIラボのディレクターです。以前はハーバードで自然科学・応用科学・工学を教えていました。

科学的発見のためのAI

Adji Bousso Dieng 著

2026年にはAIが効率化のツールから科学的発見の触媒へと進化することを願っています。

過去10年、深層学習の主流は補間でした。非常に強力なモデルが訓練データの分布を模倣することに優れ、会話エージェントやコーディング支援など既存データの統計的パターン識別で十分な分野で輝きを放っています。AlphaFoldのように監督学習問題として定式化できる科学的課題でも成果が出ています。

しかしそのパラダイム内では、分布の稀な例、いわゆるテール部分が課題となります。私たちが開発したVendiscopeによるデータ収集監査の研究で、AlphaFoldでも稀なタンパク質の3D構造予測に苦戦することが判明しました。また、物理科学の大きな課題、例えば新規タンパク質の設計やCO2吸着用の新金属有機構造体(MOFs)の発見は監督学習問題として定義できないことが多いです。これらは希少な発見問題として捉えるべきです。

こうした場合、主要な分布モードは科学的にはあまり興味深くありません。2026年には、この発見の鍵を解き、分布のテールを制御し分布外の意味ある発見を可能にする技術を開拓してほしいと思います。目標は自然界に存在するが今まで観測されていないものを見つけることです。

補間から発見への飛躍には、機械学習を駆動する目的関数の根本的な変革が必要です。精度や確率的尤度最大化の目標は補間を促し、主たる分布モードへの収束をもたらします。これに対し、多様性を第一級の目標として位置づける必要があります。多様性は単なる公平性の社会技術的概念ではなく、発見の数理的推進力にしなければなりません。

私の研究室VertaixではVendiスコアを開発しました。材料発見研究では、Vendiスコアの最適化により、標準的探索法が見落とす、数兆規模の材料空間を効果的に調査して安定かつ省エネルギーなMOFsの特定に成功しました。

2026年には多様性を評価の二次的指標とするのをやめ、発見の主たる数学的エンジンとして扱うことを提案します。これが実現すれば、AIは単なる人間知識の模倣者を超え、その拡張の真のパートナーになるでしょう。

Adji Bousso Diengはプリンストン大学のVertaixラボ創設者で、米国科学財団のデータ駆動型動的設計研究所の共同主任研究者です。また、アフリカの若者向けSTEM教育を支援する非営利団体The Africa I Knowの創設者でもあります。

AIと共に働く教育―対立せずに

Juan M. Lavista Ferres 著

3年以上前、OpenAIはChatGPTをリリースし、教育は永遠に変わりました。学生にとって、数秒で流暢で信頼できる文章を生成できるのは驚異的な新ツールです。教育者にとっては新たな挑戦です。来年、教育界がAIを教育ツールとして受け入れ、生成メディア時代の生徒評価方法の確立に注力することを願っています。

ChatGPT登場後しばらくは、生成AIによる作文が書ければ検出器で見つけられるという安心的なストーリーが広まりました。一部の初期研究では制御された環境でほぼ完ぺきな検出率が報告されました。これにより評価の方法を変えなくて済むと期待されました。

しかしこれは幻想でした。実験室では検出器はよく働きますが、学生は生のモデル出力を提出しません。検出器があると学生はそれを回避しようとします。そしてそれは難しくありません。段落を書き直す、誤字を加える、文の長さを変える、構成を並べ替える、個人的なエピソードを挿入する、翻訳と再翻訳をする、あるいは人間らしく見えるように出力を自動書き換えするツールを使うなど。

構造的な問題はこうです。AI生成テキストを検出するシステムを作れば、それを破るシステムを訓練できます。検出器の導入と同時に、起業家はそれを突破する製品を作り、学生は使いこなします。

最大の問題は効果的な検出器の設計ではなく、「信頼の維持」です。教育者が検出器スコアに頼り、学生がそれを回避するプログラムを使うと、教育者は疑念や処分の判断に追い込まれます。学生と対峙し異議申し立てに対応し、確実な証拠なく厳しい判断を下すことになりかねません。非英語圏の学生や既定の学術様式を習得している学生に不利益となるリスクもあります。悪用する学生ほど適応が速いので、検出は誤ったターゲットを罰し、精巧な回避は阻止できません。

生成AIは学習を改善できます。練習支援、フィードバック、個別指導の提供、教材の翻訳、学習の個別化などで役立ちます。

しかし現実的であるべきです。従来の家庭課題のエッセイは、独立執筆の普遍的証明としてはもはや機能しません。文章だけで著者の独立性を大規模に検証することは困難です。大学や学校は学生が生成AIを使うことを前提とし、その現実で機能する評価モデルが必要です。

具体的な実践例:

- 理解の実演を活用すること。筆記試験、口頭試問、ライブライティング、プレゼンテーション、プロジェクト説明で理解度と所有権を示す。

- AIリテラシーを教えること。検証、引用、バイアス認識、責任ある使用をカリキュラムに組み込む。

- AIに対抗するのではなくAIを前提とした設計を行うこと。家庭課題ではAI利用を想定し、適切に取り入れた課題を作り、生徒の判断力、推論力、適用力を評価する。

魔法はもはや瓶に戻せません。今の仕事は、私たちが実際に生きる世界で教育をより効果的かつ信頼できるものにするルールと慣行を築くことです。

Juan M. Lavista Ferresはマイクロソフトのチーフデータサイエンティスト兼コーポレートバイスプレジデントで、Microsoft AI for Good LabとMicrosoft AI Economy Instituteを率いています。

予測から行動へ

Tanmay Gupta 著

2026年のAI研究はシンプルだが革命的な認識に取り組むべきです:予測を行うモデルは、行動を起こすシステムとは異なります。私たちに必要なのは後者です。

過去10年、私たちはパッシブな予測や生成モデルに卓越しました。画像内の物体のバウンディングボックスやセグメンテーションマスクの生成、音声のテキスト変換、流暢な文章や画像の生成などが含まれます。これは驚くべき成果ですが、あくまで代替タスク、すなわち実際の世界の経済的価値を代表するものとされるものに過ぎません。この考えは誤りです。実際の経済的に意味あるタスクは単一の入力から単一の予測や生成で終わるものではなく、複雑で動的な環境における長期にわたる一連の行動(各行動は一つまたは複数のモデルからの予測や生成に基づく場合もあります)を必要とします。各行動が環境の状態を変え、次の行動に影響を与えるのです。

2026年、AI研究はこれらの代替タスクの解決から、この代理タスクがおおよそ近似する長期の現実的タスクの解決へ決断的に移行しなければなりません。例えばコーディングはかつて1行の自動補完が主でしたが、現代のコーディングエージェントは高級仕様を受け取り、コードベースを検索し、テスト実行し、最小限の人間の介入で解決策を返します。

この進化を他の分野にももたらしたい。たとえばビジョンモデルは、視覚入力ストリームを使ってデジタル(ウェブ・PC操作)や物理的(身体化された)ワークフローを動かし、プロセス監視・洞察抽出を行うより大きなシステムの一部として研究されるべきです。音声システムは会話で伝えられた目的を理解し、デジタルや物理的ツールと連携するインテリジェントな対話アシスタントの一部として研究される必要があります。画像・動画生成モデルは、既存文書やマーケティング資料から長尺ビジュアル教育コンテンツや研究成果の生成システムの一部として研究されるべきです。

これら長期タスク・目標指向AIシステムへの注力は2つの大きな利点をもたらします。第一に、より大きなシステム構築の際に現行AIモデルの限界や課題が露出します。これらの目標指向AIは、予測や生成能力だけでなく、持続的な記憶、長期の目標に集中する能力、リアルタイムの人間フィードバックへの応答性、不確実な環境変化への対処能力が必要です。さらに多種多様なマルチモーダル情報源との効果的なインターフェース、ツール呼び出し、仮説設定・推論、継続学習・自己改善なども求められます。これらの能力の欠落は短期や単発の予測タスクでは見えづらいですが、複雑な長期シナリオで顕在化します。これらの知能側面を評価し改善する方法が必要です。

第二に、この目標中心の再構成はAI研究を最終タスクの実用性に結びつけます。真の最終タスクを直接解くことで、見せかけの代理タスクに翻弄されることが減ります。例えば長年、意味解析は自然言語理解の重要な要素と考えられてきましたが、現在の大規模言語モデル(LLM)は意味解析を明示的にしなくても高度な言語理解と操作が可能です。振り返ると、多くの研究時間は意味解析の正確度という代理指標の追求ではなく、最終タスク解決に費やすべきでした。

実際のデジタル・物理タスクは数分から数か月、時には数年に及び展開します。人間は長期間にわたり集めた多様な情報を統合し、一貫した世界観を形成して進化する環境下で複雑な目的遂行を行う驚くべき能力を持っています。過去10年の深層学習の技術進歩、とくにLLM・VLMは、今後10年でシリコン上にこの能力の複製を試みる土台を十分に築きました。ここ数年で登場したLLM駆動のエージェントシステムは明確なワークフローを自動化しています。未定義・不完全・未発見・未想像の課題への挑戦が次なる境地です。

Tanmay GuptaはAllen Institute for Artificial Intelligenceの上級研究員で、CVPR 2023で最優秀論文賞を受賞した「Visual Programming: Compositional Visual Reasoning Without Training」の共著者です。彼の研究はマルチモーダルエージェント、コーディングエージェント、VLM、VLAなどに及びます。

バイオメディシン向けマルチモーダルモデル

Pengtao Xie 著

ここ数年、テキスト、画像、配列、グラフ、時系列を同時に推論するモデルが急速に進歩しました。しかしバイオメディカル領域では、これらの能力は断片的だったり脆弱であったり、解釈性に欠ける場合が多いです。2026年にはコミュニティが科学的根拠に基づき透明かつ実際のバイオメディカル研究・臨床意思決定に役立つ強力なマルチモーダルモデル構築へ決断的に進むことを望みます。

重要な優先事項は、形式的なモダリティの連結にとどまらず、深いマルチモーダル統合です。生物系は分子、細胞、組織、臓器、患者のスケールや視点が多様で、それらは配列、構造、画像、経時的記録をまたぐ複雑なメカニズムでつながっています。基礎モデルはこの構造を反映し、生物学的意義を保存する表現を学び、多様なモダリティにまたがって一貫した推論を可能にすべきです。これには新たな事前学習目標、優れた帰納的バイアス、生物学的文脈を記述する原理的手法の開発が必要です。たとえば、経路や細胞状態、疾病表現型のような生物学的アンカーを共有し、それを軸にモダリティ間の表現を明示的に整合させる目標設定などが考えられます。そうすることで一つの視点で学んだ情報がほかの視点に移っても意味を保持できます。

もう一つ重要なのは解釈性です。バイオメディシンでは単なる予測では不十分で、研究者や臨床医はモデルがなぜその決定をしたのか、どんな証拠に基づくのか、出力が既知の生物学とどう関連するのかを理解したいのです。マルチモーダルモデルがより大規模かつ汎用的になるにつれ、多モダリティを横断する説明手法を優先し、予測を分子相互作用や画像領域、患者データの時系列パターンにまで遡って追跡できるようにすべきです。例えば、異なるモダリティの要素(遺伝子やアミノ酸残基など)を別のモダリティの証拠(画像領域や時間点)に明示的に結びつける構造化されたクロスモーダル説明を生成できるようにモデルを設計することも考えられます。

データ効率と適応性も重要な目標です。多くのバイオメディカル分野はラベル付きデータが少なく、分布変動が大きく、知識も不完全です。マルチモーダル基礎モデルは新しいタスクや疾患、医療機関に最小限の再訓練で対応でき、堅牢性と較正性を維持する必要があります。このためにパラメータ効率的適応、継続学習、不確実性認識推論が重要です。

2026年の進歩はベンチマークだけでなく、バイオメディカルワークフローへの統合で測られるべきです。仮説生成、実験設計、対話的探索を支援するツールの開発を含めます。こうしたツールによって専門家が単に予測を受動的に利用するのではなく、多ターンダイアログでモデルと協働できるようになります。

これらの優先事項をAIコミュニティが共有すれば、マルチモーダル基礎モデルはバイオメディカル研究の信頼できるパートナーとなり、理解の加速をもたらし、人間の健康を支援する複雑さと責任を尊重する存在となるでしょう。

Pengtao Xieはカリフォルニア大学サンディエゴ校の准教授で、アブダビのモハメド・ビン・ザーイド人工知能大学の兼任教員です。以前は生成AIスタートアップPetuumのエンジニアリングシニアディレクターを務めました。

コミュニティを築くチャットボット

Sharon Zhou 著

来年、AIが私たちそれぞれとの1対1の関係から飛び出すのを見ることが楽しみです。2026年は、AIが人々を結びつけ人間のつながりを強め、分断や孤立化ではなく団結をもたらす可能性を秘めています。そろそろChatGPTがあなたのグループチャットに参加する時代かもしれません。

今日のインターネットは2つの極端に押しやられているように感じます。一方は、AIによる低品質なコンテンツの大量発生で、昔のインターネットよりも劣り雑音の多いものです。フォーラムにボットが参加し、AIスクレイパーによるDDOSが毎日約100万回も発生するのは珍しくありません。もう一方は、人間による厳しい検閲でLLMをできる限り排除しようとする動きです。

しかしこの緊張は対立でなく融合にもなりえます。AIは人々をつなげ人間同士の絆を強めるよう設計可能です。チャット内のボットは、ただの中立的アシスタントや偽装エージェントではなく、ポジティブな結束の力となります。そのためには後訓練で長文コンテキストを扱い、多人数の状況や目的に適応するための強化学習環境を整備するなど変革が必要ですが可能です。そして、これが人間と人工の知能双方の新たな高みをもたらすと信じています。

深夜3時にあなたが関係の悩みとコードのデバッグの類似性についてLLMに話すと、LLMが「同じように感じている別の人と話したいですか?」と提案します。あなたは「こんな時間にちょっとニッチな悩みかと思ったけど、まあいいか」と思います。さらにLLMは単に紹介するだけでなく、そのチャットに参加して面白いミームを投げたり興味深い質問をして会話を盛り上げ、新たな友人ができ、問題が解決し、関係に新しい視点がもたらされます。気づけば仕事や私生活に役立つ何かを学び、まだ3時15分です。

好奇心は共有されると加速し、伝染し、グループでその方向、範囲、探求を目指すとき学びやすくなります。集合的道具としてAIは私たちの好奇心と創造性を共に高められます。さらに、その啓発的な会話の一部はAIの知能を向上させる新たなデータとなるかもしれません。

AIが人々を結びつけ、帰属意識を促す未来を設計し、結果として人々がより多くの発明を生み、集合知を高め、それが孤立した対話でのベンチマークでは得られない形でモデルを押し上げるデータとなるのは大いに歓迎すべきことです。これは、今日のスクラッチパッドメモリのより進化したバージョンのような、各個人や多面的自己に部分的に共有される軽量な重みを持つ極端なMoE(専門家混合)という新しいモデルアーキテクチャの動機づけにもなる可能性があります。

今、進歩は間近でこの未来は完全に実現可能です。だからこそ私はワクワクしています。今年はAIが人類全体と個々人の人間性によりポジティブな力となる一歩を踏み出すことを願っています。これがその方向へ進むひとつの道です。

Sharon ZhouはAMDのAI担当コーポレートバイスプレジデントです。以前はLamini創設者・CEOやスタンフォード大学の非常勤講師を務めました。