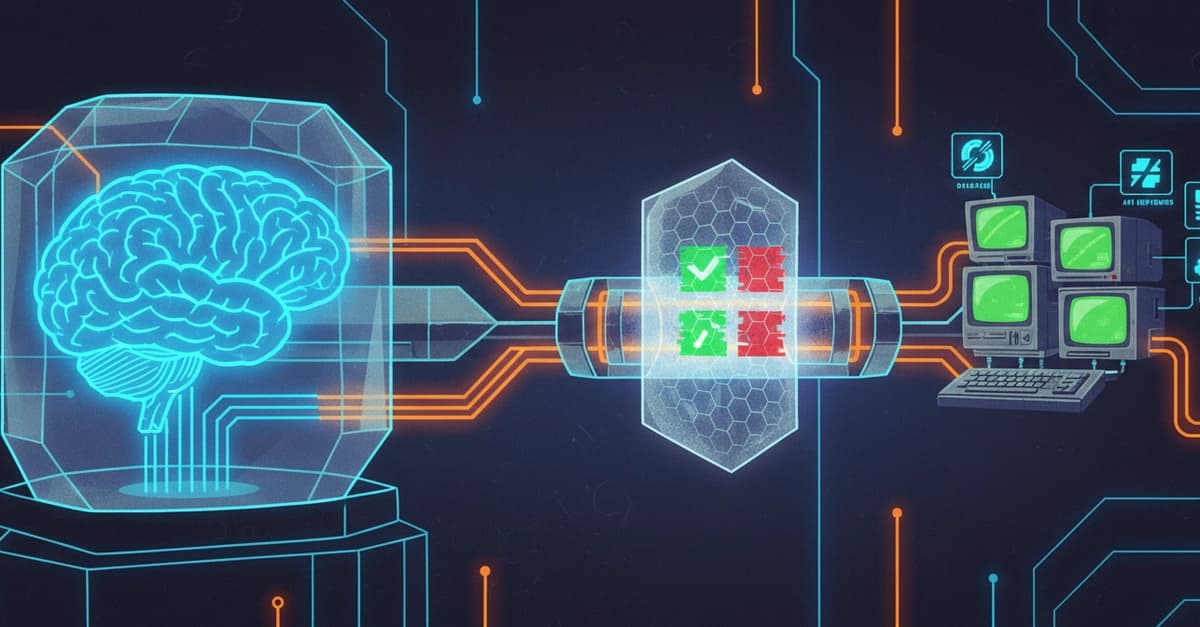

要旨: 人間の知覚は異なる領域にわたってうまく一般化しますが、多くの視覚モデルは学習データを超えると苦戦します。このギャップは、多領域での分布シフトに対する頑健性を高めるために、1つのモデルを多様なデータセットで学習するマルチデータセット学習を動機づけます。しかし、データ分布の不整合やラベル意味論の違いにより、統一的な学習は依然として困難です。Mixture-of-Experts(MoE)モデルは、入力を専門のサブネットワーク(エキスパート)へルーティングすることでスケーラブルな解決策を提供します。それでも、既存のMoEはしばしば効果的に専門化できません。理由は、ロードバランシング機構がエキスパート間で入力分布の一様性を強制してしまうためです。この「公平性」は、領域を意識したルーティングと衝突し、エキスパートは冗長な表現を学習することになり、特に稀な領域や分布外(out-of-distribution)の領域で性能が低下します。そこで本研究では、学習されたルータをグローバルなスケジューラに置き換えるプランナー・コンパイラの枠組みであるGEM(Global Expert Mapping)を提案します。線形計画法の緩和に基づく本プランナーは、データセットをエキスパートへ割り当てる「分数(fractional)」の割当てを計算し、一方でコンパイラは階層的な丸め(hierarchical rounding)を適用して、このソフトな計画を決定的で、かつ容量(capacity)を考慮したマッピングへ変換します。先行するMoEとは異なり、GEMはバランシングに伴う損失を回避し、公平性と専門化の間の衝突を解消し、解釈可能なルーティングを実現します。実験の結果、GEM-DINOはUODBベンチマークで最先端の性能を達成し、十分に表現されていないデータセットで顕著な改善を示すとともに、少数ショット適応シナリオにおけるタスク干渉(task interference)を解決します。

グローバル・エキスパート・マッピングによるマルチドメイン学習

arXiv cs.CV / 2026/4/22

📰 ニュースIdeas & Deep AnalysisModels & Research

要点

- 本論文は、視覚モデルが学習データ以外の領域に対して一般化しにくいという課題に取り組み、ドメインシフトへの頑健性を高めるためのマルチデータセット学習を動機づけています。

- Mixture-of-Experts(MoE)の既存手法は、ロードバランシングがエキスパートへのルーティングを一様にしやすいため、専門化がうまく進まず、レアまたは分布外ドメインで性能が低下し得ると指摘しています。

- そこで著者らは、学習されたルータをグローバルスケジューラに置き換えるプランナー–コンパイラ枠組み「GEM(Global Expert Mapping)」を提案しています。

- GEMでは、線形計画法の緩和に基づいてデータセットからエキスパートへの割り当てを“分数”として計算し、階層的な丸めによって決定的で容量を考慮したマッピングへ変換します。

- 実験では、GEM-DINOがUODBベンチマークで最先端の性能を達成し、過小に表現されたデータセットでの改善や、few-shot適応でのタスク干渉の解消にも顕著な効果が示されています。