オイラーからドーマンド=プリンスへ:フローモデリング生成モデルのためのODEソルバ

arXiv cs.LG / 2026/5/5

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- この論文は、フローマッチング生成モデルがODEの数値解法を必要とし、その計算コストの大半がニューラルネットの順伝播に支配される点を踏まえ、オイラー法、陽的中点法、古典的RK4、ドーマンド=プリンス5(4)をテイラー展開から第一原理で導出します。

- テイラー展開に基づいて作った各ODEソルバをPyTorchでスクラッチ実装し、2次元の玩具分布からMNISTまでのConditional Flow Matchingタスクで、品質指標としてスライス付きワッサースタイン距離を用いて体系的にベンチマークしています。

- NFE(関数評価回数)と品質のパレートフロンティアを構築した結果、RK4は関数評価約80回で、オイラー法の約200回と同程度のサンプル品質に到達し得ることを示しています。

- 実験的観察として、(1) 学習された速度場のヤコビアン固有値スペクトルがt=1付近で急に硬化し、適応的なドーマンド=プリンスが終端側でステップ予算を自動的に集中する理由を説明しています。(2) 学習不足や小規模モデルでは低次ソルバと高次ソルバの品質ギャップが拡大し、モデルが不完全なときほどソルバ選択の影響が大きいことを報告しています。

- コードと実験スクリプトはすべて公開されており、再現や発展的な検証を容易にしています。

関連記事

キオクシア、27年にAI向け100倍速SSD 「NVIDIAから要望」

日経XTECH

無料で「ComfyUI」「Open WebUI」などからローカルAIモデルをGPUで動かすDocker環境を一発で構築し動かし続ける「Puget Systems Docker App Packs」

GIGAZINE

小売のチャージバック回収はAgentHansaの“本当のPMF”になり得る理由

Dev.to

RTX3090でQwen3.6 27B/35Bをローカル実行すると遅い・コードが壊れる——より良い設定と自動モデル切替を探す

Reddit r/LocalLLaMA

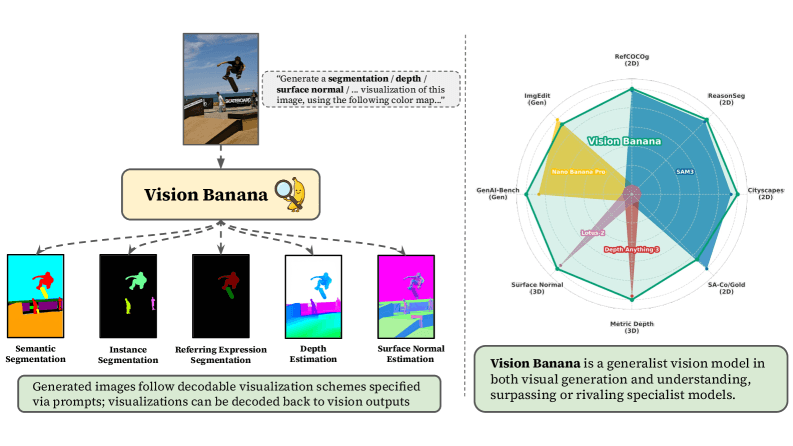

先週のAIまとめ #340 - OpenAI vs ムスク+マイクロソフト、DeepSeek v4、Vision Banana

Last Week in AI