概要: ビデオ・アウトペインティングは、空間的な忠実性を維持し、フレーム間で時間的な一貫性を保ちながら、元のフレーム境界を超えて動画に見える内容を拡張することを目的とします。既存手法は主として拡散モデルなどの大規模生成モデルに依存しています。しかし、生成ベースのアプローチは、暗黙的な時間モデリングと限られた空間コンテキストという問題に悩まされます。これらの制約は、不整合としてフレーム内およびフレーム間に現れ、特に動的なシーンや大規模なアウトペインティングの場面で顕著になります。これらの課題を克服するために、本研究ではビデオ・アウトペインティングのための、伝播ベースと生成ベースのパラダイムを統一する新しい枠組み Seen-to-Scene を提案します。具体的には、Seen-to-Scene は、ビデオのインペインティング向けに事前学習されたフロー完了ネットワークを用いたフローベースの伝播を活用し、ドメインギャップを埋めて一貫したモーション場を再構成するために、エンドツーエンドで微調整します。さらに、伝播の効率と信頼性を高めるために、参照ガイド付き潜在伝播を導入し、ソースとなる内容をフレーム全体へ効果的に伝播させます。大規模な実験により、本手法は、効率的な推論により、既存の最先端手法でさえ必要とする入力依存の適応を上回る形で、優れた時間的な一貫性と視覚的な現実感を達成することを示します。

Seen-to-Scene:見えている内容を保持し、見えていない部分を生成するビデオ・アウトペインティング

arXiv cs.CV / 2026/4/17

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- ビデオ・アウトペインティングは、元のフレーム境界を超えて動画の可視内容を拡張しつつ、空間の忠実性とフレーム間の時間的一貫性を維持することを目的としているが、既存手法は暗黙的な時間モデリングや空間文脈の不足により不整合が起きやすい。

- 本論文は、Seen-to-Sceneという枠組みを提案し、伝播ベースと生成ベースの考え方を統合することで、動きの大きいシーンや大規模なアウトペインティングで顕著になるフレーム内・フレーム間の不一致を抑える。

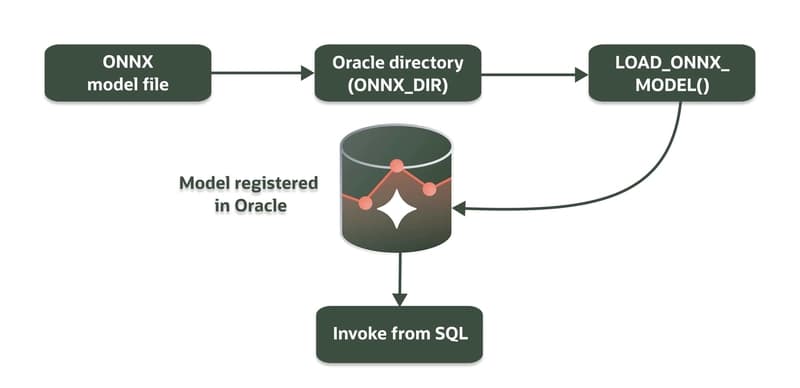

- Seen-to-Sceneは、ビデオ・インペインティングで事前学習したフロー補完ネットワークを用いたフロー伝播を採用し、エンドツーエンドで微調整して、整合的なモーション場を再構成することでドメインギャップを埋める。

- さらに、参照ガイド付きの潜在伝播(reference-guided latent propagation)を導入し、ソース内容をフレーム間で伝播させる際の効率と信頼性を高める。

- 実験では、効率的な推論で時間的一貫性と視覚的なリアリティが改善し、入力ごとの適応を要する先行の最先端手法よりも良い性能を示すと報告されている。