親愛なる皆さま、

AIは新たな雇用機会を創出するのでしょうか?私の娘ノヴァは猫が大好きで、お気に入りの色は黄色です。彼女の7歳の誕生日に、GeminiのNano Bananaを使ってデザインした黄色い猫をテーマにしたケーキを作り、それを美味しいスポンジケーキとアイシングでベーカーに形にしてもらいました。娘はこの特別なケーキに大喜びし、このプロセスはベーカーに追加の仕事をもたらしました(私がそれを負担できたことを光栄に思います)。

多くの人はAIによる雇用喪失を心配しています。社会として、生活の糧を失う人々を支える道徳的責任があります。同時に、私は人々が新しい仕事を担い、責任範囲を拡大する多くの機会も見ています。

AIが新たな雇用を大量に生み出す道はまだ初期段階です。AI設計のケーキ焼きが大きなビジネスになるかはわかりません。(AI Fundはこの機会を追いかけていないのは、もしそうしたら私が太りすぎるからです。)しかし歴史を通して、人々が人間の創造力を解き放つツールを発明するたびに、多くの新しく意味ある仕事が生まれてきました。例えば、ある研究によると、過去150年間で、農業や製造業の雇用減少は「介護、創造、技術、ビジネスサービス部門の急速な成長により十分に補われている」と報告されています。

またAIは多くのデジタルサービスの需要を拡大しており、これがそのサービスの創造、維持、販売、拡大に関わる人々の仕事を増やしています。例えば私自身は以前は1日に限られた数のウェブ検索をしていましたが、現在はコードを操作するエージェントが劇的に多くの検索を行っています。週末プロジェクトとして始め、Yixing Jiangが改良に協力したAgentic Reviewerは、研究論文を自動的にレビューし、関連する研究をウェブ検索APIを通じて探すことで、私が手動で行う検索数をはるかに上回っています。

AIとソフトウェアの進化は加速し続けており、私たちが構築できるものの機会は日々増え続けています。私はコードを書くのをやめました。もっと論争的ですが、AI生成コードを直接読むのも長らくやめています。私は少数派かもしれませんが、コードの文法を直接確認せずとも自分の望むものの多くを構築できる感覚があります。コードを操作するエージェントを使い、高度な抽象レベルで作業しています。PythonやTypeScriptのような従来のプログラミング言語は、アセンブリのように人間が直接確認せずに生成・利用される形に近づくのか、それともモデルが英語のプロンプトから直接バイトコードを生成する形になるのか、興味深い問題です。

どちらにせよ、もしすべての開発者の生産性が10倍になっても、需要に天井がないために開発者数が1/10になるとは思いません。むしろソフトウェア開発者が大幅に増えるでしょう。実際、私は「Xエンジニア」という仕事の兆しも見ています。例えばリクルーティングエンジニアやマーケティングエンジニアは、その業務領域Xに特化してソフトウェアを作る人々です。

ノヴァの誕生日ケーキでの経験から確信していることは、AIは私たちの生活をより良くできるということです!

引き続き創り続けましょう。

アンドリュー

DEEPLEARNING.AIからのメッセージ

「AI Dev 26 × サンフランシスコ」の最初のスピーカーが公開されました!AIを形作るリーダーの話を聞き、実践的な技術ワークショップに参加し、実世界のシステムのライブデモを体験し、新しいAIスタートアップトラックで新興スタートアップを発見しましょう。ラインナップを確認してチケットを確保してください。

ニュース

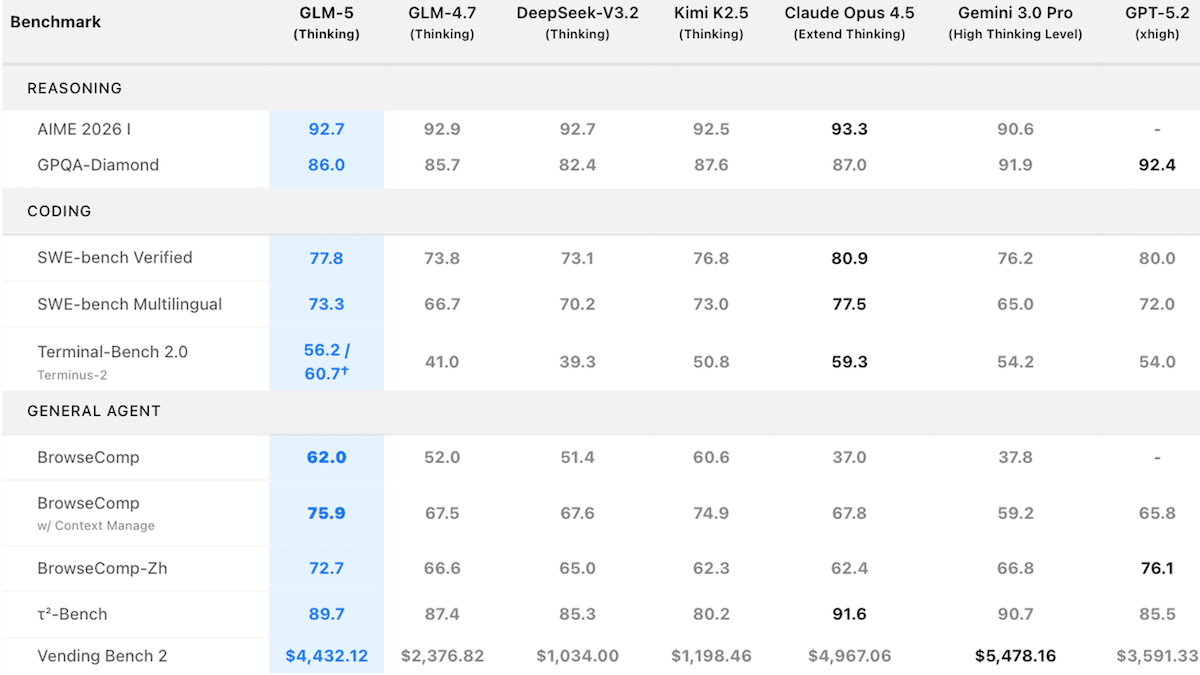

GLM-5のスケールアップ

Z.aiは、旗艦の大型言語モデルを倍以上に拡大し、オープンウェイトの競合モデルの中で顕著な性能を実現しました。

新要素:GLM-5は長時間にわたるエージェントタスク向けに設計されており、Artificial Analysisのインテリジェンスインデックスで他のオープンウェイトモデルを上回っています。

- 入出力:最大20万トークンのテキスト入力、最大12.8万トークンのテキスト出力

- アーキテクチャ:エキスパート混合型トランスフォーマー、7440億パラメータ、1トークンあたり活性化パラメータ400億

- 特徴:関数呼び出し、推論、コンテキストキャッシュ

- 性能:Artificial Analysisインテリジェンスインデックス、𝜏²-Bench Telecom、Vending Bench 2、Chatbot Arena Codeのオープンウェイトモデルで最高性能

- 利用可能性/価格:ウェブインターフェースは無料、重みはHugging FaceよりMITライセンスで商用・非商用利用可。API利用はトークン単価1.00ドル/0.20ドル/3.20ドル。コード生成計画は四半期27ドル〜216ドル。具体的なアーキテクチャや訓練データは公開されていません。

仕組み:Z.aiはGLM-5のアーキテクチャと学習について一部を公開。28.5兆トークンでの事前学習(GLM-4.5の23兆トークンから増加)や強化学習に用いるスライム(slime)というオープンソースツールの活用、長文コンテキスト処理にDeepSeekのスパースアテンションを用いて計算量を削減しています。

性能:コード生成やエージェントタスクでオープンウェイトモデル最高の性能を示す一方で、一般的にはプロプライエタリな最先端モデルの後塵を拝しています。

- 人工分析のインテリジェンスインデックスでは、推論を有効にしたGLM-5は前オープンウェイトリーダーのKimi K2.5(47)を上回る50を記録。Claude Opus 4.6(53)、GPT-5.2(51)に次ぐ3位。

- エージェントタスクの𝜏²-Bench Telecomで推論有効時98%、無効時97%を達成。Vending-Bench 2では4432.12ドルでオープンウェイトモデルの中でトップ。

- Chatbot Code Arena(人間審査員による対戦評価)では1449 ELOでオープンウェイト1位、合計6位。Claude Opus 4.6に次ぎ、Gemini 3 Proと同率、Kimi K2.5を上回る。

重要性:GLM-5は人工分析インテリジェンスインデックスでプロプライエタリモデルに迫る性能を示し、オープンウェイトとプロプライエタリモデルの差が縮まることで、開発者は自身のハードウェア上で高性能なモデルを改変・運用できる選択肢を得ています。

考察:オープンウェイトAIの中心は東アジアに大きくシフトしています。最近、中国の開発者はGLM 4.5、Kimi K2、Qwen3-VL-235B-A22B、Kimi K2.5など一連の先進的モデルをリリースしています。

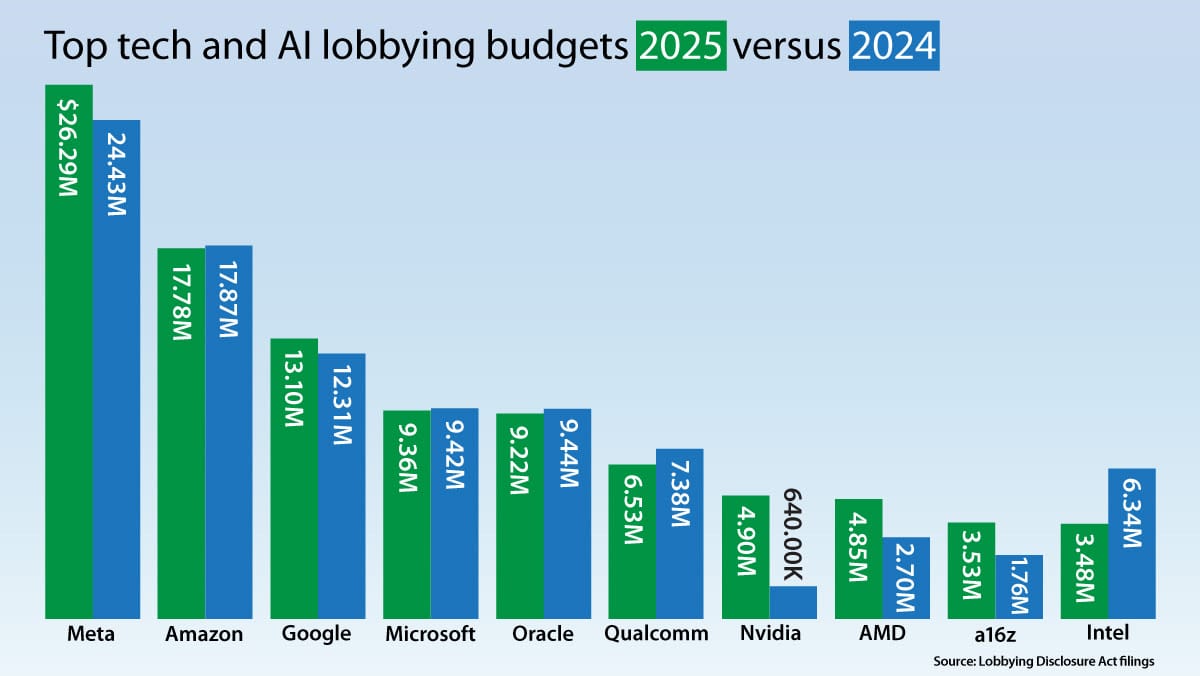

巨大AI企業の大規模なロビー活動支出

2025年、主要なテックおよびAI企業は政府政策に影響を与えるため1億ドルを超える支出を行い、過去最高となりました。

概要:Metaは昨年、業界全体で最多の2629万ドルをロビー活動に投入したとBloombergが報じています。次いでAmazon(1789万ドル)、Alphabet(1310万ドル)、Microsoft(936万ドル)が続き、Nvidiaも2024年の7倍に膨らみ490万ドルとなりました。こうした大規模ロビー活動により、連邦政府はデータセンター建設支援や先端AIチップの中国への販売禁止解除など、テック企業に有利な政策へと動きました。(開示:アンドリュー・ングはAmazonの取締役を務めています。)

仕組み:企業のロビー活動支出は通常、政策提言や法案案作成の助言に使われ、政治行動委員会や業界団体を通じて間接的に行われます。(推進候補者への支出はさらに多く、Metaは今年AIに理解ある州の政治家当選のために6500万ドルを割り当てたとThe New York Timesが報じています。) 昨年最もロビー活動に費やした10社の中にはホワイトハウスのプロジェクトや政治団体への寄付を行った企業もあり、トランプ政権との関係が深い元政府関係者の採用や幹部のホワイトハウス公式イベント出席、政権優先課題への支出コミットメントも見られます。

- Meta、Alphabet、Nvidia、AMD、ベンチャーキャピタルのAndreessen Horowitzは2025年にロビー活動予算を増加。Amazon、Microsoft、Oracleはやや減少。QualcommとIntelは大幅減。

- Alphabet、Apple、Meta、Microsoftはトランプ大統領の優先課題であるホワイトハウス宴会場再建のために資金提供を誓約。OpenAIのGreg Brockman社長と妻も大統領の政治行動委員会に2500万ドル寄付。

- Metaは新たな社長兼副会長に元トランプ顧問を招聘、元政権関係者を総合法務顧問に昇格。OpenAIも元トランプ顧問をグローバルエネルギー政策トップに採用。

テックに有利な政策:国のAI政策はロビー活動金額の多い企業の利益を反映しています。

- 米国にはAIを明示的に規制する国法はありませんが、Meta、OpenAI、Andreessen HorowitzはいずれもAIの州レベル規制に反対。2025年12月、トランプ大統領はAIを統制する州法を制限する行政命令を出しました。

- 連邦政府は長年Nvidiaの最先端AIチップの中国販売を阻止し500億ドルの売上が阻害されてきました。Nvidiaはロビー活動を64万ドルから490万ドルに増額。CEOジェンセン・フアン氏はトランプ大統領と度々面会。大統領は7月に販売禁止を緩和し12月に解除しました。

- OpenAIは2024年の176万ドルから約300万ドルにロビー活動費を増額し、AI処理巨大データセンターネットワーク計画「Stargate」へのホワイトハウス支援を求めています。CEOサム・アルトマン氏は就任翌日にトランプ大統領とともに記者会見、データセンターの場所決定・許認可・資金調達迅速化を大統領が推進しています。

- トランプ政権は中国からの輸入品に関税を課しAppleに負担を強いていましたが、2025年4月にApple製品の関税免除を実施。8月には4年間で6000億ドルを国内生産設備建設に投資する契約をAppleが締結しました。

意味合い:テック企業は最大のロビー活動支出ではない(医療企業が最大)。しかしAI大手の増大する政治的取り組みは規制の合理化と権力集中を示唆。開発者への影響は主に好意的で、州ごとの複雑な法規制の煩雑さ緩和や巨大インフラ整備推進、チップ輸出規制緩和による計算能力とハードウェア安定性の向上につながっています。しかし資金支出しない企業のビジネス環境は厳しくなる可能性があります。

所感:産業の成熟に伴い、技術的メリトクラシーから力学の影響が大きい政治的舞台への移行が起きることがあります。AI開発者は今後ビッグテックのロビイストが作る政策枠組みにますます組み込まれていくかもしれません。

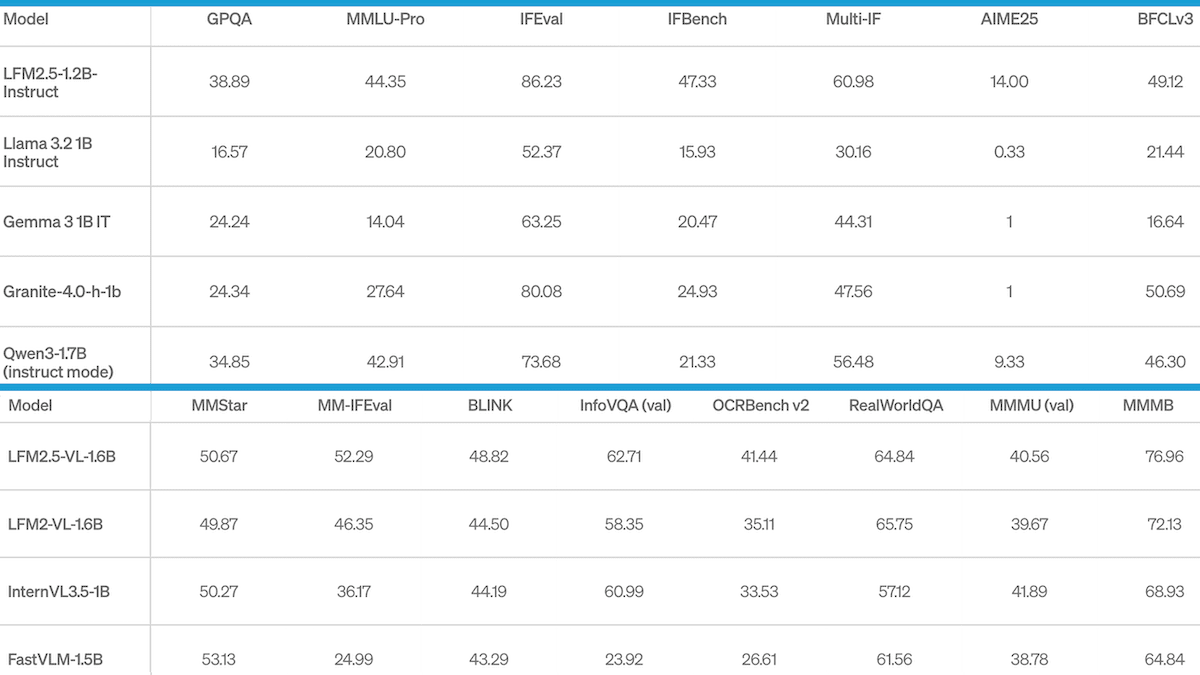

エッジでの高速推論

1〜2十億パラメータ規模の推論モデルは通常1GB以上のRAMを必要としますが、Liquid AIは900MB未満で動作し、極めて高速かつ効率的なモデルをリリースしました。

新製品:Liquid AIのLFM2.5-1.2B-Thinkingは小型デバイス向けに設計され、1月に発表された基本、命令調整版、日本語、視覚・音声対応のLFM2.5バリアントを補完します。

- 入出力:最大32,768トークンのテキスト入力・出力

- アーキテクチャ:ハイブリッドトランスフォーマー・畳み込みニューラルネット、11.7億パラメータ

- 性能:ほとんどの推論ベンチマークでQwen3-1.7Bに匹敵または上回り、推論速度は2倍、メモリ使用は少なく、出力トークン数も少ない

- 特徴:推論、ツール使用、8言語対応(英語、アラビア語、中国語、フランス語、ドイツ語、日本語、韓国語、スペイン語)

- 公開:無料のウェブUI、重みのダウンロードおよび年商1,000万ドルまでの組織向けに非商用・商用ライセンス提供

- 未公開:トレーニングデータ

仕組み:アーキテクチャはアテンション層と畳み込み層を混合し、新しいトークン入力時に隣接トークングループのみ処理して計算・メモリを削減。小型モデルは複数ドメイン学習時の忘却問題を抱えやすいが、LFM2.5-1.2B-Thinkingは段階的学習を採用。

- 事前学習は28兆トークン(旧版は10兆トークン)

- 中間学習で段階的推論データを導入し、特徴強調

- 合成推論データで教師あり微調整

- 強化学習段階で推論・数学・ツール使用に特化した25バージョンを作り、統合(統合方法は非公開)。例として、ツール使用強化後に数学版と統合し数学性能を回復。

結果:Artificial Analysisのインテリジェンスインデックス(10ベンチマークの加重平均)では、同等またはそれ以上のサイズのQwen3-1.7B Thinkingモードに匹敵。

- Liquid AIのテストではLFM2.5-1.2B-ThinkingがGPQA Diamond、IFEval、IFBench、Multi-IF、GSM8K、MATH-500、BFCLv3でQwen3-1.7B Thinkingモードを上回るか同等、MMLU-ProとAIME 2025では劣る。

- Google Gemma 3 1B IT、IBM Granite-4.0-1B、IBM Granite-4.0-H-1B、Meta Llama 3.2 1B Instructはすべて下回る。

- Liquid AIテストの推論速度ではSamsung Galaxy S25 UltraおよびAMD Ryzen AI Max+ 395でQwen3-1.7Bの約2倍速かつ約45%低メモリ使用。

課題:小型モデルは幻覚問題を抱え、LFM2.5-1.2B-Thinkingも競合モデルより劣る。

- Artificial AnalysisのAA-Omniscienceテストは幻覚を罰則化。LFM2.5-1.2B-Thinkingは-83、Qwen3-1.7B Thinkingは-78、LFM2.5-1.2B-Instructは-75。より大きなQwen3-8B Thinkingは-66、DeepSeek v3.2 Thinkingは-23。

- Liquid AIは「エージェントタスク、データ抽出、RAG向き」と推奨し、「知識集約型タスクやプログラミング用途は推奨しない」としています。

重要性:LFM2.5-1.2B-Thinkingはツール呼び出しやデータ抽出、ローカルDB問い合わせを行うオンデバイスエージェントに適しており、外部情報取得が主で詳しい知識より指示の忠実な遂行が重要です。高速処理と省メモリ設計も長い要求連鎖の処理や他アプリとの共存で利点があります。

所感:多くの開発者がモデルの知能を詰め込もうとする中、LFM2.5-1.2Bは知能、推論速度、メモリ要件のバランスをとっています。

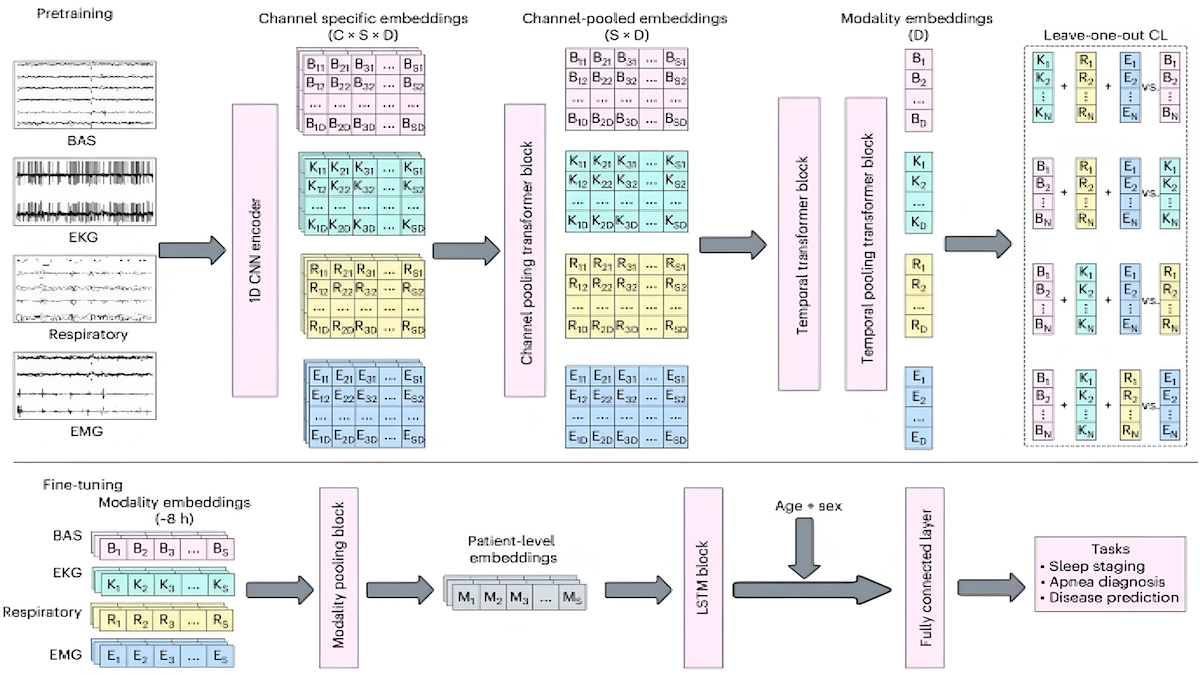

睡眠信号による疾病予測

睡眠障害は心疾患、精神疾患、多くの病気に先行することが多いです。研究者たちは睡眠研究で得たデータを用いてこれらの疾患を検出しました。

新発表:SleepFMは睡眠中のバイタルサインを元に、アルツハイマー病、パーキンソン病、前立腺癌、脳卒中、うっ血性心不全など130以上の疾患を症状出現の最大6年前に分類可能なシステムです。ラフル・タパ、マグナス・ルード・キャーはスタンフォード大学、デンマーク睡眠医学センター、デンマーク工科大学、BioSerenity、ハーバード医学部、コペンハーゲン大学の同僚と共同研究しました。

- 入出力:就寝1晩の記録入力、疾病分類出力

- 構成:畳み込みニューラルネットワークエンコーダー、トランスフォーマー、LSTM

- 性能:130以上の疾病分類が可能で、うっ血性心不全や脳卒中を6年以内に発症するかも精度高く予測

- 公開状況:重み、トレーニングコード、推論コードを商用・非商用でダウンロード可能。データセットの一部は非商用利用で公開。

仕組み:SleepFMはCNNとトランスフォーマー、LSTMで構成。トレーニングは(i)睡眠データの特徴抽出(ii)疾病分類の2段階。約585,000時間の睡眠研究記録(患者の年齢・性別・脳・心臓・呼吸系・脚筋活動信号含む)を用い、その大部分は独自データながら公開データも含みます。

- CNNとトランスフォーマーは共に学習。5分の記録を基にCNNは各信号の埋め込みを生成、トランスフォーマーが時間軸に渡る信号間の関係を捉えます。同時刻に撮られた別記録は類似埋め込みを、不一致記録には異なる埋め込みを作るよう促されます。

- LSTMは別途学習し、9時間の睡眠データと年齢・性別情報をもとに1000以上の疾患を分類。

結果:非公開テストセットに対し、事前学習なしや人口統計情報のみの単純NNと比較。

- 全14疾患カテゴリーで、真陽性率と偽陽性率のバランスを示すAUCでSleepFMは優れた結果を示しました。例えば心的外傷後ストレス障害は0.75、事前学習なしは0.64。

- 公開睡眠データセットSHHSでの心房細動予測は0.81 AUC。以前の単独目的研究は0.82 AUC。

意義:AIは微妙なパターン認識能力で医学やそれ以外の分野で大きな可能性を持ちます。今回の応用は早期の重篤疾患警告を可能とし、発症前に予防行動を促せます。

所感:この論文を読み終え、目が冴えました!