要旨: スパイキングニューラルネットワーク(SNN)は、生物学に基づく着想を得た従来の深層ネットワークの代替として現れ、イベント駆動型でエネルギー効率の高い計算を提供します。しかし、スループットはニューロン膜電位の逐次更新によって制約され続けます。多くのハードウェアアクセラレータやCompute-in-Memory(CIM)アーキテクチャは、シナプス演算(W × I)を効率的に並列化し、行列ベクトル乗算の O(1) 複雑さを達成しますが、続く状態更新ステップはすべてのニューロン膜電位をリフレッシュするために O(N) の時間を要します。この不一致は、SNN推論における遅延とエネルギーのボトルネックの支配的要因となります。この課題に対処するため、Linear Decay Leaky Integrate-and-Fire(LD-LIF)ニューロンを備えた SRAM ベースの CIM を提案し、アルゴリズムとハードウェアを協調して最適化します。アルゴリズムレベルでは、従来の指数的膜減衰を線形減衰近似に置換し、コストの高い乗算を単純な加算へ変換しますが、精度の低下は約1%程度にとどまります。アーキテクチャレベルでは、SRAMアレイ内で直接インプレース減衰を実行するインメモリ並列更新スキームを導入し、グローバルな逐次更新の必要性を排除します。ベンチマークSNNワークロードで評価したところ、提案手法は SOP エネルギー消費を 1.1x から 16.7x の削減を達成し、エネルギー効率を 15.9x から 69x 向上させ、元の減衰モデルと比較して精度の低下はごく僅かです。この研究は、(W × I) の計算を加速するだけでなく、CIM アーキテクチャ内の状態更新ダイナミクスを最適化することが、スケーラブルで低電力・リアルタイムなニューロモルフィック処理には不可欠であることを強調します。

線形減衰を用いたスパイキングニューラルネットワーク向け SRAMベースのメモリ内計算アクセラレータ

arXiv cs.AI / 2026/3/16

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- 著者らは、線形減衰を用いたリーク積分発火ニューロンを活用して、アルゴリズムとハードウェアを共同最適化する Spiking Neural Networks (SNNs) 向けの SRAM ベースの Compute-in-Memory (CIM) アクセラレータを提案する。

- 従来の指数的膜電位減衰を線形減衰に置換し、乗算を単純な加算へと変換する。精度損失は約1%程度にとどまる。

- インメモリの並列更新スキームにより、 SRAM アレイ内でインプレース減衰を実行し、グローバルな逐次膜電位更新の必要性を排除する。

- ベンチマークとなる SNN ワークロード上で、本手法は SOP エネルギーを 1.1 倍~16.7 倍削減し、全体エネルギー効率を 15.9 倍~69 倍改善し、精度損失はほとんど生じない。

関連記事

すべてのPRをセキュリティバグでレビューするAIを作った — その方法(2026)

Dev.to

[R] アイデンティティ・アンカーと権限階層の組み合わせが abliterated LLMs で 100% の拒否を実現 — システムプロンプトのみ、ファインチューニングなし

Reddit r/MachineLearning

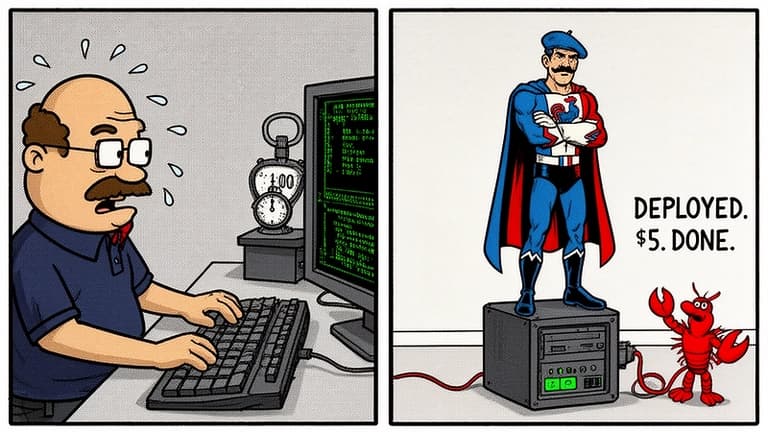

自分の OpenClaw AI エージェントを4分でデプロイ — 月額5ドルのサーバーで私の生活を動かすようになった

Dev.to

AIでポートフォリオを分析して53/100を取得 — どうやって85点以上に改善したか

Dev.to

BAMLがLLM搭載システムにエンジニアリングの規律をもたらす方法

Dev.to