OpenClaw × OllamaをMacBook 16GBで動かす - ローカルLLM入門

Zenn / 2026/3/29

💬 オピニオンDeveloper Stack & InfrastructureTools & Practical Usage

要点

- MacBook(16GB)でローカルLLMを動かすための入門手順として、OpenClawとOllamaの組み合わせを紹介しています

- ローカル環境でのLLM実行を前提に、セットアップ〜運用までを実践ベースで解説する内容です

- 生成AIをクラウドに依存せず試せる選択肢として、個人開発者でも扱いやすい構成・考え方を提示しています

- 「まず動かす」を重視し、ローカルLLM導入のハードル低減に焦点を当てています

こんにちは!ブロックチェーンエンジニアの山口夏生です。

ブロックチェーン×AI Agentで自律経済圏を創る開発組織Komlock labでCTOをしています。

ローカルLLMって難しそう...そう思っていませんか?

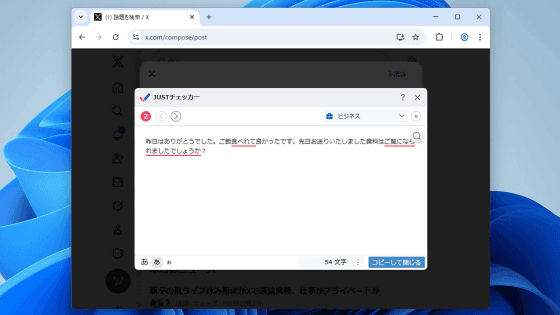

実は、たった3つのコマンドで動きます。Ollama をインストールして、モデルをプルして、OpenClaw のオンボーディングを実行するだけ。5分後には、完全にローカルで動作するAIアシスタントが手に入ります。

この記事では、「とにかく動かす」ことに特化して、OpenClaw × Ollama の環境構築から実践的な活用パターンまでを解説します。コスト削減、プライバシー保護...

この記事の続きは原文サイトでお読みいただけます。

原文を読む →