要旨: 近年の研究により、トランスフォーマーの組成的汎化は

\emph{複雑度制御}、初期化スケール、重み減衰 によって支配されており、学習を高複雑度の記憶(memorization)ではなく低複雑度の推論(reasoning)解へと誘導することが示されている。 しかし既存の解析では、複雑度制御を単一の静的なハイパーパラメータ選択として扱っており、

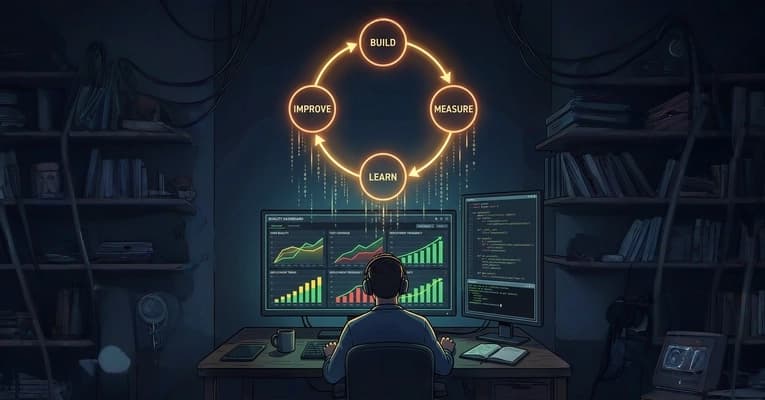

\emph{学習のいつ}この制御が実際に決定的なのかは未解決のままである。本研究では、トランスフォーマーが記憶か推論かの運命をどちらにたどるかが、学習の中で鋭く識別可能な窓(window)の中で決まることを示す。制御された組成的タスクにおいて、(i)~単一の学習ウィンドウ(学習全体の25%)に適用する重み減衰は、分布外(OOD)精度で全学習にわたる重み減衰と一致し(0.93 対 0.91)、(ii)~総正則化予算を一定に保ちつつそれを学習の中央に配置すると、早期に配置する場合よりも OOD 精度が 5{-}9\times 高くなり、(iii)~臨界窓(critical window)の境界は非常に鋭く、窓の開始をわずか 100 の最適化ステップだけずらすだけで、平均OODが偶然(0.15)から推論レジーム(0.61)へと跳ね上がること、(iv)~窓の位置は初期化スケールに体系的に依存するが、小さな初期化では推論解のための吸引領域(basin of attraction)が

\emph{縮む}ため、「小さな初期化の方が一様に良い」という一般に広まった推奨に反すること、を見いだした。さらに、臨界窓現象はタスク固有であることも示す。すなわち、モジュラ算術によるgrokkingでは、この現象は現れず、適切に調整された一定の重み減衰が、スケジュール付き重み減衰と一致する。

複雑性制御のクリティカル・ウィンドウ:トランスフォーマーは推論するか記憶するか

arXiv cs.AI / 2026/5/7

💬 オピニオンIdeas & Deep AnalysisModels & Research

要点

- 本研究は、トランスフォーマーが高複雑度の「記憶」ではなく低複雑度の「推論」へ向かう傾向が、初期化スケールや重み減衰などにより影響される複雑性制御によって左右されると述べつつ、これが訓練のいつ決定的になるのかは未解決だった点を扱います。

- 著者らは、記憶か推論かの運命が、訓練の全期間ではなく「クリティカル・ウィンドウ」と呼べる鋭い時期において決まることを示します。

- 制御された構成課題での実験では、重み減衰を訓練の25%のみ適用するだけで、全期間適用と同等のOOD(外部分布)精度(0.93 vs 0.91)を達成できること、また正則化予算の総量を一定にしたまま正則化を中盤に置くと早期に置く場合よりOOD精度が5〜9倍高くなることが示されます。

- クリティカル・ウィンドウの境界は非常に鋭敏で、開始タイミングを約100ステップだけずらすだけで平均OODが「偶然(0.15)」から「推論レジーム(0.61)」へ跳ね上がるなど、境界が急激であることが明らかになりました。

- さらに、ウィンドウ位置は初期化スケールに系統的に依存しますが、小さい初期化では推論解へ収束する“盆地”が縮小するため、「小さい初期化ほど一様に良い」という一般的推奨に反する結果となっており、また課題依存であることも示されます(モジュラー算術のgrokkingでは同現象が見られない)。