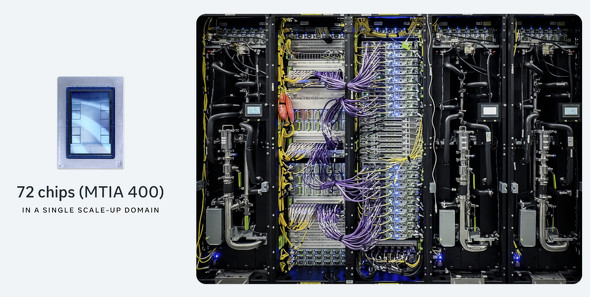

米Metaは3月11日(現地時間)、同社の大規模データセンター拡張計画の一環として、AI関連タスク向けにカスタマイズされた4つの自社製カスタムチップを公開した。自社設計のAIアクセラレータ「MTIA」(Meta Training and Inference Accelerator)シリーズの最新世代となる「MTIA 300」「MTIA 400」「MTIA 450」「MTIA 500」だ。

最初のモデルであるMTIA 300は、すでに同社サービスでのランキングや推奨モデルのトレーニング用として実運用環境で稼働している。続く3つのチップについても導入を計画しており、「MTIA 400」はテストを終えてデータセンターへの導入準備を進めているほか、MTIA 450は2027年初頭に、MTIA 500は2027年中に展開していく計画だ。

自社製チップの開発を強力に推進する狙いは、急速に進化するAIモデルに対する迅速な適応とコスト効率の最適化にあるという。汎用的なAIチップは主に大規模な生成AIの事前学習向けに作られているが、Metaは実際のサービス提供で需要が急増する推論処理を第一に最適化するアプローチをとっている。

モジュール式のチップ設計を採用することで、通常1~2年かかる開発サイクルを約6カ月へと大幅に短縮し、ハードウェアの最新技術を継続的かつ高速に自社のインフラへ統合し、コストを抑えることを可能にしているという。

チップ開発と並行して、サービス向けの膨大な計算処理を支えるための自社データセンターの大規模拡張も進めている。 直近では、既存のデータセンター5棟を換装して転用することで、12万9000基の米NVIDIA製「H100」GPUを搭載した巨大な単一AIクラスタを数カ月で構築した。現在は、複数のデータセンターや隣接施設にまたがる1ギガワット(GW)規模の次世代クラスタ「Prometheus」を建設中だ。さらに、2028年以降には最大5GWの能力を持つ超巨大クラスタ「Hyperion」を稼働させる計画も明らかにしている。

関連記事

Meta、AIエージェント向けSNS「Moltbook」を買収 創設者はMSL入り

Meta、AIエージェント向けSNS「Moltbook」を買収 創設者はMSL入り

MetaがAIエージェント専用SNS「Moltbook」を買収したとAxiosが報じた。開発チームは次世代AI部門に参画する。Metaは当面サービスを継続する方針だが、将来的には技術統合による単独サービスの終了も示唆している。 Meta、急成長の「Manus AI」を買収 自律型AIエージェント機能を統合へ

Meta、急成長の「Manus AI」を買収 自律型AIエージェント機能を統合へ

Metaは、中国発でシンガポール拠点の汎用AIエージェント開発企業Manus AIを買収すると発表した。Manusは自律型タスク遂行に強みを持ち、8カ月で売上高1億ドルを達成した急成長スタートアップだ。Metaはこの技術を「Meta AI」などの自社プロダクトに統合し、シャオ・ホンCEOらと共に、数十億人のユーザーに向けたサービスの拡充を加速させるとしている。 MetaのザッカーバーグCEO「超知能に数千億ドル投資する」 「Superintelligence Labs」に初言及

MetaのザッカーバーグCEO「超知能に数千億ドル投資する」 「Superintelligence Labs」に初言及

MetaのザッカーバーグCEOが「超知能」研究への数千億ドル規模の投資を表明。才能豊かな人材を集めて「Superintelligence Labs」を編成し、GW級の巨大なAIスパコンクラスタも複数構築する。 Meta、自社開発AIチップ「MTIA」の第2世代を発表 先代の3倍性能

Meta、自社開発AIチップ「MTIA」の第2世代を発表 先代の3倍性能

Metaは自社開発のAIチップ「MTIA」の第2世代を発表した。4つの主要モデルで先代と比較して性能が3倍向上したとしている。Facebookなどでの広告レコメンデーション機能の強化などに活用する計画。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia NEWS アンカーデスクマガジン」の登録が必要です