英Armは3月24日(米太平洋時間)、米カリフォルニア州サンフランシスコで開催したイベントで、同社初の自社開発チップ「AGI CPU」を発表した。同社は35年以上にわたる歴史の中で、これまで主にプロセッサのIPライセンス供与や「Arm Compute Subsystems(CSS)」などの設計情報の提供を行っており、自社設計のシリコン製品としてプロセッサを直接提供するのは今回が初めての試みとなる。

AGI CPUは、ソフトウェアが自律的にタスクを調整し意思決定を行う「エージェンティックAI」のインフラ需要の急拡大を背景に開発された。AIシステムが大規模かつ継続的に稼働するようになり、データセンターでの推論やワークロードのオーケストレーションが複雑化する中で、既存のx86プロセッサなどでは制約が生じるケースがあるとし、電力効率と大規模な並列処理を両立する新たなプロセッサが求められていたとArmは説明する。

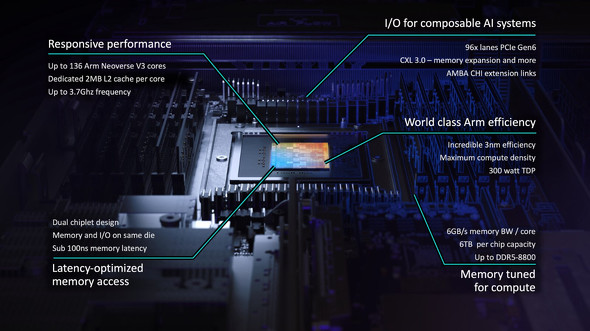

「Arm Neoverse V3」コアを最大136基搭載し、最新のx86システムと比較してラック当たり2倍以上のパフォーマンスを提供する。1OU(OpenU)サイズの高密度なブレード設計により、標準的な空冷ラックで最大8160コア、米Supermicroとの提携による液冷システムでは約4万5000コア以上を搭載でき、1ギガワット(GW)規模のデータセンター当たり最大100億ドルの設備投資削減を可能にする高い電力効率と処理能力を備える。

このチップの開発では、米Metaがリードパートナーおよび共同開発者として中核的な役割りを担った。Metaは自社の大規模なアプリインフラのパフォーマンス密度を最適化し、独自のカスタムAIアクセラレータである「MTIA」と効率的に連携させるプラットフォームとしてAGI CPUを位置付けている。さらに、MetaはこのCPU向けのボードやラックの設計を、今年後半に「Open Compute Project」(OCP)を通じてオープンソースとして公開する予定だ。

既に注文の受け付けを開始しており、台湾ASRock Rack、中国Lenovo、台湾Quanta Computer、Supermicroなどのパートナー企業を通じて早期システムが利用可能で、今年後半にはより広範な提供が開始される見込みだ。AGI CPUに対しては、米OpenAIや米Cerebras、米Cloudflare、独SAP、韓国SK Telecom、日本のアドバンテストとソシオネクストをはじめとする50社以上のテクノロジー企業が支持や導入を表明しており、次世代AIインフラの重要な中核を担うことが期待されている。

関連記事

NVIDIA、推論特化チップ「Groq 3 LPU」発表 「Vera Rubin」と組み合わせてAI性能最大35倍に

NVIDIA、推論特化チップ「Groq 3 LPU」発表 「Vera Rubin」と組み合わせてAI性能最大35倍に

米NVIDIAが、エージェンティックAI向け次世代プラットフォーム「Vera Rubin」の全容を公開した。7種の新チップがフル生産体制に入り、今年後半にパートナー各社から提供予定という。新たに推論特化の「Groq 3 LPU」を発表。Vera Rubinと組み合わせることで、Blackwellと比較してスループットが最大35倍向上するとしている。 Meta、自社製AIチップ「MTIA」新モデルと次世代データセンター構想発表

Meta、自社製AIチップ「MTIA」新モデルと次世代データセンター構想発表

Metaは、AI関連タスクに特化した自社製カスタムチップ「MTIA」シリーズの最新4モデルを公開した。推論処理の最適化とコスト削減を狙い、開発サイクルを大幅に短縮。並行して、NVIDIA製GPUを大量投入した巨大クラスタの構築や、将来的な5GW規模の超巨大データセンター「Hyperion」の稼働計画も進めている。 Microsoft、推論特化チップ「Maia 200」 競合比3倍の性能でGPT-5.2を支援

Microsoft、推論特化チップ「Maia 200」 競合比3倍の性能でGPT-5.2を支援

Microsoftは自社製AI推論チップ「Maia 200」を発表した。TSMCの3nmプロセスを採用し、演算性能はAmazonやGoogleの最新チップを凌駕するとしている。推論の価格性能比を30%改善し、OpenAIの「GPT-5.2」の提供基盤としても活用される。アイオワ州リージョンで稼働を開始しており、順次グローバルへ拡大する。 AWS、AIチップ「Trainium3」の提供開始 演算性能は先代の4.4倍に

AWS、AIチップ「Trainium3」の提供開始 演算性能は先代の4.4倍に

AWSは年次イベント「re:Invent 2025」で、3nmプロセスの新AIチップ「Trainium3」と搭載システム「Trainium3 UltraServer」を発表し、一般提供を開始した。先代比で演算性能最大4.4倍、メモリ帯域幅約4倍を達成。次世代「Trainium4」ではNVIDIAの「NVLink Fusion」をサポートし、GPUとのシームレスな連携を目指す。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia NEWS アンカーデスクマガジン」の登録が必要です