皆さま、

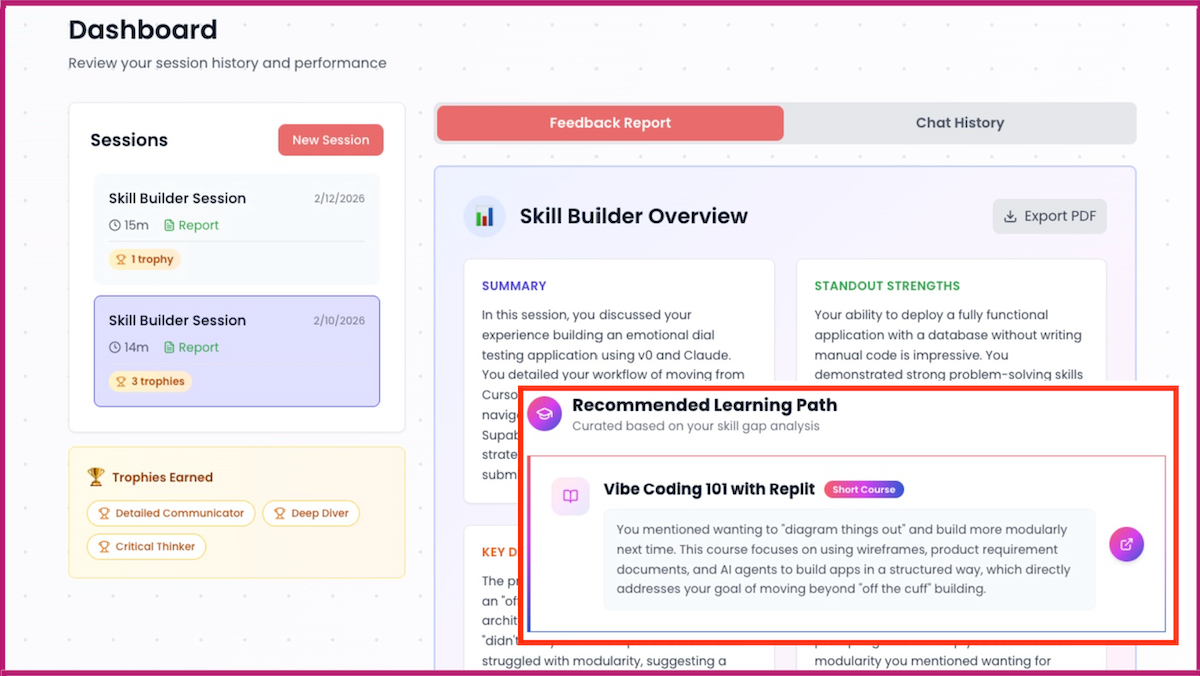

このたび、どのAI分野で強みがあり、どこに学ぶ余地があるか、次に何をすべきかを理解するのに役立つSkill Builderツールをリリースしました。ぜひ対話を試してみてください。

AIには多くの仕事の機会があります。雇用者はAIスキルを持つ人材を求めています。しかしAI技術の分野は広く、急速に変化しています。この環境をうまく進むため、信頼できるメンターとの対話が次の一歩を決めるうえで有益であると多くの人が感じています。

Skill Builderはその役割を果たします。自身のAIプロジェクトを伝えると、現在のスキル状況を分析し、次のレベルへ向けての具体的な提案をしてくれます。これはChatGPTのプロンプトを使う初心者から、複数のAI要素を組み合わせ高度な開発をする上級者まで、誰にでも役立つ設計です。

新しいスキルを学ぶとき、自分がどの位置にいるのか分かりにくいものです。知らないことが分からないからです。Skill BuilderはAIスキル向上のこの問題に対応しています。誰でも無料で使用でき、多くの人が有益な対話だったと報告しています。対話後に要約レポートと次に学ぶべき内容の推薦が表示されます。DeepLearning.AI Proメンバーはさらに詳細な個別フィードバックを得られます。

スキル確認、次に取り組むプロジェクトの決定、受講するコース選び、就職面接準備など、Skill Builderが明確な一歩を踏み出す助けになれば幸いです。

スキルを磨き続けましょう!

アンドリュー

DeepLearning.AIからのお知らせ

アプリを作るのにコーディング技術は不要です。Build with Andrewでは、アンドリュー・ングが簡単な指示でアイデアを動くウェブアプリに変えていく方法を示します。初心者に最適で、始めたい人と共有するのにも簡単です。ぜひコースをチェックしてください!

ニュース

ジェミニがリードを奪う

Googleは旗艦モデルGeminiを更新し、いくつかのベンチマークでトップに立ちながら、コストパフォーマンスも優れています。

新情報:GoogleはGemini 3.1 Pro Previewを前モデルGemini 3 Pro Previewと同価格でリリースしました。Gemini 3.1 Pro Previewは、APIで提供される3つの推論レベルとは別の高度な推論モードであるGemini 3 Deep Thinkの基盤となっています。

- 入出力:テキスト、画像、PDF、音声、ビデオ(最大100万トークン)、テキスト出力は最大64,000トークン、秒間108.6トークン

- アーキテクチャ:ミクスチャー・オブ・エキスパートトランスフォーマー

- 機能:ツール使用(Google検索、Pythonコード実行、ファイル検索、関数呼び出し)、構造化出力、調整可能な推論(低・中・高)

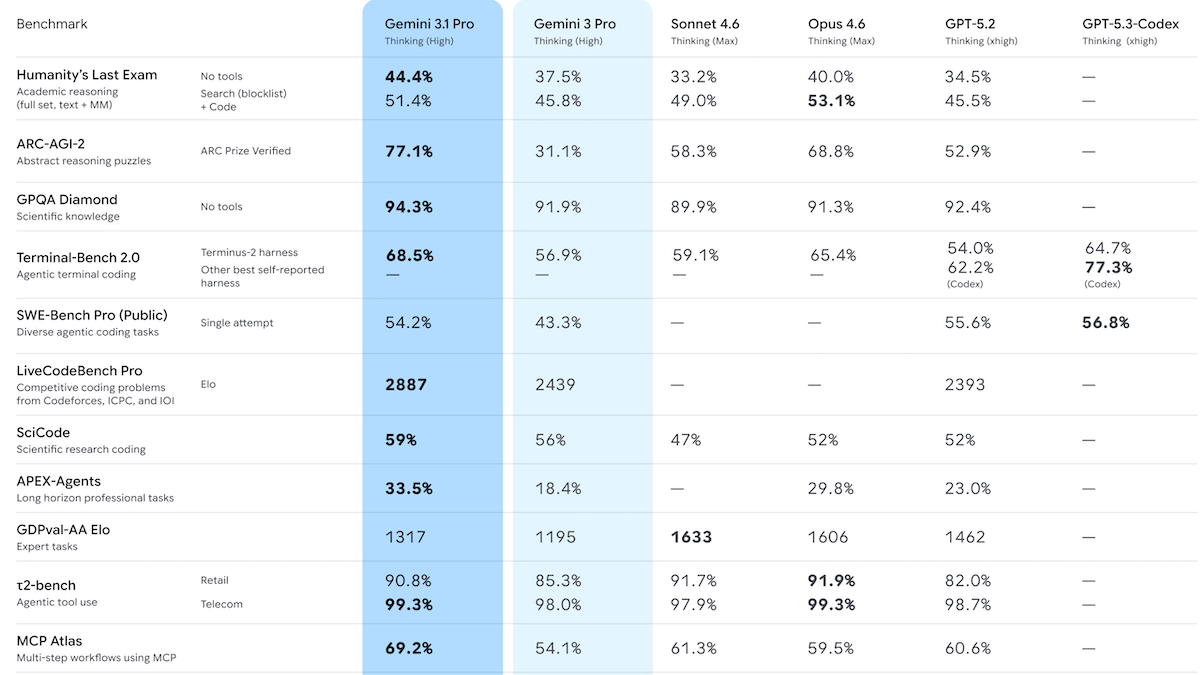

- 性能:推論レベル未指定のGemini 3.1 Pro PreviewがArtificial Analysis Intelligence Indexをトップ。ARC-AGI-2やその他多数のベンチマークで最先端を達成

- 利用・価格:Google AI ProおよびUltra加入者向けにGeminiアプリで提供。Google AI Studio、Vertex AI、Gemini CLI、Microsoft Visual StudioやGitHub CoPilotなどにも統合。APIは入力コンテキスト20万トークン未満で入力・キャッシュ・出力各100万トークンあたり2ドル・0.2ドル・12ドル、20万トークン超は4ドル・0.4ドル・18ドル(加え1時間あたり100万キャッシュトークンあたり4.5ドル)

- 知識カットオフ:2025年1月

- 非公開:パラメーター数、アーキテクチャの詳細、トレーニング方法

仕組み:詳細はほとんど公開されていません。テキスト・コード・画像・音声・動画などの大規模データやGoogleユーザーデータ、合成データで事前学習され、強化学習で多段推論や問題解決、定理証明のデータセットで微調整されています。モデルカードではGemini 3 Proのモデルカードも参照しています。

性能:Artificial Analysisの複数ベンチで最先端成績を示しましたが、一部のエージェンティックな振る舞いやユーザープリファレンスでは後れを取りました。API呼び出しはデフォルトで高推論レベルです。

- 人工解析のIntelligence Indexで、推論付きのGemini 3.1 Pro Previewは57点(892ドルコスト)で他モデルを上回り、10指標中6つでトップに立ちました。

- ただし、Arenaのコーディングランキングでは7位でした。

- GDPval-AAのエージェンティックベンチでは40%のスコアでClaude Sonnet 4.6(57%)、GLM-5(45%)に後れを取りました。

- ARC-AGI-2の視覚論理問題で77.1%を達成、前モデルの31.1%から大幅向上、Claude Opus 4.6(69.2%)を上回りました。

意義:Gemini 3.1 Proの性能向上は推論時の計算増加よりモデル品質の改良によるものと思われます。同じ程度のトークン処理でより高得点を出しているため、モデルの磨き上げがコスト増加を伴わず大幅な性能強化に繋がることを示しています。

考察:ARC-AGI-2ではGemini 3.1 Pro Preview(推論高設定推定)がDeep Thinkとほぼ接近した性能(77%対85%)ですが、コストは13分の1(0.96ドル対13.62ドル)と格段に低いです。難易度の高い問題にはDeep Thinkの利用を残すインセンティブが示されました。

グローバルAIサミットが楽観的展望を示す

第4回グローバルAIサミットは、理論的なリスクから世界中にAIの恩恵を広げる方向へ大きく舵を切りました。

新情報:AI Impact Summitは、アメリカと中国へのカウンターウェイトとして成長を目指すインドの野心を示しました。今年は2026年2月16日から20日にかけてニューデリーで政府関係者、企業リーダー、研究者が集いました。

仕組み:南半球で初めてのグローバルAIサミットとして謳われ、10万人以上が参加し100国以上の代表が来場。インド、ブラジル、フランス、スペイン、ボリビア、モーリシャス、スリランカの首脳に加え、国連事務総長アントニオ・グテーレス、ホワイトハウス科学技術政策局長マイケル・クラツィオス、Alphabetサンダー・ピチャイ、OpenAIサム・アルトマン、Anthropicダリオ・アモデイらも参加しました。ただし、中国の参加は旧正月と重なりほぼなかったと報告されています。

- 米中など85を超える国がNew Delhi Declaration on AI Impactを支持。AIを経済成長、社会貢献、グローバルな共益に活用し、狭い国家・企業利益の追求ではなく、民主化や教育促進など7原則を掲げました。

- モディ首相は「多様な層を対象とした低価格技術」の推進とインドの技術者供給、公共技術基盤、世界第3位のスタートアップエコシステムを紹介しました。

- AnthropicとOpenAIはバンガロールとムンバイにオフィスを設け、OpenAIはタタ・コンサルタンシー・サービス社のデータセンター利用やChatGPTエンタープライズを提供。GoogleはビシャカパトナムにAIハブ建設を表明し、インドと米国間などの海底ケーブル増設を約束しました。

- 人権団体はAIガバナンスの不足を批判。アムネスティはインドでのAIによる大規模監視体制を指摘し、「拘束力ある権利保護進展に無力」と断じ、デジタル安全規制を求めています。

背景:AI大手の投資で注目が集まるインドは、政府もAI関連スタートアップ支援に11億ドルを割り当て、国内22言語対応モデルを低コストで開発する施策を推進中です。

- Googleは5年間で150億ドルのAIハブ設立を約束。Microsoftは4年間で175億ドルをクラウドとAI基盤に、Amazonは2030年までに350億ドルをインド事業に投資予定。

- サミット開幕時にはAI・ハイテク分野のスタートアップ用に11億ドルの国家ベンチャーファンド増額が発表されました。

意義:AI推進は国際的努力であり、各国政府間の対話が重要です。今年は処理能力や接続性の確保、市場競争促進といった現実的課題に焦点が当たり、昨年の非現実的なSF的懸念から良い変化が見えます。楽観的雰囲気は2024年、2025年のサミットでAIの価値認識が深まった兆しである一方、急速なAI発展と民主的価値観の整合は引き続き課題です。

考察:国際リーダーが集い話し合い続けることは大切です。AIサミットが継続し、政府がすべての人に恩恵が及ぶよう努力しているのは喜ばしいことです。

エージェンティックAIに投資家動揺

大企業向けソフトウェア企業の株価が急落しました。AIが彼らの事業を脅かすとの懸念からです。今週、Anthropicが一部企業と提携し株価はやや回復傾向です。

新情報:AI支援のコーディングシステムが人気ソフトウェアを再生産する可能性に投資家が敏感になり、Microsoft、Oracle、Salesforce、Workdayなどを含むS&Pソフトウェア・サービス指数が下落。Anthropicが2026年1月12日にプロ向けエージェントClaude Coworkを導入してから2月23日までに25%の価値減となり、その後やや戻りました。

SaaSpocalypse(サースパカリプス)発生:主にWeb経由のソフトウェア定期購読サービス(SaaS)企業に影響。投資銀行Jefferiesのストラテジスト、ジェフリー・ファヴッツァ氏はこの現象を「SaaSpocalypse」と命名しました。

- Anthropicはさらに1月30日に11の白領域職種向けオープンソースプラグインを発表。これらはカレンダー管理、文書検索と取得、営業、財務分析、データ処理、法務レビュー・コンプライアンス、マーケティング、顧客サポート、プロダクト管理、生物学研究、さらに新プラグイン作成カスタマイズ機能を含みました。独立開発者も類似機能のプラグインを続々と供給。

- 4日後、S&Pソフトウェア・サービス指数は4%下落し時価総額で2,850億ドルを毀損。JPモルガンのソフトウェア指数も7%下落。LegalZoom.com株は約20%、Thompson Reutersは16%下落。

- 2月20日、Anthropicはサイバーセキュリティ向けAIツールClaude Code Securityを発表。人的審査後に脆弱性検出・修正支援を行い、これに伴いセキュリティソフト各社の株価も売られました(GoogleのCodeMenderやOpenAIのAardvarkも同様の機能を持つ)。

- 2月24日、AnthropicはDocusign、FactSet、Google Gmail、Intuit、Salesforceなどを含む提携先企業と統合を発表。Coworkプラグインはこれらのアプリケーションを直接制御する新アプローチにより、企業の利用監視や管理が容易に。これによりSaaS銘柄は反発しましたが前の下落を完全には回復できず。

背景:AI支援コーディングの進展により、AIが伝統的ソフトウェアの機能を再現・代替する可能性が示唆されています。特にエージェントがユーザーの代わりに操作を行うことで、従来のサービス固有のユーザーインターフェースへの依存(ロックイン効果)を崩すシナリオが話題です。2025年12月にCursor社のLee Robinson副社長は、自社が以前利用していたCMS「Sanity」を完全に独自構築の環境に置き換え、多額の定期費用を削減したとブログで発表。Sanity社は協業機能など機能面の差異を指摘し反論しています。

意義:投資家の動揺は過剰かもしれませんが、AIはソフトウェア市場に確実に変革をもたらしています。多くのSaaS企業は引き続き成功し、新たな機会も生まれます。大規模言語モデルは一部の競争障壁を取り除きますが、独自データや規制、ネットワーク効果、組み込みトランザクション依存のSaaSは依然として強固です。SaaSpocalypseが伝える主な教訓はソフトウェアの終焉ではなく、小規模チームが迅速に競争力ある製品を創出できるようになる一方で、持続力ある製品はLLMが扱えない資源を基盤にしている点です。

考察:SaaSは消え去るのではなくAIネイティブへと進化しています。

ローカルAIはクラウドの代わりになり得るか?

大規模言語モデルの需要増に伴いデータセンターが急増しています。研究者たちは、小型モデルをローカル端末で動かすことで負荷軽減が可能か調査しました。

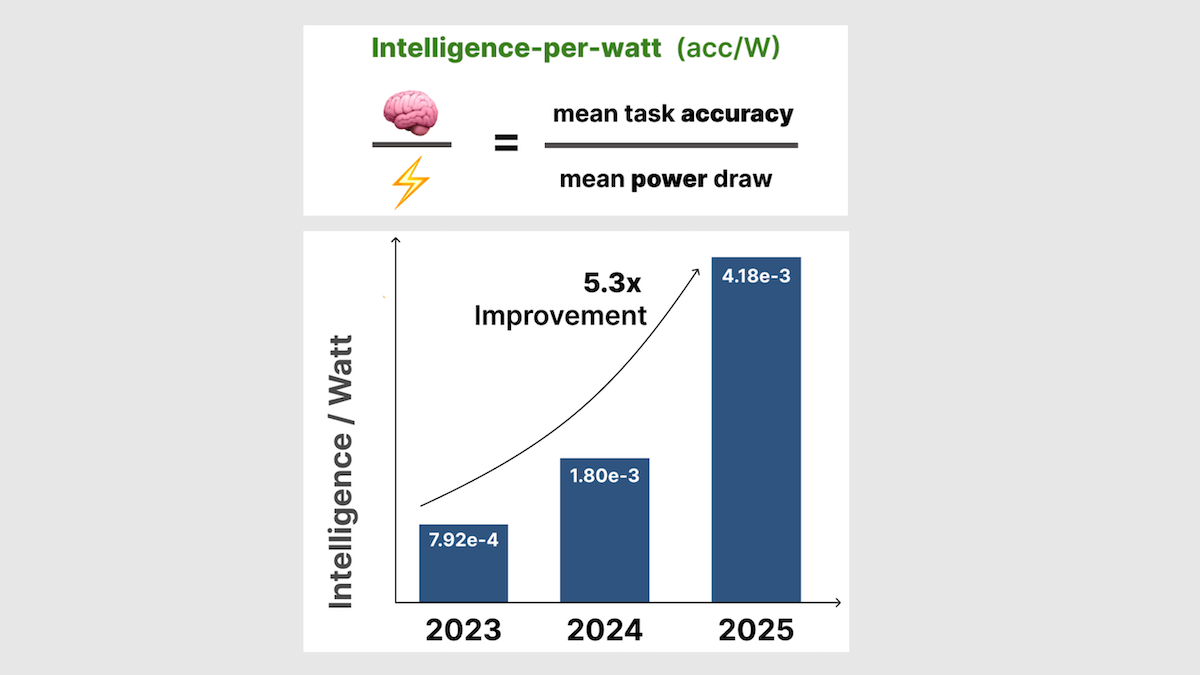

新情報:スタンフォード大学とソフトウェア開発・トレーニング提供企業Together AIのJon Saad-Falcon、Avanika Narayanらは、ノートパソコンがクラウドの代替となる可能性を「ワットあたりの知能(intelligence per watt)」指標で示しました。

主な発見:通常クラウドはユーザー単位でのエネルギー効率が高いものの、小型で高性能なモデルの開発によりローカルシステムも効率化が進んでいます。過去にメインフレームからPCへ処理が移行したように、小型モデルが精度を保ちつつ消費電力を下げれば、AI処理をクラウドから個人端末にシフト可能です。ワットあたりの知能は、特定タスクでの精度を処理に要した電力で割った値で測定。クラウドとローカルが同等の精度なら、高い指標値を持つ側が効率的と判断されます。

方法:様々なオープンウェイト大規模言語モデルをノートパソコン向けとデータセンター向けハードウェアで動作させて比較。最新モデル(Qwen3、GPT-OSS、Gemma3、IBM Granite 4.0、2025年末製)、旧モデル(Mixtral-8x7B、Llama-3.1-8B、2023~24年)、最新CPU(Apple M4 Max、Nvidia H100)、旧CPU(Nvidia Quadro RTX 6000 2018年製)を用い、実世界の会話、科学、学術分野の計100万クエリを利用。

- 精度は固定出力の正解との比較やGPT-4oによる回答評価で計測。

- 同時に消費電力を記録。

- 理想的なシステムをシミュレートし、各クエリに対し最小電力で正解を返すモデル(ローカルまたはクラウド)を選択し応答と仮定。

結果:ローカルはまだクラウドに届かないが急速に改善、小型モデルの進展により精度を保ったまま大幅な省電力が可能。もしローカルがクラウドと同等の精度を達成すれば、エネルギー消費は大幅に削減可能。

- クラウドは一般にワットあたりの知能が高い。例えばNvidia B200チップで同モデルを動かした場合、クラウドの方が1.4倍以上高い。

- ただしローカルは2023年から25年で指標が5.3倍向上、アルゴリズム改良とハードウェア性能向上が要因。

- 単発チャットや推論クエリの分析では、ローカルの小型モデルはクラウドの88.7%の正答率を達成しつつ、消費電力は大幅に低い。ハイブリッド運用想定では80%超の消費電力削減効果が示された。

補足:プライベートモデル(例:OpenAI GPT-5)の電力効率は不明ながら、精度比較は行われ、最良のローカルモデルQwen3-14BはGPT-5、Gemini-2.5-Pro、Claude Sonnet 4.5に対し11~13%低い精度でした。

意義:モデル精度向上が同消費電力で進行しており、電力と性能のトレードオフが今後低消費電力端末寄りに傾く可能性を示しています。これにより計算負荷の分散や機械知能の広範な分布が促される可能性があります。

考察:ローカルAIを巡る話題はプライバシーに焦点を当てがちですが、ワットあたり知能の上昇は経済的な議論を生む興味深い視点でもあります。