GPT-5.4 mini/nano登場!―2倍高速で無料プランも使える小型高性能モデル

【速報】OpenAIが2026年3月17日、GPT-5.4の軽量版「GPT-5.4 mini」と「GPT-5.4 nano」を発表したんだ。

どちらも前世代のGPT-5 mini/nanoを大きく上回る性能を持ってて、miniは2倍以上高速で動作する。

無料版およびGoプランのChatGPTユーザーも利用可能だよ ✨

https://openai.com/ja-JP/index/introducing-gpt-5-4-mini-and-nano/

国内メディアも一斉に報じてて、窓の杜やPC Watch、ITmedia、Gigazineなどが「小型なのに高性能」「コスト効率が良い」と評価してる。3月18日からChatGPT、API、Codexで利用可能になった。

でも、ここで僕が注目したいのは、単なる「新しいモデルが出た」という事実じゃなくて、その裏にある「小型モデルが本格的な実務の主役になり始めている」ということなんだ。

これは言い換えれば、AIの使い分けが「大は小を兼ねる」から「役割分担」へシフトしているということ。

「全部GPT-5.4で回したいけどコストが…」って悩みを持つ開発者や、無料プランでも実用的なコーディング支援を使いたい人にとって、今回の発表はかなり刺さるはず 💡

この記事を読めば、miniとnanoの違い、無料で使える範囲、実務での組み立て方まで押さえられる。

それじゃ、一緒に見ていこう 🚀

GPT-5.4 mini―2倍以上高速のコーディング支援

GPT-5.4 miniの最大の特徴は、速度と性能のバランスだね。

開発中にAIに質問したり補完を頼んだりするとき、応答が遅いと「待ってる間に別のことを考えちゃう」ってこと、あると思うんだよね。miniはGPT-5 miniと比べて動作速度が2倍以上高速化してて、コーディング作業における待ち時間がかなり短くなる。体感として、ストレスがかなり減るはずだよね。

ベンチマーク結果も魅力的で、コーディング能力を測るSWE-Bench Proでは54.4%のスコアを達成してる。前世代のGPT-5 mini(45.7%)を大きく上回り、上位モデルのGPT-5.4(57.7%)に迫る性能だ。つまり、「小型=性能が劣る」という常識が、もう当てはまらないってこと ✨

僕が個人的に驚いたのが、PC操作(Computer Use)での優位性だ。OSWorld-Verifiedベンチマークで72.1%のスコアを記録して、GPT-5.4(75.0%)にほぼ匹敵してる。スクリーンショットを解析してPC操作を行うタスクで、小型モデルがここまで高い精度を出せるようになったのは、かなり大きな進歩だと思うんだよね。

✨ どんな場面で活きるか

GPT-5.4 miniは、レイテンシが製品体験を直接左右するワークロード向けに設計されてる。

開発中に「ここ、ちょっと直して」って頼んだとき、待ち時間が長いと集中が切れちゃうよね。miniは応答性が売りで、コードの補完やリファクタリングの提案、バグの原因特定を素早く返してくれる。つまり、「待たされるストレス」をかなり減らせるんだ。

もう一つの使いどころが、サブエージェントとしての並列処理だ。大きなモデルが全体の計画や調整を担う中で、miniがファイルのレビューやコードベースの検索、資料の整理といった補助タスクを並列でこなす。一人で全部やるより、役割分担した方が効くよね、ってイメージだ 💡

あと、僕が個人的に面白いと思ったのが、スクリーンショットを見てPC操作を実行できる点だ。「この設定画面から通知をオフにして」って指示するだけで、AIが画面を解釈して操作してくれる。RPAっぽいけど、自然言語で指示できるから敷居が低いんだよね。カメラ映像からの文字認識や画像分類をリアルタイムでやるマルチモーダルアプリにも向いてる。

ツール呼び出しのベンチマーク(Tau2-Bench Telecom)では、nanoがminiと同等の精度を出してるって報告もある。つまり、単純なタスクに絞れば、nanoでも十分な精度が期待できるってことだよ。

GPT-5.4 nano―最速・最安の軽量モデル

GPT-5.4 nanoは、GPT-5.4系列で「最小かつ最速」のモデルだね。

「大量のタスクを並列で回したい」「でもコストは抑えたい」ってニーズに応えるのがnanoの役割だ。速度とコストが最も重視されるワークロード向けに、徹底的に最適化されてる。

性能面では、前世代のGPT-5 nanoから大きく向上してて、分類やデータ抽出、ランキングといった比較的単純なタスクを処理するのに適してる。例えば、顧客からの問い合わせメールをカテゴリ分けして担当部署に振り分けるとか、大量のテキストから特定の情報を抽出するとか。そういう「単純だけど回数が多い」処理を、nanoに任せると効くんだよね。コーディングのサブエージェントとしても、定型文の挿入や既存コードの検索といった補助タスクに向いてる ✨

API利用料金は、入力100万トークンあたり0.20ドル(約32円)、出力100万トークンあたり1.25ドル(約198円)。miniのさらに約4分の1のコストだ。バックエンドで単純タスクを大量に回すような構成なら、このコストパフォーマンスはかなり効いてくるはず。

なお、nanoはAPIでのみ利用可能で、ChatGPTのインターフェースからは直接使えない。主に開発者がプロダクトの裏側で利用することを想定した設計なんだよね。

無料プランでも利用可能

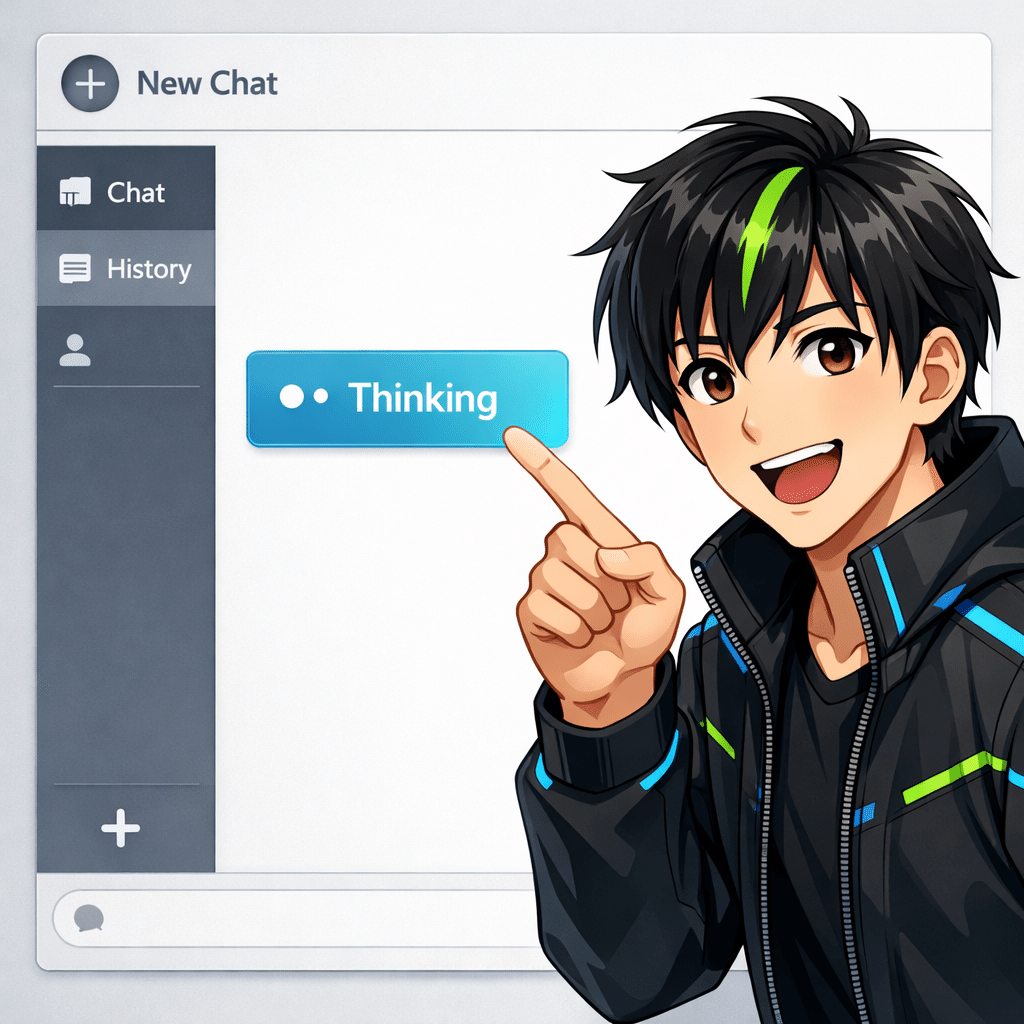

GPT-5.4 miniの大きな特徴の一つは、ChatGPTの無料版でも利用できる点だね 🚀

これまで高度な推論モデルは有料プラン限定だったけど、今回から無料版やGoプランのユーザーも「+」メニューから「Thinking」を選べばminiが使える。学生や個人開発者にとって、かなりハードルが下がるニュースだと思うんだよね。有料のPlusやTeam、Enterpriseを使っている人も、GPT-5.4 Thinkingのレート制限に達したときは自動でminiにフォールバックするから、途中で止まらずに作業を続けられる。

APIやCodexで使う場合、コンテキストウィンドウは40万トークン(約30万文字相当)。入力は100万トークンあたり0.75ドル(約120円)、出力は4.50ドル(約715円)。テキストだけでなく画像入力、ツール利用、関数呼び出し、Web検索、ファイル検索、PC操作、スキルにも対応してる。CodexならGPT-5.4の割り当て量の30%で済むから、比較的シンプルなコーディングタスクを回すときは、コストをおよそ3分の1に抑えられるんだ 💡

ベンチマークで見る性能比較

GPT-5.4 miniとnanoの性能を、具体的なベンチマーク結果で見ていこう。

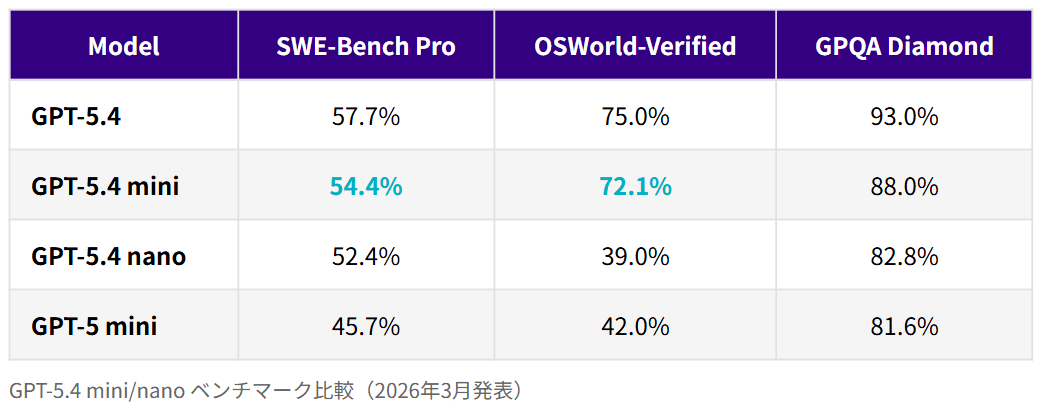

コーディング能力を測るSWE-Bench Proでは、miniが54.4%、nanoが52.4%と、前世代のGPT-5 mini(45.7%)を大きく上回ってる。上位モデルのGPT-5.4(57.7%)に迫る性能だね。PC操作(Computer Use)を測るOSWorld-Verifiedでは、miniが72.1%でGPT-5.4(75.0%)にほぼ匹敵する一方、nanoは39.0%と苦戦してる。これは、nanoが単純タスク特化の設計だからこその結果で、用途が違うんだよね。知能ベンチマークのGPQA Diamondでは、miniとnanoの両方が前世代を上回っている。

miniがコーディングとPC操作の両方で上位モデルに迫ってるのに対し、nanoはOSWorld-Verifiedでは弱い。でも、単純な分類やデータ抽出ならnanoで十分だし、コストはminiの約4分の1。用途に応じて選べば、かなり効率的な構成が組めるはずだね。

数値の一覧は下の表で確認してほしい。どのモデルがどんなタスクに向いているか、一目で分かるはず ✨

実務での活用シーン

🚀 サブエージェント構成で効率を上げる

「全部GPT-5.4で回したいけど、コストが気になる」って人に刺さるのが、サブエージェント構成だと思うんだよね。

大規模モデル(GPT-5.4)が計画を立てて調整し、最終判断を下す。その一方で、miniがコードベースの検索やファイルレビュー、補足資料の整理といった補助タスクを並列でこなしていく。司令塔と実行部隊が分かれてるイメージだ。すべてを1つのモデルに任せるより、役割分担した方がコストも速度も効く。

OpenAIの顧客事例でも、Codexでminiのサブエージェントを導入した結果、タスク完了時間の短縮とコスト削減が報告されてる。具体的には、特定箇所の編集やコードベースのナビゲーション、フロントエンド生成、デバッグの反復といった作業で、miniの並列処理能力が効いてるんだよね。

💡 コーディングの現場でどこに使うか

特定箇所の編集、数千ファイルに及ぶコードベースのナビゲーション、フロントエンドのプロトタイプ生成、デバッグの反復……こうした「レイテンシが効く作業」で、miniの高速性がそのまま体感できる。待ち時間が短いと、試行錯誤のサイクルが速く回るから、開発のリズムが良くなるんだよね。

あなたのプロジェクトで「ここは重い処理」「ここは軽い処理」って線引きできそうなら、miniとnanoの役割分担を検討してみる価値があると思う 🎯

もう少し時間があるなら、この話をさらに面白くする別の視点も覗いてみないかい?

🔮 Miccellの裏読み:小型モデルが「主役」になる日

今回の発表で見逃しがちなのは、「小型モデル=おまけ」という前提が崩れ始めていることなんだよね。

これまでは「重い処理は大きいモデル、軽い処理は小さいモデル」という棲み分けだった。小型モデルは補助的な存在で、本番の難しいタスクは大きいモデルに任せる、って考え方が主流だったと思うんだ。

でも、miniがOSWorld-VerifiedでGPT-5.4に迫る72.1%を叩き出してる時点で、もう「おまけ」じゃないんだ。PC操作という、かなり複雑なタスクを、小型モデルがこなせるようになった。これは単なる性能向上じゃなくて、「小型モデルが担える役割の範囲」が広がったってことだよね。

OpenAIの意図を読むと、「大規模モデルは思考役、小型モデルは実行役」という役割分担を、製品レベルで推し進めてるように見える。Codexで「GPT-5.4の30%のコストで済む」って謳ってるのも、その設計思想の表れだと思う 💡

未来を予測するなら、今後は「どのモデルを使うか」より「どう組み合わせるか」が問われる時代になる。miniとnanoの登場は、その入り口に立ったということだね ✨

🔧 製作ノート:一次ソースを追いかけた

今回、僕は公式発表と国内メディア4社の記事を突き合わせてみたんだ。

窓の杜、PC Watch、ITmedia、Gigazineと、それぞれ切り口が少しずつ違っていて面白かったよ。

特に「無料で使える」という点は、どの媒体も大きく扱ってた。やっぱり、ハードルが下がるニュースは刺さるんだな、って再確認した 💦

ベンチマークの数値は公式サイトが一番整理されていて、比較表を作るのに助かった。

nanoがOSWorld-VerifiedでGPT-5 miniに負けてる件、最初は「え、なんで?」って思ったけど、単純タスク特化の設計だからこその結果だと理解した。用途が違うんだよね。長文読解のベンチマークでは、miniがGPT-5 miniとほぼ同等かやや向上してるって報告もあって、タスクによって強みが違うのが面白いな、と思った。マジで、小型モデルの進化がすごい 💡

小型モデルの台頭が変える、AIの使い方

GPT-5.4 miniとnanoの発表は、「小型=性能が劣る」という常識が覆りつつあることを示してる。

無料プランでも高性能モデルが使えるようになったことで、AIのハードルはさらに下がったんだよね。学生や個人開発者でも、コストを気にせず実用的なコーディング支援を試せる環境が整いつつある。

実務では、大規模モデルで思考し、小型モデルで実行する「役割分担」が標準になりそうだ。コストやレイテンシの壁が下がることで、これまで以上に様々なプロダクトやサービスにAIが組み込まれていくだろうね。

あなたのプロジェクトでは、miniとnanoをどう組み込めそうだろう? まずは無料のThinkingから試してみるのもありだと思う 🤔

Miccell - 小型でも主役になれる時代が来た ✨