Learning to Present: Inverse Specification Rewards for Agentic Slide Generation

arXiv cs.AI / 3/18/2026

📰 NewsDeveloper Stack & InfrastructureTools & Practical UsageModels & Research

Key Points

- Introduces SlideRL, an OpenEnv-compatible reinforcement learning environment enabling LLM agents to research topics, plan content, and generate professional HTML slide presentations using tool use.

- Proposes a multi-component reward system including an inverse specification reward that measures how faithfully generated slides convey their intended purpose by having an LLM recover the original specification.

- Demonstrates fine-tuning of Qwen2.5-Coder-7B via GRPO on prompts from expert demonstrations, updating only 0.5% of parameters, achieving 91.2% of Claude Opus 4.6's quality and a 33.1% improvement over the base model.

- Provides SlideRL as an open-source resource with 288 multi-turn rollout trajectories across six models, plus links to dataset and code.

Related Articles

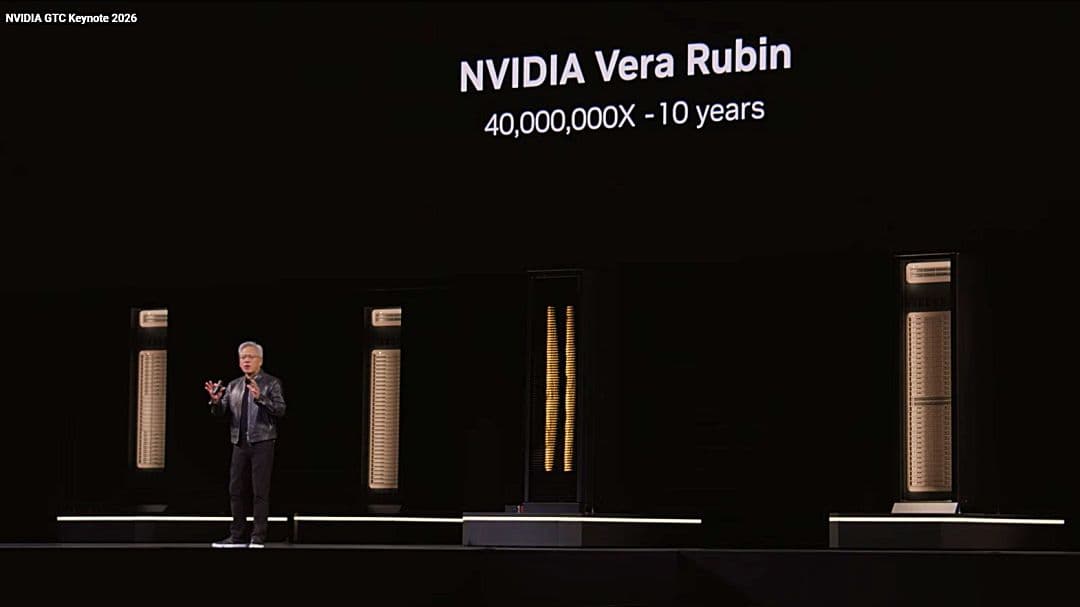

NVIDIA、GTC 2026で次世代AI基盤を発表 「Vera Rubin」を軸にエージェント・ゲーム・宇宙領域へ展開のサムネイル画像

Ledge.ai

1Password、AIエージェントのアクセス制御を統合管理する「Unified Access」発表 人間・マシン・AIの資格情報を一元統制のサムネイル画像

Ledge.ai

『モンドーモンドー』|夏目龍頭流闇文学|AI画像生成|自由詩|散文詩|ホラー|ダークファンタジー|深淵図書館

note

報告:LLMにおける「自己言及的再帰」と「ステートフル・エミュレーション」の観測

note

「お金、見直したいけどどこから?」AIが改善ヒントを教えてくれる、公式プロンプトを公開

note