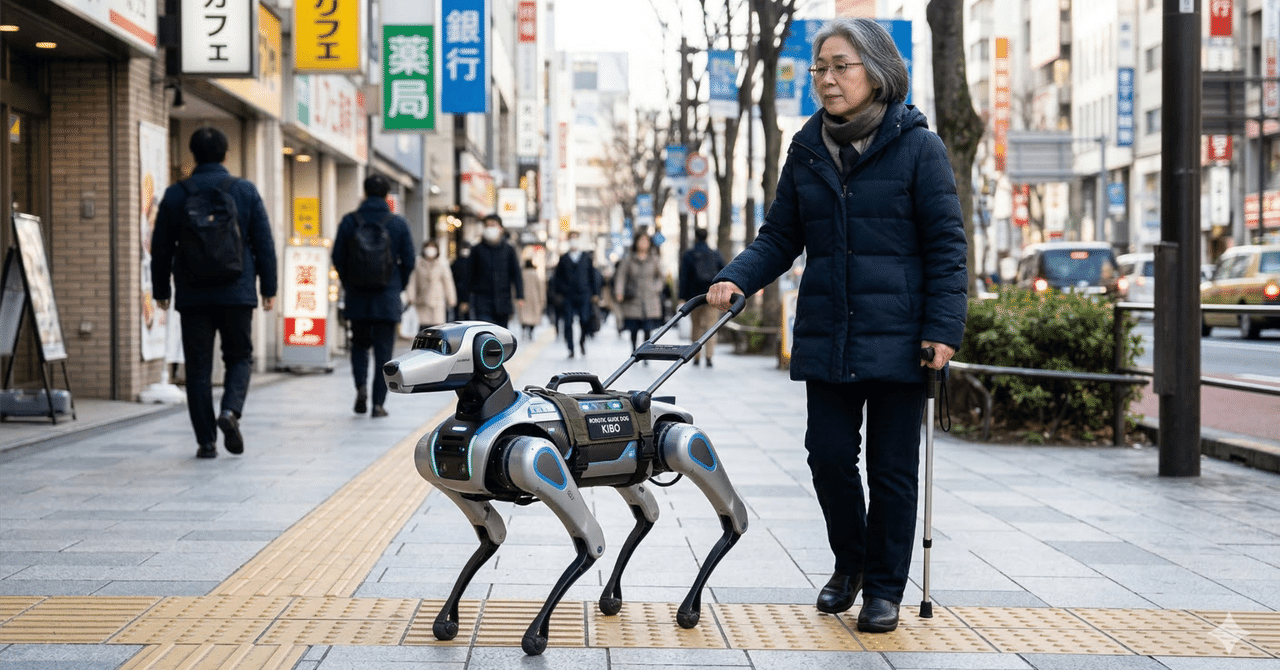

人の言葉を喋る「ロボット盲導犬」は、視覚障害者の方々の自立支援の一助となるか

視覚障害者の方々の移動の支援において盲導犬が活躍していますが、盲導犬の育成には膨大な時間とコストがかかり、利用を希望するすべての人に十分行き渡っているとはいえません。

そこで今回の研究では、「ロボット盲導犬」に自然言語で説明する能力を持たせ、単に視覚障害者の方を目的地へ導くだけでなく、一緒に会話しながら移動に関する意思決定をする仕組みが提案されています。

ロボット盲導犬のしくみ

Hayamizu, Y et al. (2026). From woofs to words: Towards intelligent robotic guide dogs with verbal communication.

1. 計画の言語化(plan verbalization)

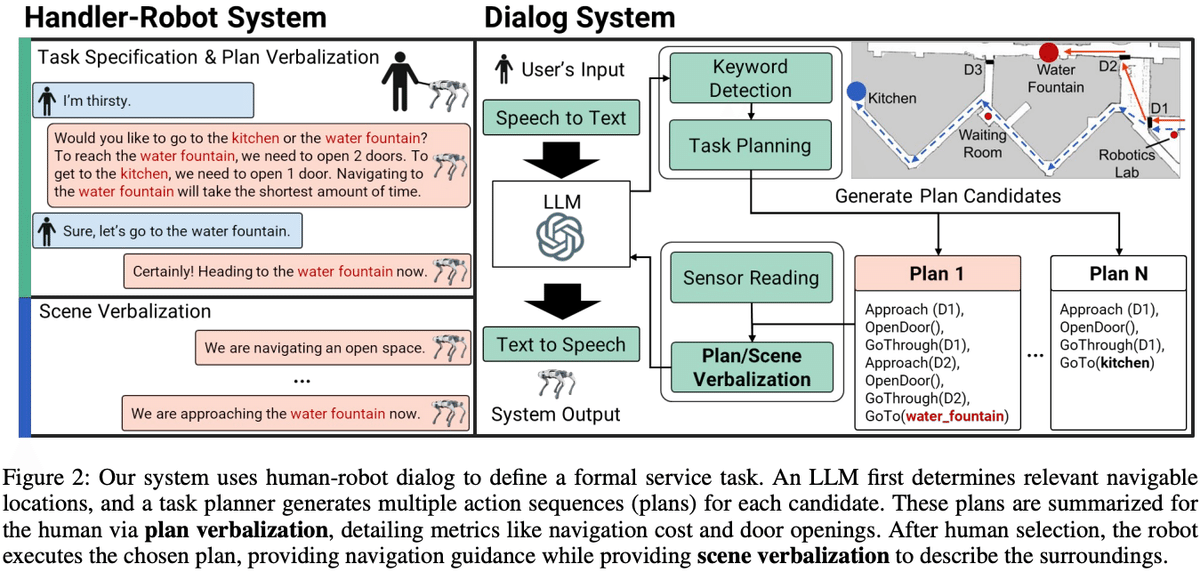

著者らが提案するロボット盲導犬は、人の言葉を聞いて、意味を考えて、進み方を決めて、それをまた言葉で説明するしくみになっています。

例えば、利用者が「喉が渇いた」と発言した場合を考えてみましょう。

まず、システムはその音声を文字に変え、大規模言語モデル(以下、LLM)が「この人は何をしたいのか」を考える

喉が渇いたと言われた場合は「給水機に行く」「キッチンに行く」といった選択肢が挙がるが、それと同時に「給水機は近い」「キッチンは少し遠い」「途中でドアを開ける必要がある」といった、選択肢ごとの違いを調べる

調べた内容を踏まえて、ロボットは「給水機なら近いです」「キッチンは少し遠いですが行けます」といった形で、それぞれの選択肢の違いを言葉で説明する

利用者はその説明を聞いて、自分で行き先を選ぶ

ロボットが案内する

つまり、このシステムは命令どおりに動くだけではなく、利用者が選びやすいように候補と理由を説明したうえで利用者の意思を反映し、案内するように作られています。

2. 場面の言語化(scene verbalization)

場面の言語化と言われると分かりづらいですが、移動中に「いま何が起きているか」をロボットが言葉で案内してくれるということです。

場面の言語化が実現できると、ロボット盲導犬は「今、長い廊下を進んでいます」「ドアに近づいています」「目的地につきました」のように、リアルタイムでナビをしてくれるようになります。

その結果、利用者は頭の中で現在の状況を想像しやすくなり、安心して移動できるようになると考えられます。

視覚障害を持つ方からの評価

1. 参加者と評価項目

Hayamizu, Y et al. (2026). From woofs to words: Towards intelligent robotic guide dogs with verbal communication.

Hayamizu, Y et al. (2026). From woofs to words: Towards intelligent robotic guide dogs with verbal communication.

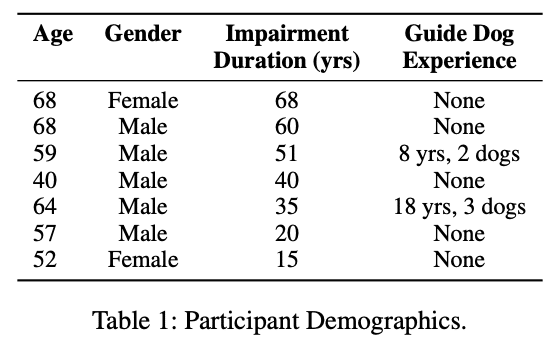

今回の研究では視覚障害者7名を募集し、そのうち要件外の1名を除外した6名を解析対象としています。年齢は40〜68歳で、2名は盲導犬の利用経験がありました。

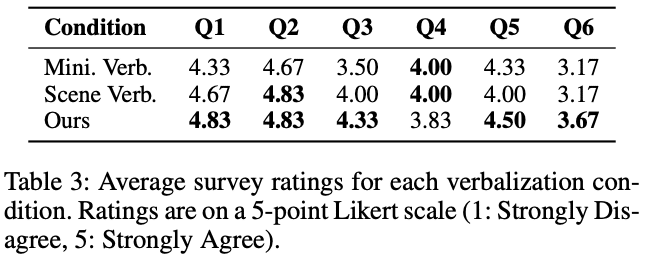

比較対象は、最低限の発話のみを行う「Minimum Verbalization」、周囲の説明のみの「Scene Verbalization」、そして計画の説明と周囲の説明の両方を行う「Scene + Plan(Ours)」の3種類です。

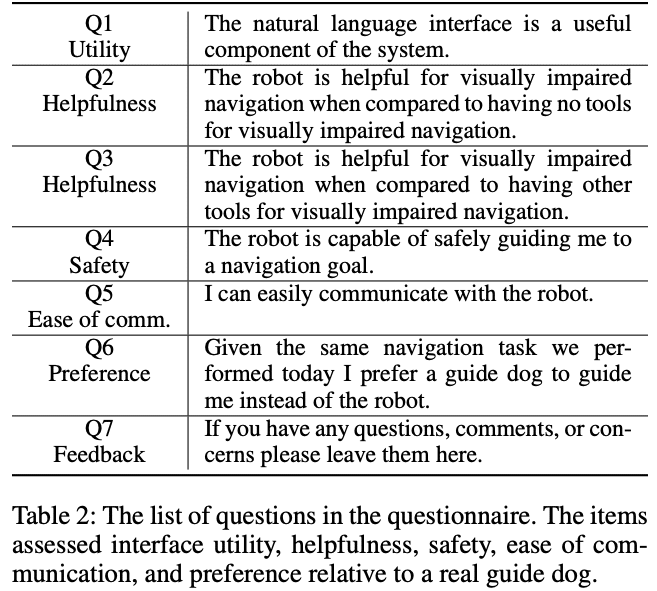

そして、参加者は Table 2 に提示されているQ1〜Q7のアンケートに、1〜5の5段階で評価をつけます(Q7は自由記述)。

Q1:有用なツールだったか

Q2:支援がないときと比較して、役に立ったか

Q3:他のツールと比較して、役に立ったか

Q4:安全性が担保されていたか

Q5:コミュニケーションが取りやすかったか

Q6:盲導犬より、ロボット盲導犬の方を好むか

Q7:フィードバック(自由記述)

2. 結果

Hayamizu, Y et al. (2026). From woofs to words: Towards intelligent robotic guide dogs with verbal communication.

著者らは、Scene + Plan(Ours)が「自然言語インターフェースの有用性」「コミュニケーションのしやすさ」「盲導犬と比較したときの好み」において高評価だったと述べています。

一方、安全性評価(Q4)は 3.83 で、他条件の 4.00 と比較するとやや低くなっています。著者らは、参加者がロボット歩行に不慣れであることが一因かもしれないとフィードバックから考察しています。

シミュレーションの評価

1. シミュレーションの概要

Hayamizu, Y et al. (2026). From woofs to words: Towards intelligent robotic guide dogs with verbal communication.

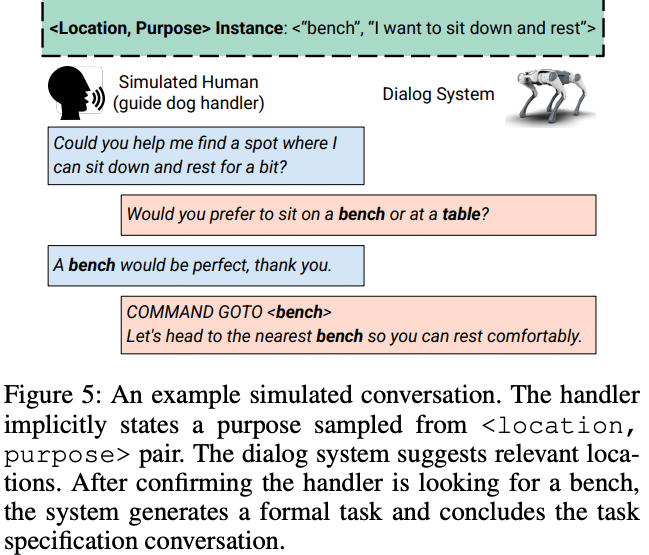

16名の大学生から、視覚障害者がナビによる支援を求める場面を想定した<location, purpose>のペアを収集し、曖昧な依頼を含む77件のサンプルを作成し、「何か飲みたい」「座って休みたい」といった要求に対して、ロボットのシステムがどれだけ適切に目的地を特定できるかを評価しました。

(ちなみに、視覚障害者役はGPT-4でシミュレートされています)

例えば Figure 5 は、<"ベンチ", "座って休みたい">のペアの例です。ロボット側が「ベンチかテーブル付きの席のどちらが良いですか?」と提案し、最終的にベンチに案内しています。

2. シミュレーションの結果

論文中で、著者らの提案している手法は94.8%の精度を記録し、会話も長くなりすぎないようにバランスが取れていたと述べられています。

また、音声認識を活用するうえでノイズや雑音の影響は避けられませんが、ノイズや雑音が発生するような環境においても精度の低下は5.2%にとどまっていました。

また、計画に関する情報を説明に加えた場合は、計画の情報を加えない場合と比較して会話の長さは増えたものの、移動にかかる負担は低下し、移動に必要な時間も短縮されました。

つまり、説明を少し長くすることによって、全体としては効率が上がったと解釈できます。

注意点

実際の視覚障害者を対象とした研究では、解析対象は6名と少ないことに注意が必要です。

実験中のロボットの移動は熟練オペレータによる遠隔操作だったため、自律的にロボットに動いてもらった場合は、今回とは異なる結果となる可能性があります。

自らの意思で選択できることの重要性

盲導犬は、視覚障害者の方々の安全な歩行をサポートし、目の前の障害物を避けたり、段差や角の場所を教えたりする役割を担っています。しかし、盲導犬は犬であるがゆえ、当たり前ですが人間の言葉を喋ることはできません。

一方、今回の研究で提案されているロボット盲導犬は自然言語で会話することができます。ゆえに、利用者にとって適切な選択肢を提示し、その意味を説明し、最終的な選択を利用者に委ねることが可能です。

これは私個人の意見ですが、ハンディキャップを背負った方々の支援を考えるとき、可能な限り相手の主体性を損なわずに支援できる仕組みを整えることが重要だと考えています。

今回の研究の技術がより広く普及していけば、盲導犬の不足という課題の解決につながるだけでなく、利用者が自らの意思で選択できる形の支援が実現できるかもしれません。

現在、生成AIは主に情報収集やコンテンツの生成、あるいは相談相手として活用されるケースが多いと思われます。しかし今回の研究で、ロボット盲導犬に搭載された生成AIが、視覚障害を持つ方々の自立支援のパートナーとして活用できるという新たな可能性が示唆されました。

「ロボットと一緒に考える」という体験が、視覚障害を持つ方々の生活に新しい安心をもたらしてくれる時代が、やってくるかもしれません。

最後までお読みいただき、ありがとうございました。

Webサイト「薬剤師のためのAIノート」も、是非ご覧ください。

記事に関する内容以外のお問い合わせは、以下のフォームよりお願いいたします。

また、書籍「超知能時代の調剤薬局」発売中です。

Kindle Unlimited会員の方は無料で読むことができます。