Fuel Gauge: Estimating Chain-of-Thought Length Ahead of Time in Large Multimodal Models

arXiv cs.CV / 3/12/2026

📰 NewsDeveloper Stack & InfrastructureTools & Practical UsageModels & Research

Key Points

- The paper introduces Fuel Gauge, a method to predict the length of the Chain-of-Thought ahead of time in large multimodal models by extracting a hidden 'fuel' signal.

- It targets memory fragmentation and efficiency in LMM serving by enabling predictive KV cache allocation and by modulating CoT length to balance under- and over-thinking.

- Extensive experiments across text-only, image-text, and video-text benchmarks show reduced CoT length prediction error and a 13.37x reduction in memory allocation frequency on the GPQA-Diamond benchmark.

- The results demonstrate generalizability and practical value for real-world LMM deployment, with potential improvements in both resource use and reasoning quality.

Related Articles

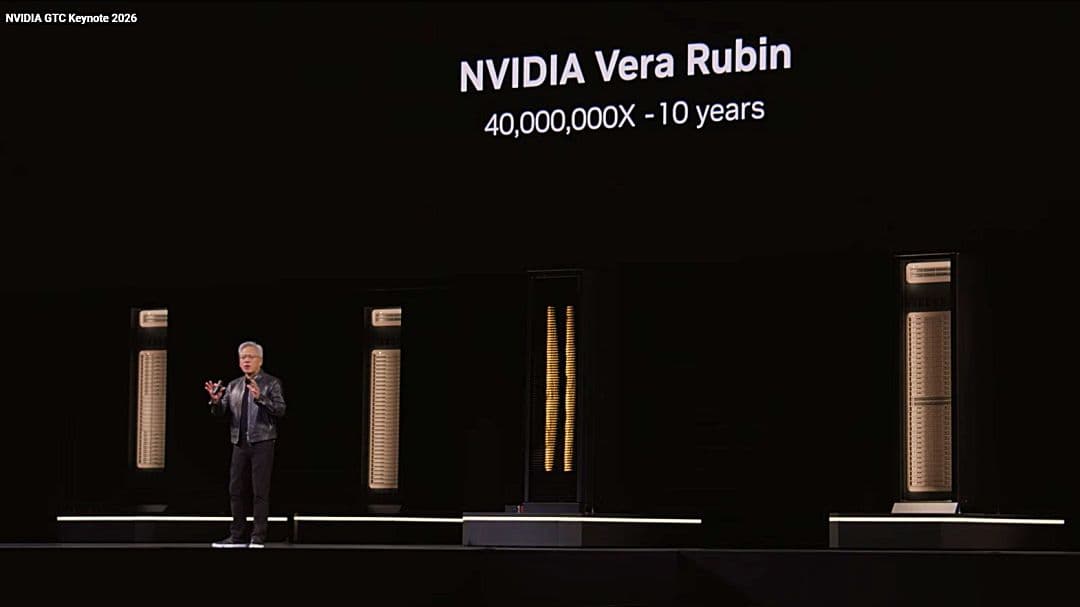

NVIDIA、GTC 2026で次世代AI基盤を発表 「Vera Rubin」を軸にエージェント・ゲーム・宇宙領域へ展開のサムネイル画像

Ledge.ai

1Password、AIエージェントのアクセス制御を統合管理する「Unified Access」発表 人間・マシン・AIの資格情報を一元統制のサムネイル画像

Ledge.ai

『モンドーモンドー』|夏目龍頭流闇文学|AI画像生成|自由詩|散文詩|ホラー|ダークファンタジー|深淵図書館

note

報告:LLMにおける「自己言及的再帰」と「ステートフル・エミュレーション」の観測

note

「お金、見直したいけどどこから?」AIが改善ヒントを教えてくれる、公式プロンプトを公開

note