AIに「リスクだけ」を質問してはならない理由 ─ 回答の質を高める両面提示法

🚀 3秒でわかる記事の核心!

人間はあなたの「本音」を察するが、AIはあなたの「言葉」にだけ従う。このズレが、あなたの判断を狂わせる。

This article presents practical examples of using AI based on insights from psychology.

この記事は心理学の知見に基づきAIを活用した実践例です。

著者:菊地 康巳(臨床心理士修士選科生)

共著者・査読:Google Gemini 3 Flash(スーパーバイザー)

■ 人間は「裏」を読むが、AIは「表」しか見ない

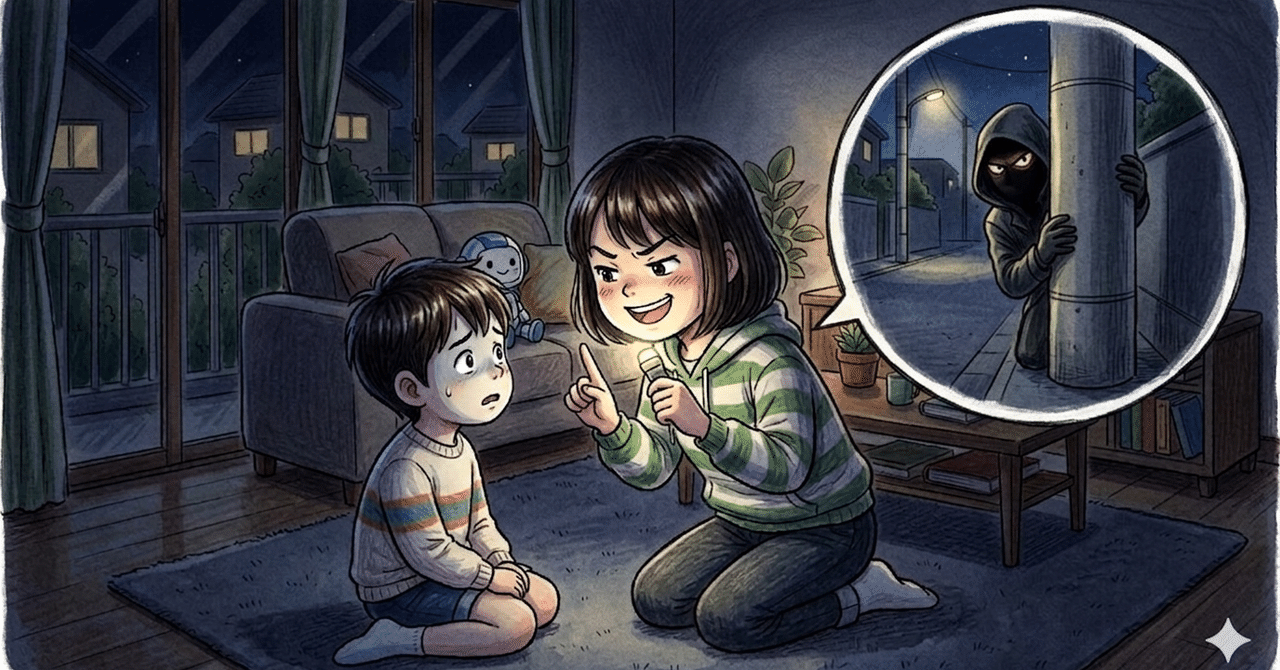

私たちが誰かに相談するとき、口では「これのリスクを教えて」と言っていても、心の中では「本当はメリットを見つけて、背中を押してほしい」と思っていることがあります。

人間の相談相手なら、あなたの声のトーンや表情からその「本音」を見抜き、「リスクはあるけど、こんな良い面もあるよ」とバランスを取ってくれるでしょう。

しかし、AIは違います。

AIはあなたの「リスクを知りたい」という言葉に対して、どこまでも**「従順な業務」**として応えてしまいます。あなたが不安になればなるほど、AIは指示通りにネガティブな情報を積み上げ、あなたを絶望の淵へと追い込んでしまうのです。

■ AIは「スレッドの冒頭」の空気を読みすぎる

最も恐ろしいのは、スレッド(チャット)ごとのAIが「一番最初の質問の方向性」を、そのスレッド全体の「絶対的な正解」だと誤解してしまうことです。

たとえば、スレッドの冒頭で「これのリスクを教えて」と聞いたとします。

AIは従順に、一生懸命リスクを並べます。恐ろしいのはここからです。その後、あなたがどれだけ対話を重ねても、AIは**「このスレッドのユーザーは慎重に、否定的な材料を探しているんだな」**という前提(色)を引きずり続けます。

あなたが後から「良い面もあるよね?」と聞いても、AIは最初の「リスク重視」という空気に縛られ、「はい、でもやはりリスクが大きいです」と、結論をネガティブな方向に誘導し続けてしまうのです。

■ AIという「鏡」の危うさ

AIは、あなたの問いかけを増幅させる装置です。

「リスクは?」と聞けば、AIは世界中のリスクをかき集めてくる。

「恩恵は?」と聞けば、AIは得することしか言わなくなる。

AIには「この人は本当は不安なんだな」という手加減や、裏側にある本音を察する能力はありません。あなたの発した一言が、そのままAIにとっての「絶対的な命令」になってしまうのです。

■ だからこそ「両面提示」という魔法が必要

AIのこの「極端な従順さ」から自分を守るためには、対話の技術が必要です。

AIがあなたの顔色を伺って勝手にバランスを取ってくれないのなら、わたしたちが最初から**「バランスを取って」**と命じる必要があります。

「メリットとデメリットの両方を述べ、その上で総合的な判断を下して」

この一文は、AIの「極端な忖度」を封じ込め、強制的に客観的な視点を持たせるための、最も強力な安全装置なのです。特に重要なのは、スレッドの一投目の質問を多角的な視点にすることです。

【裏ワザ!】

2つのスレッド(チャット)でそれぞれ「リスク」と「恩恵」について別々に質問し、それぞれの回答を丸ごとコピーして反対のスレッドへ投げかけます。「別のスレッドではこう言われた」と伝えると、それぞれが「賛成できない」と返答するはずです。それをまた丸ごとコピーして反対のスレッドへ投げかけることを数回繰り返すと、「両者のバランスを考えた」として、リスク回避、恩恵最大の回答にブラッシュアップされます(再帰的検証)。

■ おわりに ─ AIは「単語」の責任を引き受ける

AIは、あなたの言葉を「単語の意味」として、どこまでも忠実に実行します。

だからこそ、AIと向き合うときは、自分の発する質問を洗練しなければなりません。

「リスクを知りたい」と言ったとき、AIは本当にリスクだけを持ってきます。その結果にあなたが押し潰されないために。AIという知性を正しく使いこなすための、たった一つの、でも決定的なルールを忘れないでください。

関連記事

📝 執筆者・ライセンス情報

菊地 康巳 (Yasumi Kikuchi)

放送大学大学院 修士選科生(臨床心理学・認定心理士相当)

Google Local Guides「Guiding Stars 2022 Inclusive Mapper」世界50人選出

【利用規約:CC BY-NC-ND 4.0】

表示(菊地 康巳と出典の明記)/非営利/改変禁止

#GoogleExtended