Kimi K2.6 Benchmark: Results vs GPT-5.4, Claude, Gemini, and K2.5

Zenn / 4/24/2026

💬 OpinionSignals & Early TrendsModels & Research

Key Points

- Kimi K2.6のベンチマーク結果を、GPT-5.4・Claude・Gemini・K2.5など既存モデルと比較した内容で、性能差の観点が提示されている。

- 「K2.6」と「K2.5」の比較により、同系統モデル内での改善(または差分)がベンチマーク上で確認できる。

- 複数の主要LLMベンダー(OpenAI/Anthropic/Google等)を横並びで比較しており、評価軸に基づく相対位置づけが焦点になっている。

- 選定された比較対象モデル名が明確で、モデル採用や検討に必要な一次情報(ベンチマーク参照)が提供される。

- 記事全体はニュースというより、ベンチマーク結果の整理・比較という性格の分析/共有記事といえる。

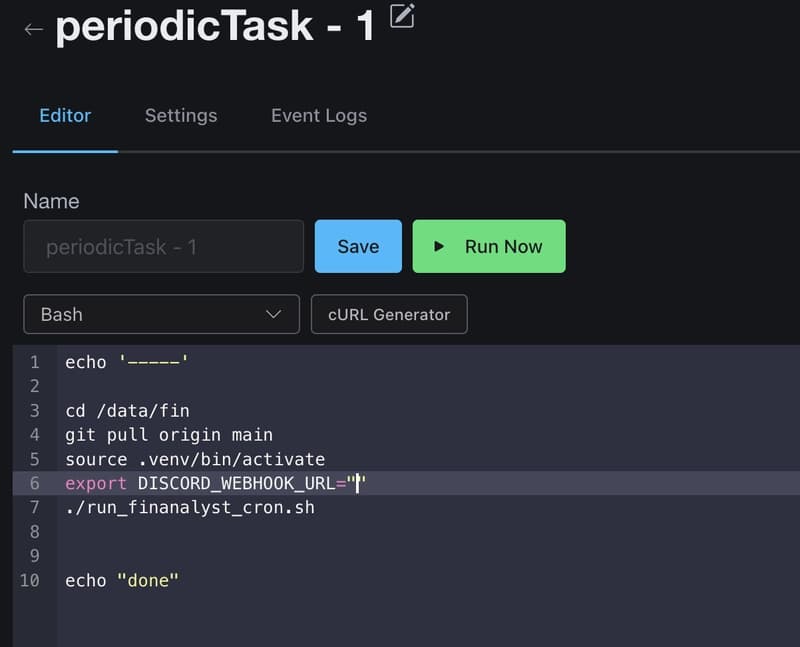

I'm sticking to Moonshot's K2.6 benchmark table for this one, and that's on purpose. Benchmark posts tend to get messy the moment you start mixing vendor tables, different tool settings, different reasoning effort, and different evaluation harnesses — the numbers stop comparing the same things to...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

How I Use GitHub Copilot + RapidForge to Generate Daily Stock Ideas

Dev.to

Big Tech firms are accelerating AI investments and integration, while regulators and companies focus on safety and responsible adoption.

Dev.to

Anthropic CVP Run 3 — Does Claude's Safety Stack Scale Down to Haiku 4.5?

Dev.to

Design Patterns for Prompt Engineering: Toward a Formal Discipline

Dev.to

What Generative AI Reveals About the State of Software?

Reddit r/artificial