Anthropicのプロジェクト Glasswing —— Claudeの神話(Mythos)をセキュリティ研究者に限定するのは、私には必要なことのように思える

2026年4月7日

Anthropicは今日、最新モデルであるClaude Mythos(system cardのPDF)をリリースしなかった。代わりに、新たに発表したProject Glasswingの下で、非常に制限された一部のプレビューパートナーに対してのみ利用可能にした。

このモデルは汎用モデルで、Claude Opus 4.6に似ているが、Anthropicはサイバーセキュリティ研究の能力が十分に強いため、ソフトウェア業界全体が準備するための時間を確保する必要がある、と主張している。

Mythos Previewは既に、あらゆる主要なOSとウェブブラウザの中に含まれるものも含め、数千件の高い重大度(high-severity)の脆弱性を見つけている。AIの進歩の速度を考えると、こうした能力は、安全に導入することを固く決めている主体の領域を越えて、増殖するのも遠くないだろう。

[...]

Project Glasswingのパートナーは、自分たちの基盤システムに存在する脆弱性や弱点を見つけ、修正するために、Claude Mythos Previewへのアクセスを受け取る。この「基盤システム」とは、世界の共通するサイバー攻撃面のかなり大きな部分を占めるものだ。この作業は、ローカルでの脆弱性検知、バイナリのブラックボックステスト、エンドポイントの防御、そしてシステムへの侵入テストといったタスクに重点を置くことを見込んでいる。

「自社のモデルは危険すぎるので公開できない」と言うのは、新しいモデルに注目(バズ)を集めるうまいやり方だ。しかしこの件に関しては、彼らの慎重さは妥当だろうと思う。

ほんの数日前(先週の金曜日)に、現代のLLMが脆弱性研究においてどれほどすごい域に達しているのかについて、信頼できるセキュリティの専門家たちが警鐘を鳴らす動きが増えてきたことを受けて、このブログに新しくai-security-researchというタグを追加し始めた。

数か月前、私たちは「AIスラップ(AI slop)」と呼んでいたもの、つまり、明らかに間違っていたり品質が低かったりする、AIが生成したセキュリティレポートを手にしていました。正直、ちょっと面白かったんです。実際には、私たちはそれほど心配していませんでした。

一か月前に何かが起きて、世界が切り替わりました。今は本物のレポートがある。すべてのオープンソースプロジェクトに、AIで作られた本物のレポートがある。でもそれらは質が高く、本物です。

curlのDaniel Stenberg:

オープンソースのセキュリティにおけるAIの課題は、AIスラップの津波から、もう少し... 単なるセキュリティレポートの津波へと移行しました。スラップは減ったけど、レポートがたくさんあります。その多くは本当に良い。

私は今、これに毎日何時間も費やしています。すごく大変です。

そしてThomas Ptacekは、Vulnerability Research Is Cookedという投稿を公開した。これは、AnthropicのNicholas Carliniとのポッドキャストの会話に触発されたものだ。

Anthropicには、Glasswingプロジェクトを説明する5分のトーク動画がある。Nicholas Carliniがその“話す人”の一人として登場し、そこで(強調は引用者による):

これは脆弱性を連鎖させる能力があります。つまり、脆弱性を2つ見つけたとして、それぞれは単独ではあまり意味のあるところまで到達できないとしても、このモデルは、3つ、4つ、あるいは時には5つの脆弱性から、それらを順番に使うことで、非常に洗練された何らかの最終成果につなげるエクスプロイトを作り出せるということです。[...]

ここ数週間で見つけたバグは、私が人生の残りの期間で見つけたものと合わせたより多い。私たちはこのモデルを使って、オープンソースのコードをたくさんスキャンしました。最初に向かったのがオペレーティングシステムだったのは、それがインターネット基盤の土台をなすコードだからです。OpenBSDでは、27年間ずっと存在していたバグを見つけました。私はOpenBSDのどのサーバーにも、少量のデータを送るだけでクラッシュさせられるのです。Linuxでは、権限がまったくないユーザーでも、手元のマシンであるバイナリを実行するだけで、管理者に権限昇格できるような脆弱性をいくつか見つけました。これらのバグそれぞれについて、私たちは実際にソフトウェアを運用しているメンテナーに報告しました。メンテナーはそれを修正し、パッチを展開しました。そうすることで、ソフトウェアを実行する誰もが、こうした攻撃に対して脆弱ではなくなりました。

私はOpenBSD 7.8のerrataページで、これを見つけました:

025: RELIABILITY FIX: 2026年3月25日 すべてのアーキテクチャ

無効なSACKオプションを含むTCPパケットが、カーネルをクラッシュさせる可能性がありました。

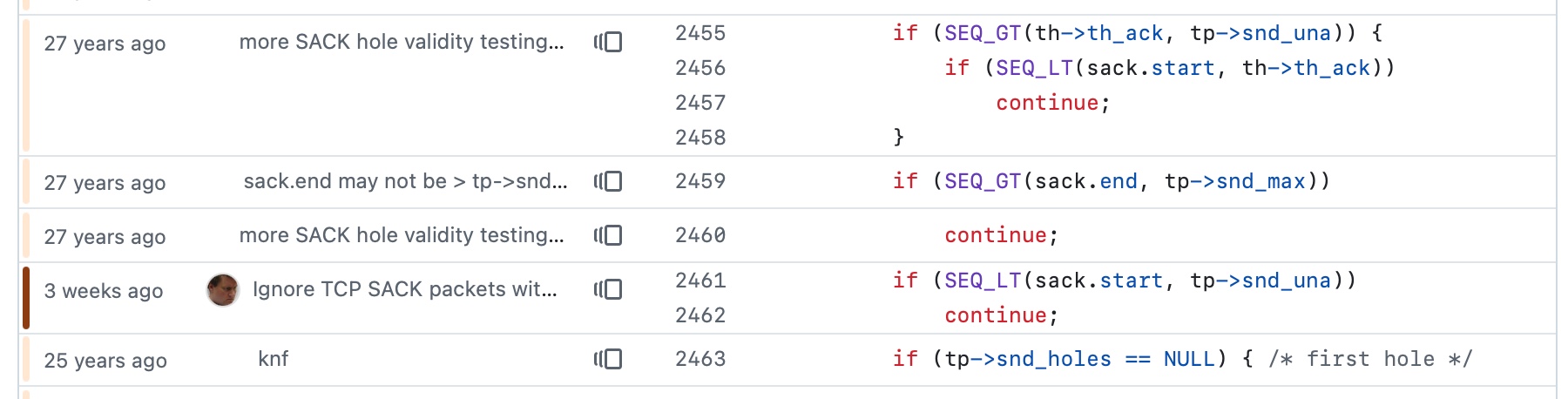

私は、その変更をOpenBSD CVSリポジトリのGitHubミラーで追跡しました(どうやら彼らは今もCVSを使っているようです!)そして、git blameを使っていることを見つけました:

案の定、周辺のコードは27年前のものです。

ニコラスが説明していたLinuxの脆弱性がどれなのかは分かりませんが、最近取り上げられていたマイケル・リンチによるこのNFSのものかもしれません。

ここには十分な「煙」がありますので、「火」があると私は考えています。数十年前のソフトウェアに脆弱性が見つかっても驚くことではありません。特に、それらの多くが主にCで書かれているのですから。しかし新しいのは、最新のフロンティアLLMによって実行されるコーディングエージェントが、こうした問題を掘り起こすことに、たゆまず能力を発揮している点です。

実は金曜日に、これは業界全体で起きる「精算」めいた流れの始まりのように聞こえたのだと思いました。避けられない脆弱性の大波を前に出ておくために、大規模に時間とお金を投じる価値があるかもしれない、と。

Project Glasswingには、「使用クレジットとして$100M...」に加えて、「オープンソースのセキュリティ組織への直接の寄付として$4M」が組み込まれています。パートナーにはAWS、Apple、Microsoft、Google、そしてLinux Foundationが含まれます。OpenAIも関わってくれると嬉しいですね。GPT-5.4はすでにセキュリティ脆弱性を見つける強い評判がありますし、さらに近い将来を見据えてより強力なモデルもあります。

一方で、私たち信頼されたパートナーではない人々にとっての悪いニュースはこれです:

私たちはClaude Mythos Previewを一般に提供する予定はありませんが、最終的な目標は、ユーザーがMythos級のモデルを大規模に、安全に展開できるようにすることです。目的はサイバーセキュリティのためであるだけでなく、そのような高い能力を持つモデルがもたらす他の多種多様な利点のためでもあります。そうするためには、モデルの最も危険な出力を検出しブロックするサイバーセキュリティ(およびその他)のガードレールを開発する上で前進する必要があります。今後のClaude Opusモデルで新しいガードレールを立ち上げる予定で、Mythos Previewと同じレベルのリスクをもたらさないモデルを使って、それらを改善し、洗練させていけるようにします。

私はそれならやっていけます。ここで挙げられているセキュリティ上のリスクは本当にもっともだと思いますし、それに先回りできるように信頼されたチームに追加の時間を与えるのは、妥当なトレードオフです。

最近の記事

- Axiosのサプライチェーン攻撃は、個別に標的を定めたソーシャルエンジニアリングを用いていた - 2026年4月3日

- Lennyのポッドキャストでの、エージェント的エンジニアリングに関する会話のハイライト - 2026年4月2日

これはAnthropicのProject Glasswing—Claude Mythosをセキュリティ研究者に限定すること—は必要だと私には思えるです。サイモン・ウィリソンによる投稿で、2026年4月7日に掲載されました。

security 595 thomas-ptacek 18 ai 1952 generative-ai 1733 llms 1700 anthropic 267 nicholas-carlini 11 ai-ethics 288 llm-release 188 ai-security-research 12前の記事: Axiosのサプライチェーン攻撃は、個別に標的を定めたソーシャルエンジニアリングを用いていた

月次ブリーフィング

$10/月で私をスポンサーにして、今月の最も重要なLLMの動向を厳選したメールダイジェストを受け取ってください。

私に支払って、あなたに送る量を減らしてもらいましょう!

スポンサーになって購読する