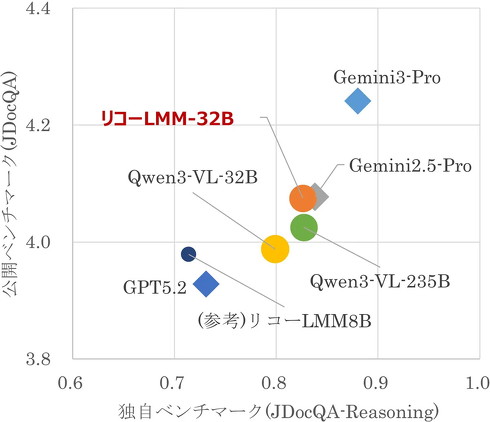

リコーは3月30日、推論のプロセスを日本語化したマルチモーダルLLM「Qwen3-VL-Ricoh-32B-20260227」を開発したと発表した。320億パラメータを持ち、複雑な図表を含む日本語の資料も読解できるという。米GoogleのAIモデル「Gemini 2.5 Pro」に匹敵する性能をうたう。

Qwen3-VL-Ricoh-32B-20260227は、複雑なフロー図や複数ページにわたるグラフなどにも対応する。図表を含む日本語の文書をもとに、質問に回答する性能を測るベンチマークでは、Gemini 2.5 Proに匹敵する性能を示したとアピールしている。また回答の根拠や前提条件などを日本語で確認できる。

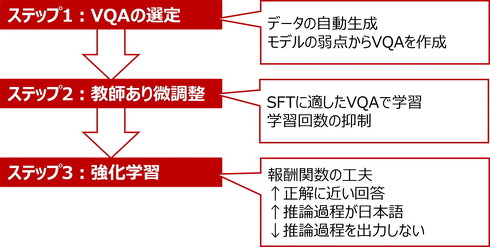

Qwen3-VL-Ricoh-32B-20260227の開発では、中国AlibabaのAIモデル「Qwen3-VL-32B-Instruct」をベースにした。同モデルの弱点を改善するのに有効な学習データを用意し、事後的に特定のタスクに最適化するファインチューニングを行った。

さらにAIが試行錯誤し、結果に応じた報酬をもとに出力を改善する強化学習も実施した。出力の正確さに加えて、日本語による推論の出力にも高い報酬を設定するといった工夫を施した。

●自社AIプラットフォーム「H.D.E.E.N」で提供

リコーは、独自のAIプラットフォーム「H.D.E.E.N」(ひでん)や、リコー製のLLMを搭載した小型のAIサーバを展開するなど、企業向けのAIサービスに注力している。Qwen3-VL-Ricoh-32B-20260227の開発では、画像を含むさまざまな企業内データを扱いながら推論でき、オンプレミスで導入できるAIモデルを目指した。

同社の児玉哲氏(リコーデジタルサービスビジネスユニット AIサービス事業本部 AI事業開発センター所長)は、リコーのAI開発の戦略について「AIモデル単体でビジネスしようとは考えていない」と説明する。Qwen3-VL-Ricoh-32B-20260227についても、H.D.E.E.Nなどを通じて提供する。

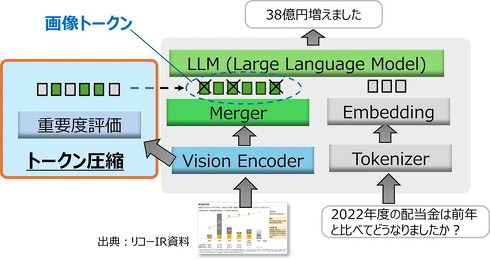

また児玉氏は、リコー自らAIモデルを開発する理由として「自社で手掛けることで獲得できる技術やノウハウを、顧客にソリューションとして提供できる」と語る。今回の取り組みでは、AIが処理する際の画像トークンを減らす技術なども開発した。これにより、AIモデルの運用コストの削減につなげたい考えだ。

Qwen3-VL-Ricoh-32B-20260227の開発では、経済産業省と新エネルギー・産業技術総合開発機構の国内企業向けAI開発支援プロジェクト「GENIAC」第3期の補助を受けた。同モデルの軽量版「Qwen3-VL-Ricoh-8B-20260227」をHugging Faceで公開しているほか、画像を含む文書をもとに推論する性能を測るリコー独自のベンチマークも公開する予定だ。

関連記事

企業の“秘伝のタレ”をAI化 リコー、AIプラットフォーム「H.D.E.E.N」(ひでん)を発表

企業の“秘伝のタレ”をAI化 リコー、AIプラットフォーム「H.D.E.E.N」(ひでん)を発表

リコーは、企業向けAIプラットフォーム「H.D.E.E.N」(ひでん、仮称)を発表した。 リコー、日本語で“GPT-5と同等性能”うたう金融業務特化型LLMを開発

リコー、日本語で“GPT-5と同等性能”うたう金融業務特化型LLMを開発

リコーは、GPT-5と同等の性能を持つ金融業務特化型LLMを開発したと発表した。 リコー、低コスト・高速うたう新LLM 日英中対応で今秋提供

リコー、低コスト・高速うたう新LLM 日英中対応で今秋提供

リコーは日英中3言語に対応した700億パラメータの大規模言語モデル(LLM)を開発したと発表した。 リコー、モデルマージで“GPT-4レベル”の大規模言語モデル開発 プライベートLLMの開発効率化に貢献

リコー、モデルマージで“GPT-4レベル”の大規模言語モデル開発 プライベートLLMの開発効率化に貢献

リコーは、モデルマージ技術によって高性能な日本語大規模言語モデルを開発したと発表した。米OpenAIのLLM「GPT-4」と同等の性能を持つとしている。 Metaの生成AI担当者が来日 Llamaが「オープンモデル」にこだわる理由を語る

Metaの生成AI担当者が来日 Llamaが「オープンモデル」にこだわる理由を語る

「Llamaのミッションは全ての人にオープンインテリジェンスを届けること」――Metaで大規模言語モデル(LLM)の「Llama」を担当するマノアール・パルーリさんが来日し、報道陣にオープンモデルであるLlamaの狙いと展望について語った。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia AI+メールマガジン」の登録が必要です