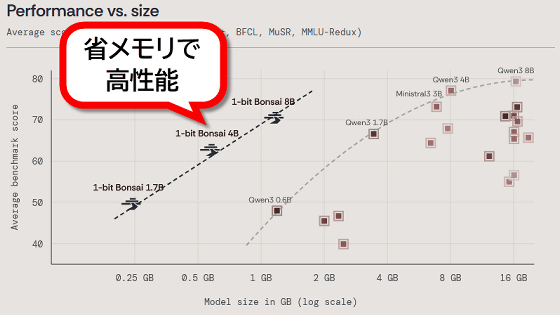

AIモデルはパラメーター数が多いほど性能が高くなりやすいですが、パラメーター数が多くなるとメモリ使用量が増加してしまうというトレードオフの関係にあります。AI開発企業のPrismMLが2026年3月31日に発表した「1-bit Bonsai」は80億パラメーターのモデルを1.15GBという少ないメモリ使用量で実行することが可能。さらに、メモリ約14倍消費する他モデルを打ち負かすほどのベンチマークスコアも記録しており、高性能かつ省メモリなAIモデルとして注目を集めています。

GIGAZINE / 2026/4/6