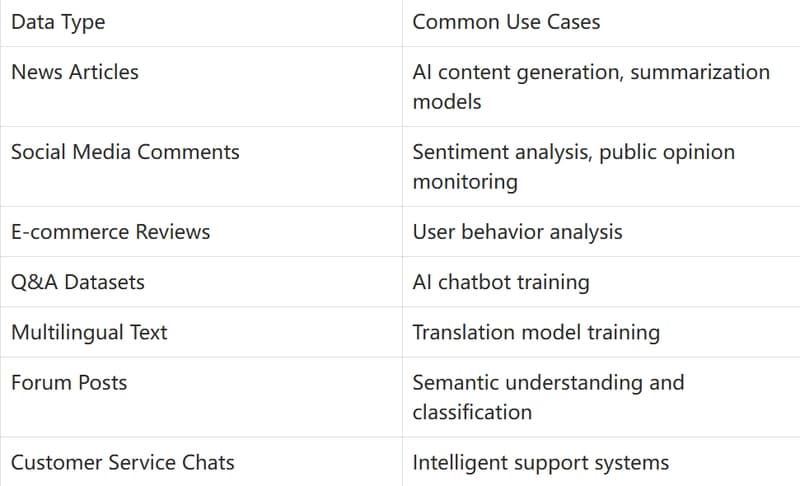

| 今日はToken AIによる新しい研究論文について話します: これは、理論と結果の両面で、最も強力な最適化手法の一つになり得るものを紹介しています。 何年も私たちは、Adam、AdamW、LAMBなどのよく知られた最適化手法に頼ってきました。当然ながら、これらはAIモデルの学習における定番の選択肢でした。 もし「最適化手法(optimizer)」が何かご存じでない場合、簡単に言うと:それはあらゆるAIモデルの学習における中核部分です。学習中にモデルの重みを更新するためのアルゴリズムで、損失を減らすことを目的としています。 とはいえ、これらの最適化手法には、学習に影響を与える制限があります。 たとえばAdamは、学習の間ずっとbeta1が固定されています。そのため、古いモーメンタムを抱えたままになり、モデルを間違った方向に押し続けてしまう可能性があります。 STAMは、現在の勾配と前のモーメンタムの差(g - m)を測定することでこれに対処します。この差が大きいとbeta1を下げ、ノイズの多いフェーズでより安定した学習を可能にします。 もう一つの問題は、学習中にシフトやノイズが発生したときです。古いモーメンタムは有害になり得ます。STAMは、残差の分散に基づく適応的なbeta1によってこれを扱います。 SGDにおける大きな問題は、方向が間違っても固定モーメンタムのせいでそのまま進み続けることです。STAMは、最初のモーメンタムが自己修正できるようにすることでこれを解決します。 では次に、軽量版のSTAMLiteについて話します。 STAMLiteは、多くのケースでデフォルトの選択肢としてAdamWを置き換えることを目的に設計されています。主な違いは、beta1が固定ではなく動的である点です:

さらに、最適化手法の状態メモリの観点でも効率が向上します:

実際には、STAMLiteはAdamWおよびSTAMと比べてリソースを約50%節約でき、学習中のGPU使用量を大幅に抑えられます。 ベンチマークを見ると、その結果は自明です。 ハイパーパラメータスイープ(Hyperparameter Sweep)では、STAMLiteは以下を達成しました: 長期ホライズンの非定常MLP(Long-Horizon Non-Stationary MLP)では、STAMはNAdamと並んで1位を獲得し、ほぼ同一の結果でした: より多くのベンチマークは、Webサイトと研究論文で公開されています。 これはTokenAIによる重要な前進であり、既知の問題を抱える限られた最適化手法セットに長年依存してきた状況を打ち破ります。 早期リリースであるにもかかわらず、強力で有望であることが分かります。個人的には、すでにSTAMに切り替えており、現在それを使って初めてのフルLLMをスクラッチから学習しています。結果は近いうちに共有します。 研究論文: あなたの考えを聞かせてください。 [link] [comments] |

新世代のAIモデルと、最先端クラスのパワフルな研究論文

Reddit r/LocalLLaMA / 2026/5/8

💬 オピニオンDeveloper Stack & InfrastructureModels & Research

要点

- Token AIの研究論文「Stable Training with Adaptive Momentum(STAM)」は、従来のAdam系最適化手法の制約を踏まえた新しい最適化器を提案している。

- STAMは、現在の勾配と過去のモーメンタムの差(g-m)や残差の分散などを手がかりにβ1(モーメンタム係数)を適応的に調整し、ノイズが多い学習フェーズでも学習を安定化させる。

- 軽量版の「STAMLite」は、デフォルト最適化器としてAdamWの置き換えを狙い、β1を動的にする一方でオプティマイザ状態のメモリ効率を改善してGPU使用量を大きく削減する。

- 実運用面では、STAMLiteがAdamWやSTAMと比べて必要リソースを抑えつつ、ベンチマーク(ハイパーパラメータスイープ等)で競争力のある精度・損失を示すことが述べられている。