大規模言語モデル(LLM)を構築するための標準的なガイドラインは、訓練コストの最適化にのみ焦点を当て、推論コストを無視しています。これは、モデルをデプロイする際に、推論時にモデルから複数の推論サンプルを引くといった、推論時スケーリング技術によって応答の精度を高める実世界のアプリケーションにとって課題になります。

このギャップを埋めるために、ウィスコンシン大学マディソン校とスタンフォード大学の研究者たちは Train-to-Test(T2)スケーリング則を提案しました。これは、モデルのパラメータ規模、訓練データ量、そしてテスト時(推論時)に生成する推論サンプル数を、共同で最適化する枠組みです。

実際に、彼らのアプローチでは、従来の定石が定めるよりもはるかに小さいモデルを、桁違いに多いデータで訓練するのが計算(compute)上最適であり、そして節約できた計算コストの余力を使って、推論時に複数の繰り返しサンプルを生成することが可能であると示されます。

自分自身でモデルを訓練しているエンタープライズのAIアプリケーション開発者にとって、この研究は投資対効果(ROI)を最大化するための実証済みの設計図を提供します。AIの推論には、フロンティアモデルに巨額の費用を費やすことが必ずしも必要ではないことを示しています。代わりに、小規模モデルでも複雑なタスクでより強い性能が得られ、さらに、実世界のデプロイ予算の範囲内で1クエリあたりの推論コストを管理しやすい状態に保てます。

相反するスケーリング則

スケーリング則は、大規模言語モデルを開発するうえで重要な要素です。事前学習(プリトレーニング)のスケーリング則は、モデルの作成時に計算資源(compute)をどう配分するのが最善かを定めます。一方で テスト時スケーリング則 は、デプロイ時に計算資源をどう配分するかを指示します。たとえば、モデルに「より長く考えさせる」ことや、複雑な問題を解くために複数の推論サンプルを生成することなどです。

問題は、これらのスケーリング則が、基本的に密接に絡み合っているにもかかわらず、互いにまったく独立して開発されてきた点にあります。

モデルのパラメータ規模と訓練の期間は、その推論サンプルの品質と、1クエリあたりのコストの両方を直接左右します。現在、業界の事前学習に関するゴールドスタンダードは Chinchilla rule で、モデルパラメータ1つにつきおよそ20トレーニングトークンの割合が計算上最適だと示しています。

<>しかし、Llama、Gemma、Qwenといった現代のAIモデルファミリーの作り手たちは、巨大なデータ量に対して意図的に自分たちの小規模モデルを過学習(オーバートレーニング)することで、このルールを日常的に破っています。

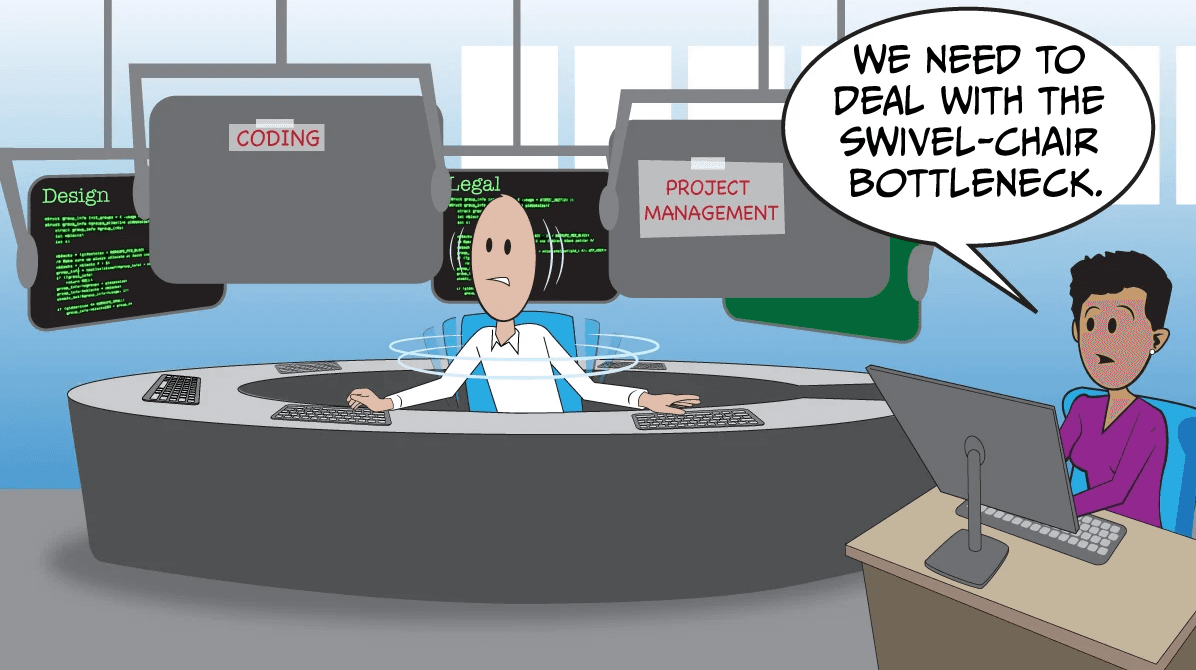

論文の共著者である Nicholas Roberts がVentureBeatに語ったところによれば、従来のアプローチは複雑なエージェント型ワークフローを構築する際にうまく機能しません。「私の見解では、各個別の推論呼び出しが高コストになると、推論スタックが破綻します。これはモデルが大きくなっていて、同じことを大量に繰り返しサンプリングする必要がある場合に起きます。」巨大なモデルに頼る代わりに、開発者はコストの一部でこの繰り返しサンプリングを実行できるよう、過学習済みのコンパクトなモデルを使うことができます。

とはいえ、訓練とテスト時のスケーリング則は別々に検討されてきたため、デプロイ中に生成する必要のある推論サンプル数に基づいて、モデルをどれほど過学習すべきかを計算するための厳密な枠組みは存在しませんでした。

その結果として、モデルサイズ、訓練データ量、そしてテスト時推論予算を同時に最適化するための数式は、これまで提示されていません。

この枠組みを作るのが難しい理由は、事前学習とテスト時のスケーリングが、数学的には異なる言語を話しているためです。事前学習では、モデルの性能は「損失(loss)」によって測定されます。損失は、学習が進むにつれて予測誤りを追跡する、なめらかで連続的な指標です。

テスト時には、開発者は pass@k のような、実世界の下流指標を用いて推論能力を評価します。pass@k は、モデルが k 回の独立した反復試行のうち、少なくとも1つの正しい回答を生成する確率を測ります。

Train-to-test スケーリング則

訓練とデプロイの切断(disconnect)を解消するために、研究者たちは Train-to-Test(T2)スケーリング則を導入します。大づかみに言えば、この枠組みでは、3つの変数を1つの方程式として扱うことで、モデルの推論パフォーマンスを予測します。それは、モデルのサイズ(N)、学習する訓練トークンの量(D)、そして推論時に生成する推論サンプル数(k)です。

T2 は、モデルを訓練するための基礎コスト(6ND)と、推論時にそれを繰り返し問い合わせることで増殖(compounding)するコスト(2Nk)の両方を考慮したうえで、事前学習と推論(インファレンス)の予算を1つの最適化式に統合します。研究者たちは、さまざまなモデリング手法を試しました。事前学習の損失、あるいはテスト時の性能(pass@k)を、N、D、k の関数としてモデル化するかどうかです。

第一のアプローチは、Chinchilla スケーリングでおなじみの数式(モデルの予測誤差、つまり損失を計算するもの)をそのまま使い、テスト時の反復サンプル数(k)を考慮する新しい変数を追加する形で直接改変します。これにより、推論に使う計算量(推論コスト)を増やすことで、モデル全体の誤り率がどれだけ下がるかを開発者が見通せるようになります。

第二のアプローチでは、下流の pass@k 精度そのものを直接モデル化します。これは、特定の計算量予算が与えられたときに、アプリケーションが問題を解ける確率を開発者に示すものです。

しかし、エンタープライズはこの枠組みをすべてのアプリケーションで使うべきなのでしょうか。Roberts は、このアプローチが非常に専門的であることを明確にしています。「チャットモデルのような知識重視のアプリケーションでは、これほどの恩恵は見られないだろうと思います」と彼は述べました。その代わりに、「T2 は、コーディングなどの推論重視のアプリケーション向けに調整されており、通常、テスト時スケーリングの方法として反復サンプリングを使うでしょう」とのことです。

開発者にとって何を意味するか

T2 のスケーリング則を検証するために、研究者たちは 5百万〜9億100万(901 million)パラメータの範囲に及ぶ100を超える言語モデルからなる大規模なテストベッドを構築しました。さらに、数学的な予測が現実に成り立つかどうかを確かめるために、強く過学習した新しいチェックポイントを21個、ゼロから学習しました。そして、SciQ や OpenBookQA といった実世界のデータセットに加え、算術、空間的推論、知識の想起(リコール)をテストするための合成タスクも含む、合計8種類の多様なタスクでモデルをベンチマークしました。

彼らの2つの数学モデルはいずれも、計算上最適なフロンティアが、標準的な Chinchilla スケーリングから大きく(劇的に)ずれることを示しました。固定予算のもとで最大の性能を得るには、従来の「1パラメータあたり20トークン」というルールが示すよりもはるかに小さいモデルを選び、非常に大量のデータで訓練するのが最適解になります。

実験では、強く過学習された小規模モデルが、テスト時サンプリングのコストを考慮すると、8つの評価タスクすべてにおいて、大きく、Chinchilla 的に最適化されたモデルを一貫して上回りました。

これらの知見をデプロイしたい開発者にとって、技術的なハードルは意外なほど低いです。

「現在のモデルであれば、テスト時スケーリングを行うのに特別な工夫は必要ありません」と Roberts は述べました。「デプロイ時には、サンプリング処理をより効率的にするインフラを(たとえばトランスフォーマを使っているなら KV キャッシングなど)組み込むことは間違いなく可能です。」

KV キャッシング は、これまで処理したコンテキストを保存することで、推論サンプルを生成するたびに、モデルが最初のプロンプトを最初から読み直す必要がなくなるようにするために役立ちます。

しかし、過度な過学習には実務上のトレードオフが伴います。過学習したモデルは頑固で、微調整が難しくなりがちな一方で、Robertsは、監督あり微調整を適用した際に「この効果は見られたものの、最適なモデルをチンチラ(Chinchilla)へ引き戻すほどの強い効果ではありませんでした」と述べています。計算(compute)最適な戦略は、依然として明確にコンパクトなモデルへと偏っています。

それでも、これをあらゆる点で限界まで押し切ろうとするチームは、物理的なデータの限界に到達しないよう注意が必要です。「別の見方として、過学習に関する推奨を極端まで引き上げると、実際に学習データが尽きてしまう可能性があります」とRobertsは語り、質の高いインターネットデータが枯渇していく、迫り来る「データ・ウォール(data wall)」に言及しました。

これらの実験は、アプリケーションがテスト時に複数の推論サンプルを生成することに依存している場合、コンパクトなモデルを攻めた過学習を行うことが、エンドツーエンドの計算予算を使うための実務的かつ数学的に最も効果的な方法であることを裏づけています。

開発者がすぐに取りかかれるようにするため、研究チームは近いうちにチェックポイントとコードをオープンソース化し、企業が自社のデータを差し込み、スケーリング挙動をすぐに検証できるようにする予定です。最終的に、この枠組みはAI業界における均衡化の力として機能します。

とりわけ重要なのは、最前線(frontier)モデルの高い価格が、推論モデルに依存するエージェント型アプリケーションをスケールさせようとする際の障壁になり得ることです。

「T2は、本質的に強力な推論モデルを作れる人の範囲を変えてしまいます」とRobertsは結論づけます。「最先端の推論を得るのに、巨大な計算予算が必ずしも必要というわけではありません。代わりに、良いデータと、学習および推論のための予算配分の賢い最適化が必要です。」