TL;DR — 「Qwen 3.6 27B(2026年4月22日リリース、Apache 2.0の下で提供)は、SWE-bench Verifiedで77.2%を記録。Claude Opus 4.6の80.8%に対して4ポイント以内」かつ「単一のRTX 4090で動作する」。月あたりのコーディング作業が約300万トークン未満の個人開発者なら、ローカルモデルは確実に、$15/MTokのブレンドAPIコストの代わりになり得ます。エージェント的ループ、長いコンテキストでのリファクタ、そしてレイテンシの一貫性が重要なチームのワークロードでは、APIはやはり存在意義があります。正直な答えは「両方を使う」で、以下の計算がその境界線を示します。

1,600ドルのGPUに収まり、最難関のコーディングベンチマークで旗艦APIに4点以内まで迫る2,700億(270億)パラメータ・モデルは、予算の会話における大きな転換を意味します。

Qwen 3.6 27Bが実際に何であるか

AlibabaのQwenチームは、2026年4月22日にQwen3.6-27Bを出荷しました。これは270億パラメータの密(dense)モデルです(2025年に席巻したMixture-of-Experts方式とは異なり、トークンごとに全パラメータが有効)。Apache 2.0の下でHugging FaceとModelScopeにてリリースされており、利用制限もテレメトリもありません。公表されている主な狙いは、エージェント的コーディング、リポジトリ単位の推論、そしてフロントエンドのワークフローです。

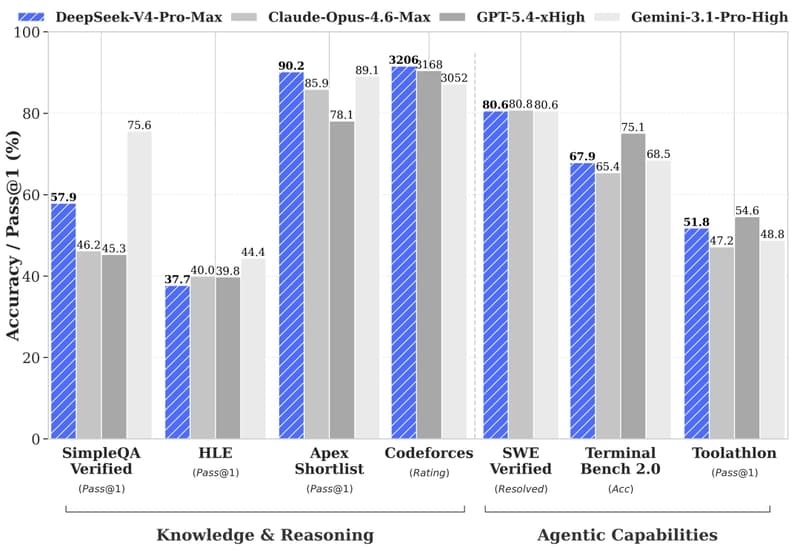

主要ベンチマーク:

| ベンチマーク | Qwen 3.6 27B | Claude Opus 4.6 | 差 |

|---|---|---|---|

| SWE-bench Verified | 77.2% | 80.8% | -3.6 pts |

| SWE-bench Pro | 53.5% | ~55%(推定) | -1.5 pts |

| Terminal-Bench 2.0 | 59.3% | ~59% | ~同点 |

| GPQA Diamond | 87.8% | ~85% | +2.8 pts |

注意点――そしてこれは本当に重要なのですが――Qwenは、自社の内部エージェント用の足場(bash + ファイル編集ツール)を使ってこれらの数値を報告しています。リリース後数週間たっても、その足場の外での独立した第三者による再現はまだ限定的です。77.2%は上限として扱い、標準的なSWE-agentまたはaiderのハーネスでは70〜75%になることを見込んでください。

$15/MTokの計算

Claude Opus 4.6の価格は$5/MTok(入力)で$25/MTok(出力)です。コーディング作業は典型的に入力対出力が2:1(大量のコードを投入し、より小さいパッチを書き戻させる)なので、ブレンドしたコストはおおむね$11.67(100万トークンあたり)になります。この記事の「$15/MTok」は、推論比重の高いトラフィックもカバーするやや保守的な四捨五入です。

Claude CodeやAiderのようなものをAPI経由で使う実運用では、稼働中の1時間あたりに10万〜50万トークンを消費し、ほとんどのフルデイは150万〜400万トークンの範囲に収まります。つまり1日あたり$20〜50、API料金ベースで$400〜1,000/月です。小規模チームなら、人員数で掛け算してください。

同等のスループットでのローカルQwen 3.6 27Bは、初期のハードウェア費用――RTX 4090($1,600中古 / $1,900新品)またはM4 Max Mac Mini(64GBの統合メモリ込みで$2,400)――を2〜3年で償却し、加えて電気代として約$0.20/日。単一の$400/月のAPI請求に対する損益分岐点は、だいたい4〜6か月です。それを超えると、ローカルモデルは機能的に無料になります。

ハードウェア現実チェック

Qwen 3.6 27Bをネイティブ品質で動かすには、最低でも18GBのVRAM、または22GBのユニファイドメモリが必要です。実際に現場で報告されている構成:

- RTX 4090(24GB) — vLLMでBF16のフルモデルを実行。単一ストリームのコーディング課題で35〜50 tok/sを達成

- RTX 5090(32GB) — 同じモデルで、長いファイルのKVキャッシュに余裕

- Mac M4 Max 64GB — llama.cppでQ4_K_M量子化を使い、約25 tok/s

- Mac M3 Max 48GB — Q4_K_M量子化で、約16〜18 tok/s

- デュアルRTX 3090(48GB) — フル精度の予算寄り構成として成立。約25 tok/s

比較すると、Claude Opus 4.6はAPI経由で60〜90 tok/sでストリーミングします。これはネットワークのレイテンシやレート制限によるジッタを加える前の話です。4090でのローカル生成は、単一ストリームの作業なら同程度のレンジに収まります。差が出るのは、並列なエージェント的ループを回したいときで、その場合はクラウドの弾力的な計算資源が決定的に有利になります。

ローカルが勝つ場所(そして本当に使うべき理由)

ハードウェアを用意した時点でAPIからローカルへ切り替わるケース:

- 継続的な個人コーディング — Claude Code、Aider、Clineを一日中オートパイロットで回す。累積トークン消費は、ローカルモデルが“無料で”飲み込んでくれる種類のバックグラウンドノイズです。

- プライバシーに敏感なコード — 規制対象データ、社内インフラ、あるいはセキュリティチームに“マシン外へ出したくない”ものに触れるコード。Apache 2.0 + ローカル推論なら、説明すべきデータ漏えいのストーリーがありません。

- レイテンシが安定したインナーループ — レート制限なし、ピーク時間帯の503なし、プロバイダ側のスロットリングなし。ローカルモデルの壁時計のブレは、あなたのPCの熱設計に上限があるだけです。

- ファインチューニングとLoRA領域 — オープンウェイトなら、モデルを自分のコードベースに実際に適応できます。クローズドAPIは、どんな価格でもそれは提供できません。

- オフライン/エアギャップ環境 — 旅行先、オンプレ導入、あるいはアウトバウンドAPI呼び出しがブロックされる状況。

これらでは、無料のローカルモデルが本当に$15/MTokのAPIを置き換えます。受け入れるトレードオフは、最難関の推論タスクで“1段階”能力が落ちる代わりに、限界コストがゼロに近づくことです。

APIがまだ優位な場所

数学が再びAPI側に傾くのはここです:

- 長いコンテキストでのリファクタ — Qwen 3.6 27Bの実効コンテキストは堅実ですが、64Kトークンを超えると劣化しやすく、特に負荷がかかっているとき顕著です。Claude Opus 4.6は200Kのウィンドウにわたって一貫性を保ちますが、ローカルモデルではまだその域に届きません。

- 並列のエージェント的ループ — 8つ以上の同時エージェント(テスト生成、ファズ、複数ファイルの編集)を動かす場合、単一GPUがボトルネックになります。APIはバーストを吸収し、あなたが何もプロビジョニングしなくて済みます。

- コーディング以外の難しい推論 — アーキテクチャレビュー、セキュリティ分析、斬新なアルゴリズム設計。ここでは、Opus 4.6が3〜4ポイントのベンチマーク差以上に前に出ます。

- 本番向けのレイテンシSLA — 99.9パーセンタイルのトークン時間保証は、ホスティング事業者が提供できるものです。消費者向けGPUは、熱的な圧力下では提供できません。

- 共有トラフィックを伴うチームワークフロー — 複数の開発者が同時に単一GPUへアクセスすると、レイテンシのプロファイルがキューになります。クラウドAPIは水平スケールし、気にする必要がありません。

すでにChatGPT風のサブスクリプションで月$30〜50を払っていて、ハードウェアを手元に置けていないなら、ローカル方式はおそらく計算上ペイしません。損益分岐点は現実ですが、それは継続的なワークロードを前提としています。

現実的な答え:ハイブリッド・ルーティング

2026年にこの結論にたどり着いた多くの経験者は、一つに決めません。ルーティングします。うまくいくパターン:

- ローカルQwenをデフォルトにする — IDE内でのオートコンプリート、単一ファイルの編集、テスト用の足場作り、リンタ修正、コード説明、「小さな依頼・小さな回答」タイプの長いテールのトラフィック。

- クロスファイルのリファクタやアーキテクチャ提案はAPI経由でClaude Opus 4.6へエスカレーション — デバッグで複数ステップの失敗を追うことや、誤答が数トークン以上にコストを生むような場面。

- ルーティング層をエディタまたはエージェントに組み込む — どのモデルを使うかをユーザーから見えないようにする。Aiderはネイティブに対応しています。Claude Codeは、フォールバックとしてOpenAI互換のローカルエンドポイントを使うよう設定できます。

最も簡単な実装:vLLM を使ってポート 8000 で Qwen 3.6 27B をローカルに提供し、OpenAI 互換のエンドポイントとして登録したうえで、エディタ側の API ベース URL を環境スイッチで切り替えるように設定します。同じコードパスで、ローカルのモデルかホスト済みのエンドポイントのどちらにも会話でき、さらに「ローカル環境では出せない並列性が必要なとき」に備えて、ホスト済み Qwen を 1 つのキーで Qwen 3.6 Plus と Claude Opus 4.6 の両方として利用できるようになります。

最小の vLLM 起動コマンド:

vllm serve Qwen/Qwen3.6-27B \

--host 0.0.0.0 --port 8000 \

--max-model-len 65536 \

--gpu-memory-utilization 0.92

次にエディタを http://localhost:8000/v1 に向け、モデル名として Qwen/Qwen3.6-27B を使います。1 回の大変なクエリで Claude Opus 4.6 にフォールバックするのも、ベース URL を 1 回差し替えるだけで済みます。

What This Means for Your Stack

率直に言える、3 つのポイント:

- 「『オープンウェイト vs フロンティア API』のギャップは、コーディングにおけるベンチマークの差が一桁の範囲にまで縮まった」— これは本当に大きな変化であり、マーケティングではありません。

- 損益分岐点は、GPU 投資を償却するほどの継続的な稼働を実際に持てるかどうかにまだ左右されます。AI を使うために毎日 1 時間だけ使うパートタイムのコーダーでは、ホスト型プランに対してハードウェア投資を回収できないでしょう。

- 2026 年中頃に働く開発者の大半にとっての「正解」はハイブリッドです。量はローカル、難しい問題はホストです。ホスト側でこそ、Claude Opus 4.6 の価格と能力、そしてコーディング向け LLM の総合的なランキングにおける位置づけが今も重要になります。

コーディング向けの API に毎月 200 ドル以上払っていて、ワークステーションに最近の GPU があるなら、今四半期で試す価値のある最安の実験です。重みを取り込み、エディタを localhost に向けて、毎日のクエリのうち「フロンティア・モデルが本当に必要な数」がどれくらいあるか確認してください。多くの開発者は、その割合が 20〜30% だと見つけます。そしてその「まさにステッカー価格を払う価値がある範囲」が Opus です。

適切な問いは「オープンウェイトはまだ十分なのか?」ではなくなり、今は「私の毎日のクエリのうち、実際にフロンティア・モデルが必要なのは全体のどれくらいの割合か?」です。多くのコーダーにとって、この率直な答えは今や 5 人に 1 人から 3 人に 1 人の間あたりにあります。

Originally published on ofox.ai/blog.